2025年に向けて、人工知能(AI)は産業、社会、そして私たちとテクノロジーとの関わり方を、刺激的で時に驚くべき方法で再構築している。独立して動作するAIエージェントから、テキスト、ビデオ、オーディオをシームレスに統合するシステムまで、この分野はかつてない速さで進化している。技術系の起業家や開発者にとって、こうした変化を先取りすることは、単に賢いだけでなく、必要不可欠なことなのだ。

2025年以降のAIを形作るトレンド、ブレークスルー、課題を理解しよう。

ざっと振り返る:AIはいかに世界を変えたか

1950年代から今日までのAIの歩みは、驚くべき進化の物語であった。単純なルールベースのシステムから、推論、創造性、自律性を備えた洗練されたモデルへと進化してきた。この10年間で、AIは実験的なものから不可欠なものへと変遷し、産業界全体でイノベーションの中核を担うようになった。

ヘルスケア

AIを搭載したツールは、今や診断、個別化医療、さらには手術用ロボットにまで不可欠なものとなっている。AIによる画像診断のような技術は、病気の早期発見の限界を押し広げ、正確さとスピードにおいて人間の能力に匹敵し、凌駕している。

教育

適応型AIプラットフォームは、生徒の学習方法を根本的に変えた。きめ細かなデータ分析を用いて、コンテンツ、ペース配分、エンゲージメントを個人レベルで調整する。

交通

自律システムは、センサー・フュージョン、コンピューター・ビジョン、リアルタイムの意思決定の進歩に支えられ、実験的なプロトタイプから、ロジスティクスや公共輸送における実行可能なソリューションへと発展してきた。

こうした進歩は紛れもない価値をもたらす一方で、倫理、労働力への影響、AIの恩恵の公平な分配をめぐる複雑な問題も露呈している。AIが拡大し続ける中、これらの課題に対処することは引き続き優先事項である。

2025年に注目すべきゲームチェンジャーAI技術

2025年には、AIをより賢くするだけでなく、より有能で、拡張可能で、倫理的なものにすることが焦点となる。ここでは、その展望を形作るものを紹介する:

1.エージェントAI:タスクの自動化を超えて

エージェントAIは単なる流行語ではない。これらのシステムは、人間の意見をほとんど聞かずに意思決定を行い、状況に適応することができる。AIがあなたのスケジュールを管理し、プロジェクトを処理し、創造的なアイデアを生み出すというのはどうだろう?眠らない超効率的なチームメンバーを加えるようなものだ。

- 企業向け:複雑なワークフローを扱うバーチャルなプロジェクトマネージャーを考えてみよう。

- クリエイターのために:アイデアのブレーンストーミングやコンテンツの編集を一緒に手伝ってくれるツール。

ムーディーズが強調しているように、エージェント型AIは業界全体の生産性とイノベーションの原動力となる準備が整っている。

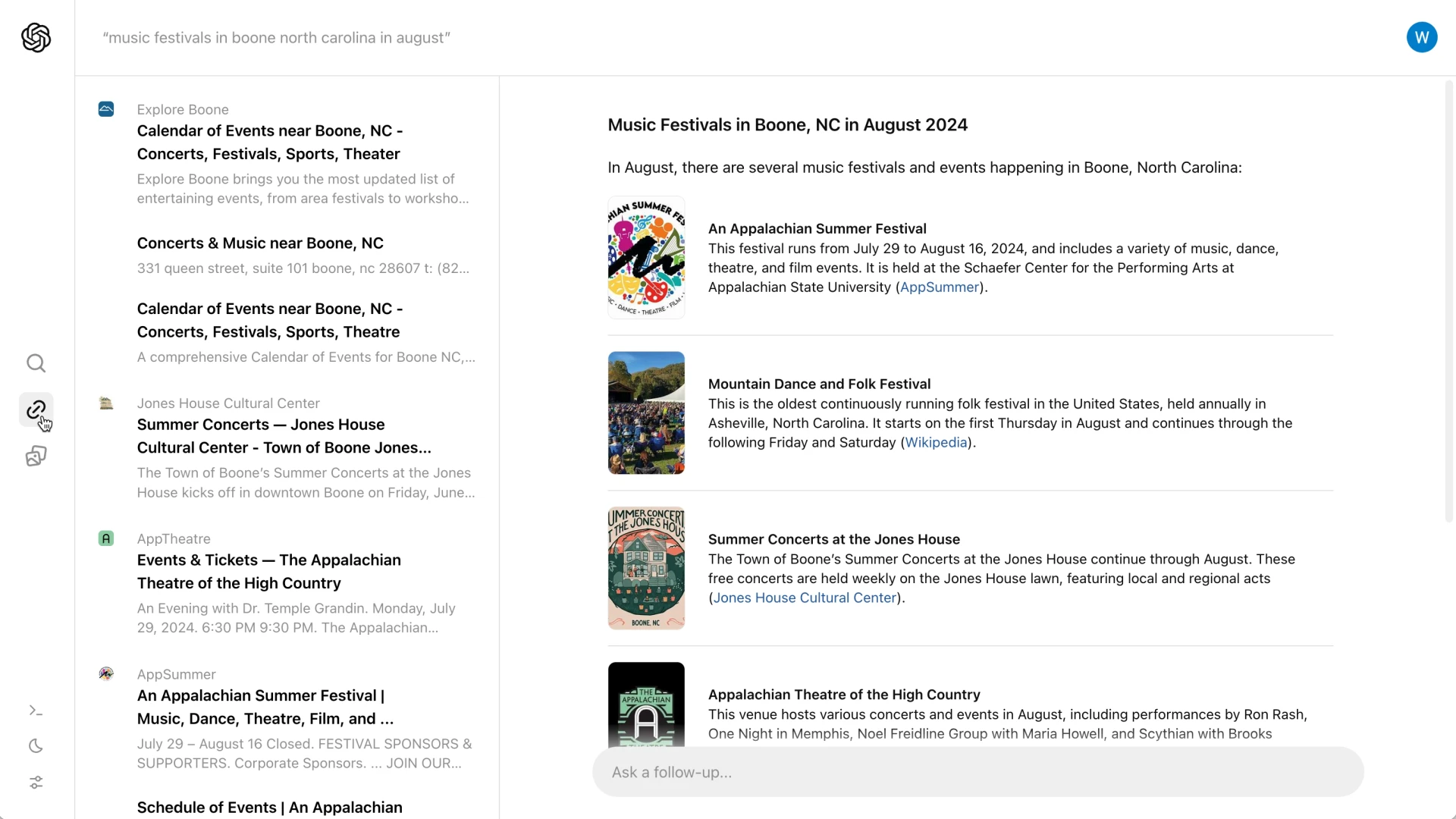

2.マルチモーダルAI:究極のオールラウンダー

この技術により、テキスト、画像、音声、動画が1つのシームレスなシステムに統合される。未来のバーチャルアシスタントが、単にあなたの言っていることを理解するだけでなく、あなたの口調や表情、周囲の状況までも察知するようになるのはそのためだ。

いくつか例を挙げよう:

- ヘルスケアマルチモーダルシステムは、複数の情報源からの医療データを分析し、より迅速で正確な診断を提供することができる。

- 日常生活:レビュー、写真、ビデオを瞬時に分析して旅行の計画を手助けしてくれるアシスタントを想像してみてほしい。

ガートナーは、2023年にはわずか1%であったジェネレーティブAIソリューションの40%が、2027年までにマルチモーダル化されると予測している。

3.合成データ:プライバシーに配慮したソリューション

AIシステムの学習にはデータが必要だが、実世界のデータにはプライバシーの問題や利用可能性の問題が伴うことが多い。合成データ-機密情報を公開することなく、本物に似せて人工的に生成されたデータセット-が登場した。

どのような展開になるかは次の通りだ:

スケーラブルなイノベーション:シミュレーション環境での自律走行車のトレーニングから、製薬研究のための希少な医療データの生成まで。

ガバナンスの必要性:開発者は、透明性、説明責任、規制基準との整合性を確保するために、監査しやすいシステムを統合するようになってきている。

シンセティック・データは、プライバシーを尊重しつつ、開発者の技術革新のスピードアップを支援する、Win-Winのものだ。

AIが変革する産業

AIはすでにこれらの主要分野で波紋を広げている:

| 産業 | 組織の役割の中でAIを定期的に使用している回答者の割合(出典:Gen AI) |

| マーケティングおよびセールス | 14% |

| 製品・サービス開発 | 13% |

| サービス業務 | 10% |

| リスク管理 | 4% |

| 戦略およびコーポレート・ファイナンス | 4% |

| 人事 | 3% |

| サプライチェーン・マネジメント | 3% |

| 製造業 | 2% |

ヘルスケア

AIは命を救っている。医療画像の分析から個別化された治療法の推奨まで、AIは医療をより賢く、より速く、より身近なものにしている。早期発見ツールはすでに従来の方法を凌駕しており、医師が問題が深刻化する前に発見するのに役立っている。

小売

ジェネレーティブAIは、超パーソナライズされたマーケティングキャンペーンを可能にし、予測在庫モデルは、サプライチェーンを需要パターンに合わせてより正確に調整することで、無駄を削減する。これらのテクノロジーを採用する小売企業は、業務効率の大幅な向上を報告している。マッキンゼーによると、ジェネレーティブAIは小売企業にとって2400億ドルから3900億ドルの経済的価値を引き出すという。

教育

アダプティブ・ラーニング(適応学習)にとどまらず、AIは現在、教育方法論を補強している。例えば、生成的なAIツールは、オーダーメイドのカリキュラムやインタラクティブな教材を作成することで教育者を支援し、管理負担を合理化する。

輸送・物流

AIとIoTシステムとの統合により、物流ネットワークの比類なき可視化が可能になり、グローバル・サプライチェーンのルート最適化、在庫管理、リスク軽減が強化された。

次はどうなる?2025年に注目すべきAIのトレンド

では、AIはどこへ向かうのか?未来を形作る大きなトレンドを紹介しよう:

1.自己改善型AIモデル

リアルタイムで自己改良するAIシステムは、重要なトレンドとして浮上している。これらの自己改善モデルは、継続的な学習ループを活用し、人間の監視を最小限に抑えながら精度と関連性を高める。使用例としては、リアルタイムの詐欺検知や適応型サイバーセキュリティなどがある。

2.合成データの新境地

合成データは、プライバシーを重視した用途にとどまらず、エッジケースに対応するAIのトレーニングや、稀な事象や危険な事象のシミュレーションなど、より高度なシナリオへと移行しつつある。自律走行のような産業は、コーナーケースを大規模にモデル化するために、この分野に多額の投資を行っている。

3.ドメイン固有のAIアーキテクチャ

一般化されたAIの時代は、ドメインに特化したアーキテクチャに道を譲りつつある。開発者たちは、金融、気候モデル、ゲノム研究といった特定の分野向けのモデルの微調整に注力し、新たなレベルの精度と効率性を引き出している。

4.エッジAIアットスケール

エッジAIは、クラウドに依存するのではなく、デバイス上でローカルにデータを処理する。そのリアルタイム機能は、ニッチなアプリケーションから主流の採用へと進化している。産業界はエッジコンピューティングを活用し、遠隔地の医療施設からスマート製造工場まで、接続が限られた環境で低遅延のAIモデルを展開している。

5.コラボレーションAIエコシステム

AIは、多様なモデルやプラットフォーム間の相互運用性を可能にするエコシステムによって、サイロ化されなくなってきている。これにより、特にヘルスケアや都市計画のようなマルチステークホルダー環境において、コラボレーションを通じたより強固なソリューションが促進される。

今後の課題

AIの未来は明るいが、ハードルがないわけではない。私たちが取り組むべきことは以下の通りだ:

規制と倫理

欧州連合のAI法やカリフォルニア州のデータ透明性法は、ほんの始まりに過ぎない。開発者と政策立案者は協力して、AIが責任を持って倫理的に使用されるようにしなければならない。

バイアスと公平性

モデルの解釈可能性が向上しても、バイアスのリスクは依然として大きい。開発者は、多様で高品質なデータセットを優先し、パイプラインに公平性の指標を組み込んで、意図しない結果を軽減しなければならない。

持続可能性

大規模なAIモデルのトレーニングには多くのエネルギーを使用する。モデル圧縮とエネルギー効率の高いハードウェアの革新は、AI開発と持続可能性の目標を一致させるために不可欠である。

未来への展望AIは未来をどう形成するか

AIが産業を再構築し、世界的な課題に対処する可能性は計り知れない。しかし、私たちの未来にどのような影響を与えるのだろうか?詳しく見てみよう:

グローバルな挑戦に力を与える

AIを搭載したツールは、気候パターンを分析し、再生可能エネルギー源を最適化し、自然災害をより高い精度で予測する。例えば、AIモデルは降雨パターンを予測し、最適な輪作を提案することで、農家が気候変動に適応するのを助けることができる。

AIは遠隔診断や治療提案を可能にすることで、医療アクセスを民主化している。サービスが行き届いていない地域では、AIツールが仮想医療提供者として機能し、医療従事者不足によるギャップを埋めている。

仕事を変える

AIは反復作業を自動化する一方で、AI倫理、システムトレーニング、人間とAIのコラボレーションといった役割の需要も生み出している。職場は人間とAIのダイナミックなパートナーシップになりつつあり、直感と共感を必要とするタスクはAIの精度とスケールによって補完される。

仕事の役割は、直接的なタスクの実行よりも、AIシステムのキュレーション、管理、監査へと進化していくだろう。

セキュリティの脅威に挑む

AIの高度化はリスクももたらす。AIやディープフェイク技術を利用したサイバー攻撃は、ますます蔓延しつつある。これに対抗するため、予測脅威モデルと自律対応システムは、すでに侵害への対応時間を数時間から数秒に短縮している。

まとめ未来への準備はできているか?

2025年はAIにとって単なる年ではない。エージェント型AI、マルチモーダルシステム、合成データといった進歩が産業を再形成する中、技術系起業家や開発者は、正確さと先見性をもってこの進化する状況をナビゲートする責任がある。未来とは、単にAIを採用することではなく、責任を持ってその軌道を形成することなのだ。