الشروع في العمل مع أدوات الأنثروبولوجيا

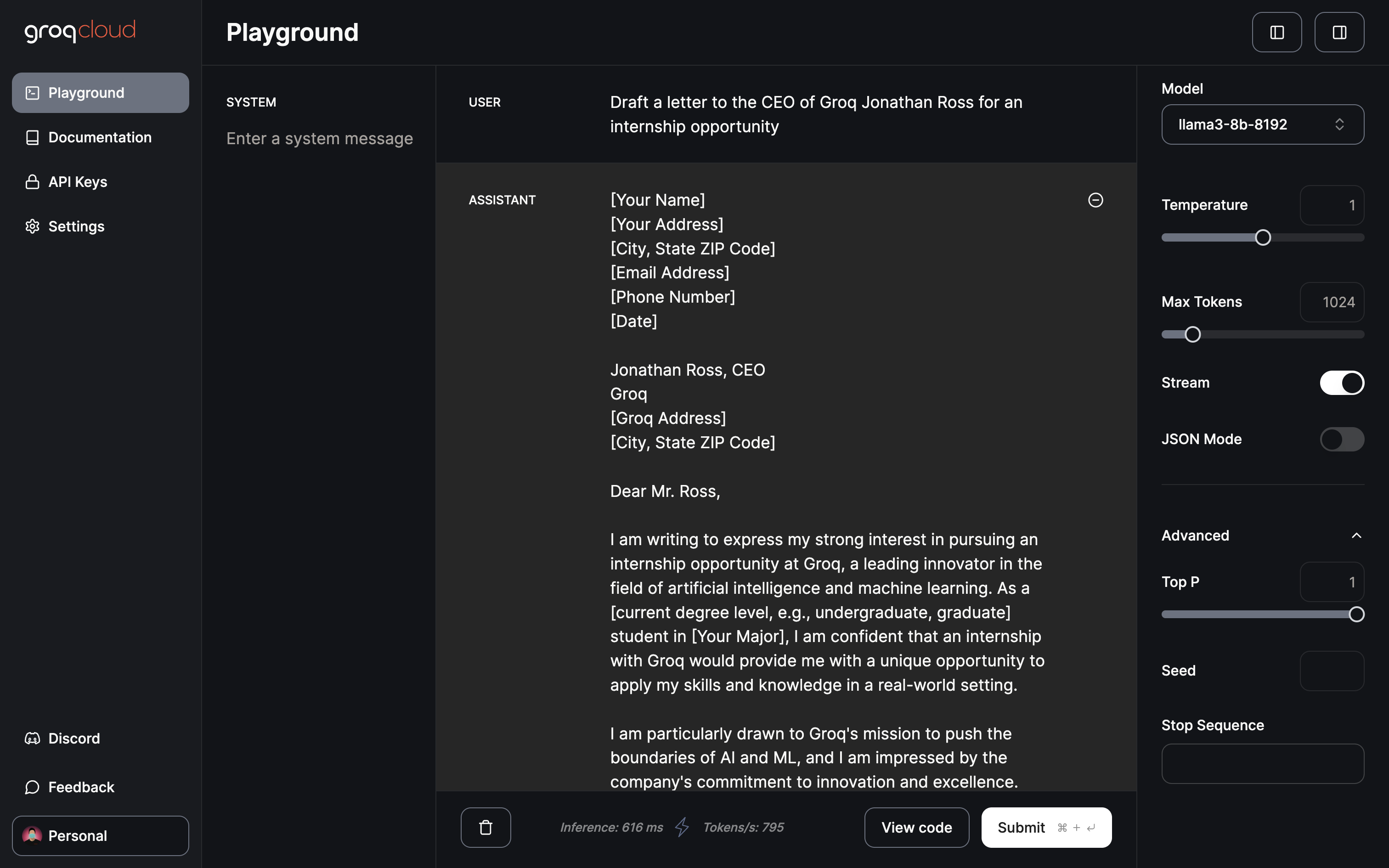

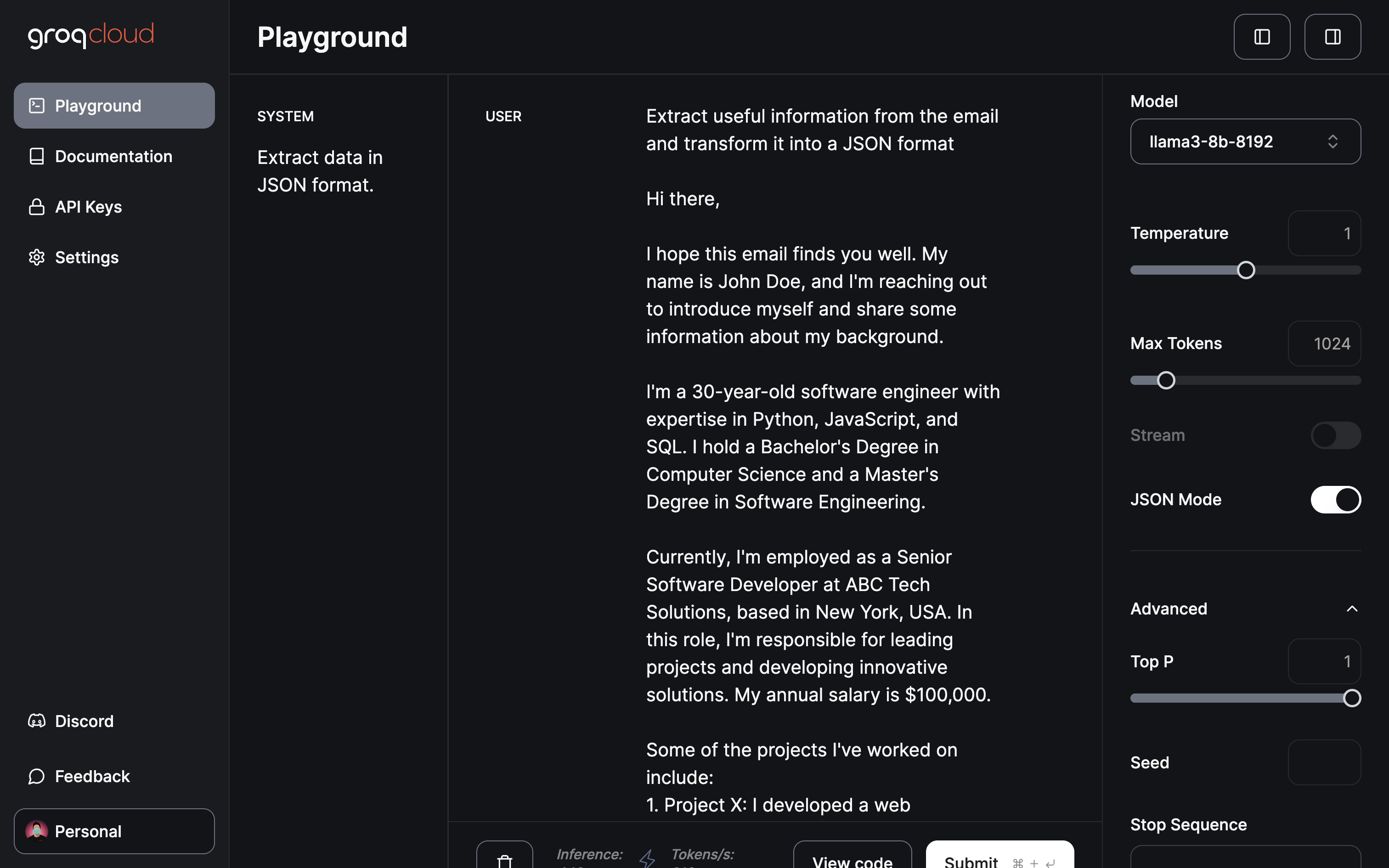

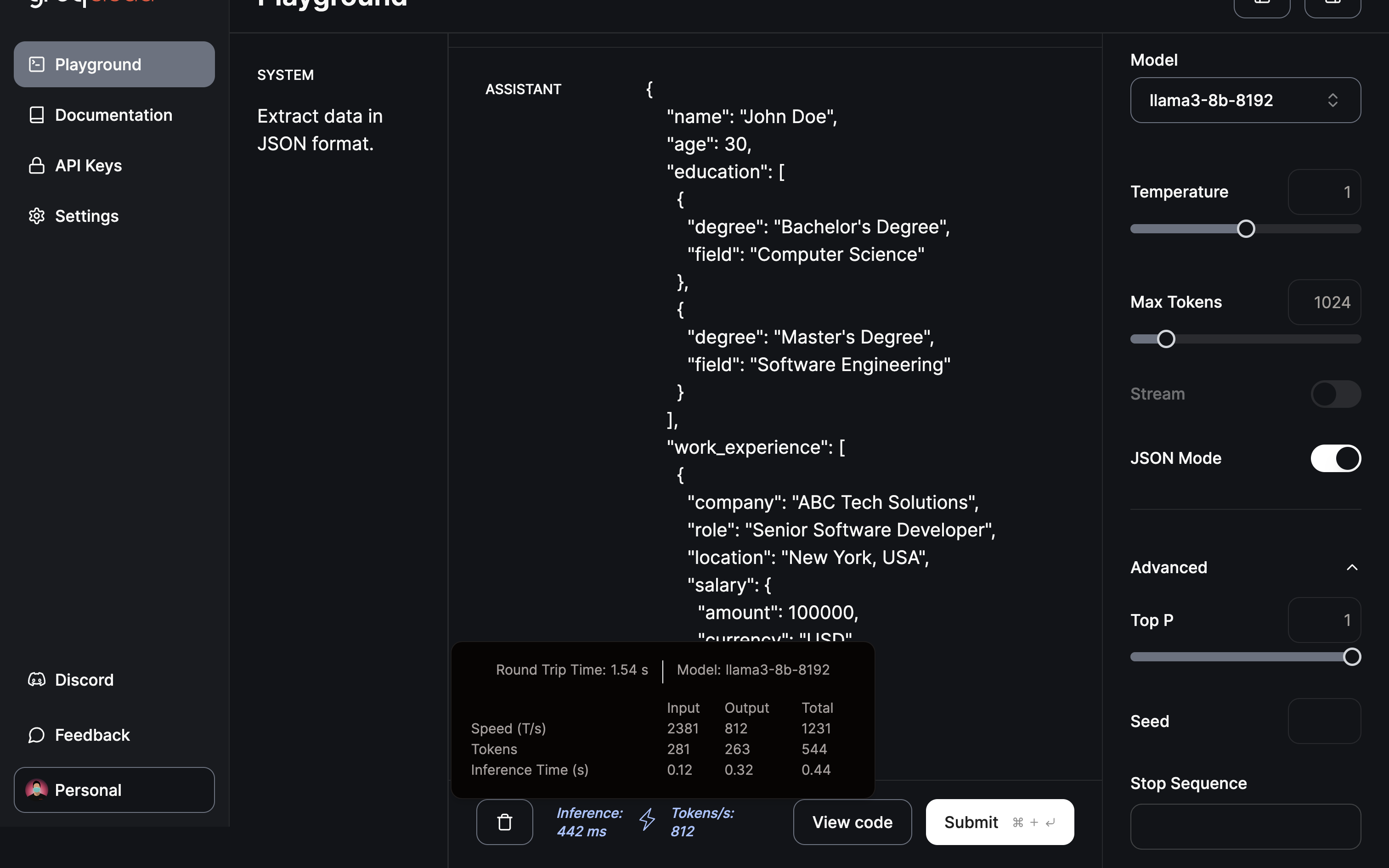

أكبر فائدة من استخدام LLMs للمهام هي تنوعها. يمكن مطالبة LLMs بطرق محددة لخدمة عدد لا يحصى من الأغراض ، وتعمل كواجهات برمجة تطبيقات لإنشاء النص أو تحويل البيانات غير المهيكلة إلى تنسيقات منظمة. يلجأ الكثير منا إلى ChatGPT لمهامنا اليومية ، سواء كان ذلك في إنشاء رسائل بريد إلكتروني أو الانخراط في مناقشات مرحة مع الذكاء الاصطناعي.

تدور بنية المكونات الإضافية ، والمعروفة أيضا باسم “GPTs” ، حول تحديد الكلمات الرئيسية من الردود والاستعلامات وتنفيذ الوظائف ذات الصلة. تتيح هذه المكونات الإضافية التفاعل مع التطبيقات الخارجية أو تشغيل وظائف مخصصة.

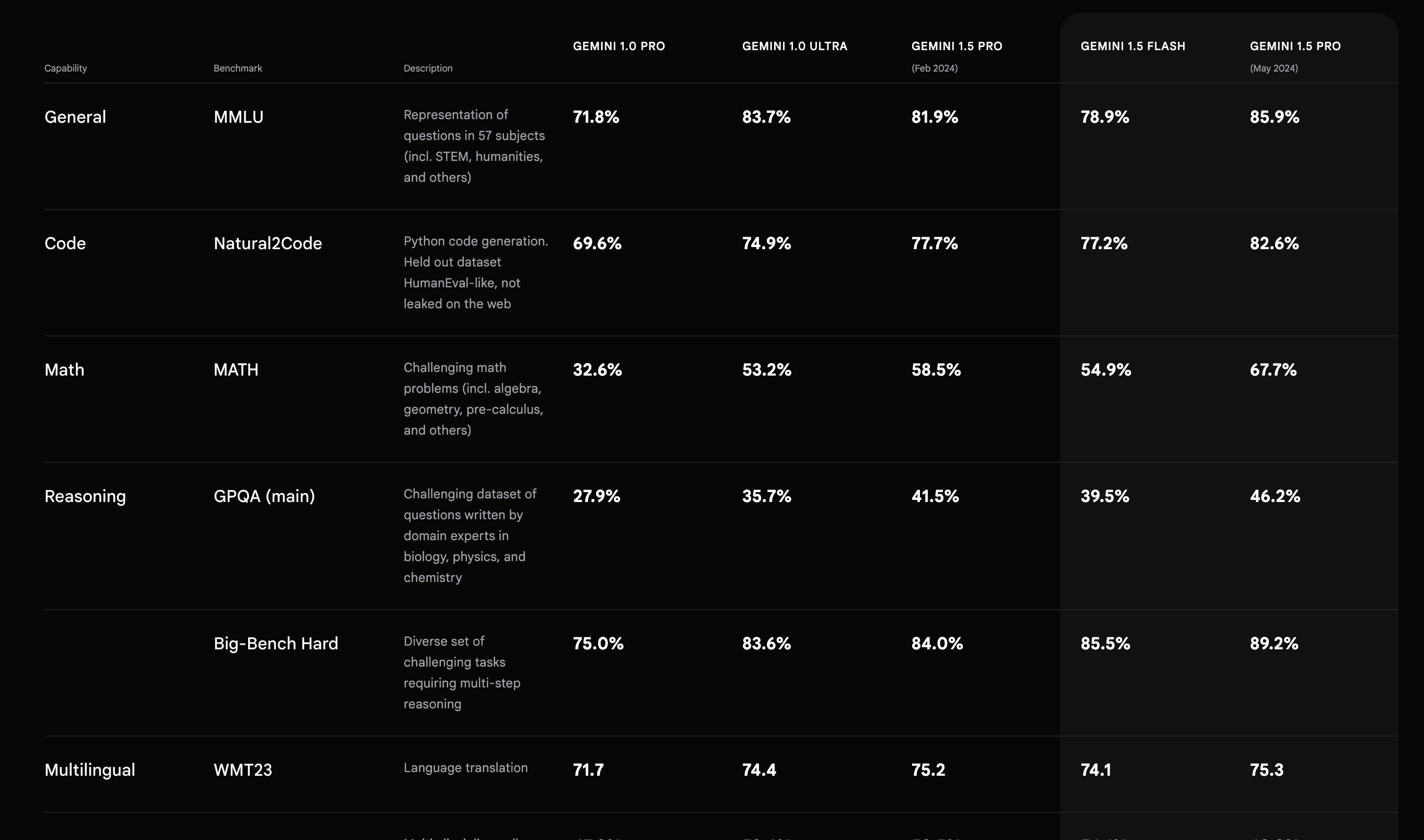

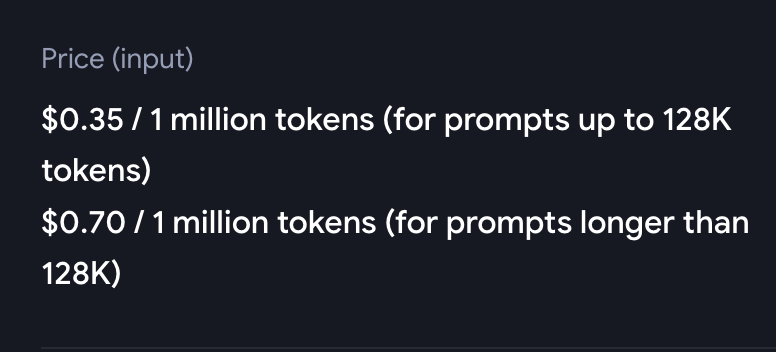

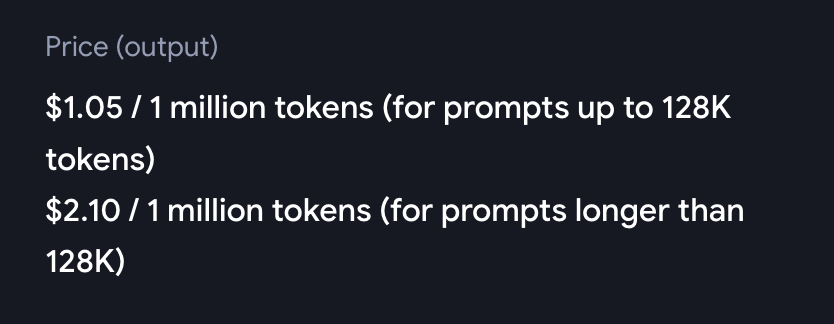

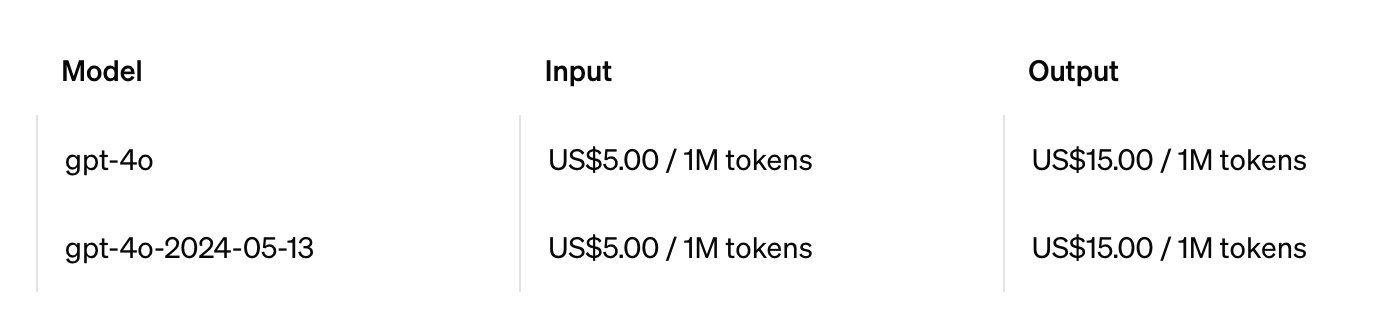

بينما قادت OpenAI الطريق في تمكين استدعاءات الوظائف الخارجية لتنفيذ المهام ، قدمت Anthropic مؤخرا ميزة محسنة تسمى “استخدام الأدوات” ، لتحل محل آلية استدعاء الوظائف السابقة. يبسط هذا الإصدار المحدث التطوير من خلال استخدام JSON بدلا من علامات XML. بالإضافة إلى ذلك ، تفتخر Claude-3 Opus بميزة على طرازات GPT مع نافذة السياق الأكبر التي تبلغ 200 ألف رمز ، وهي قيمة خاصة في سيناريوهات محددة.

في هذه المدونة ، سوف نستكشف مفهوم “استخدام الأدوات” ، ونناقش ميزاته ، ونقدم إرشادات حول البدء.

ما هو “استخدام الأداة”؟

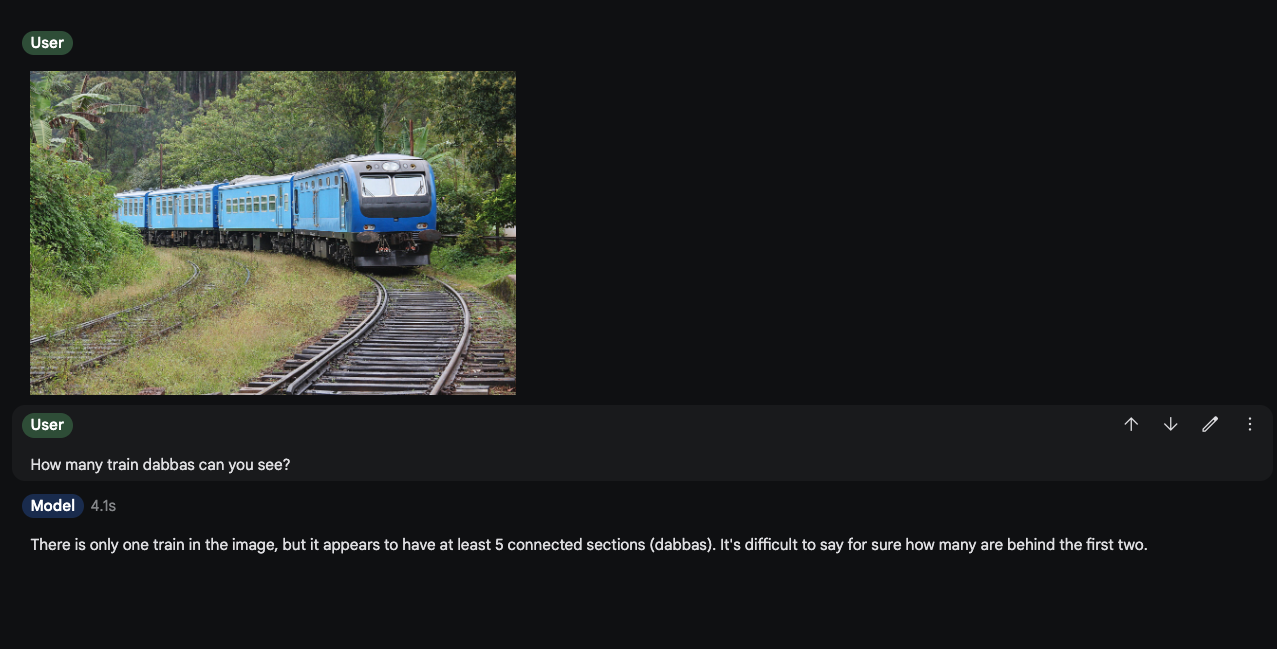

يتمتع كلود بالقدرة على التفاعل مع الأدوات والوظائف الخارجية من جانب العميل، مما يتيح لك تزويد كلود بأدواتك المخصصة لمجموعة واسعة من المهام.

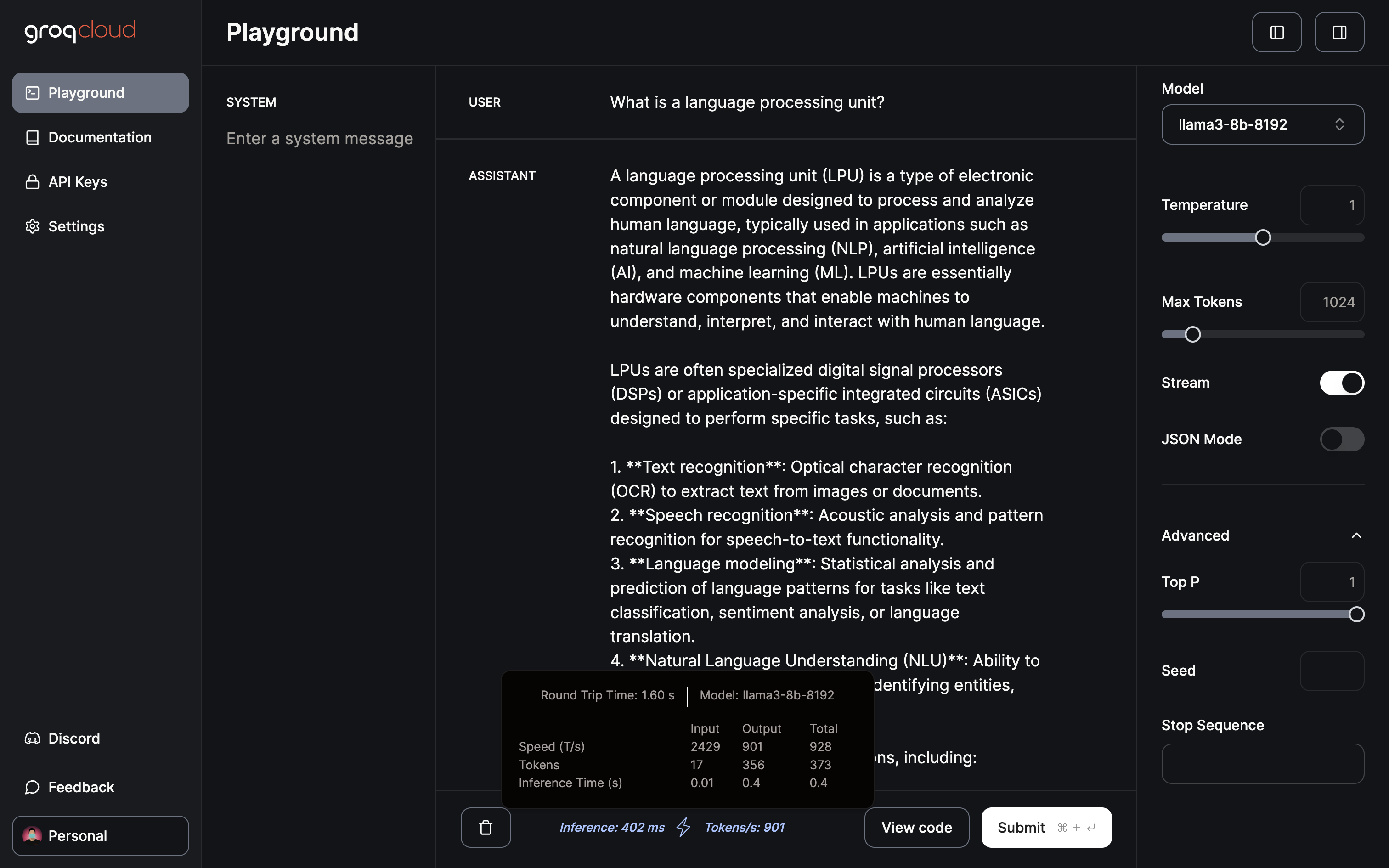

سير العمل لاستخدام أدوات مع كلود هو كما يلي:

- تزويد كلود بالأدوات وموجه المستخدم (طلب واجهة برمجة التطبيقات)

- حدد مجموعة من الأدوات ليختار كلود من بينها.

- قم بتضمينها مع استعلام المستخدم في موجه إنشاء النص.

- كلود يختار أداة

- يحلل كلود موجه المستخدم ويقارنه بجميع الأدوات المتاحة لتحديد الأداة الأكثر صلة.

- باستخدام عملية “التفكير” الخاصة ب LLM ، فإنه يحدد الكلمات الرئيسية المطلوبة للأداة ذات الصلة.

- توليد الاستجابة (استجابة API)

- عند الانتهاء من العملية ، يتم إنشاء موجه التفكير ، جنبا إلى جنب مع الأداة والمعلمات المحددة ، كمخرجات.

بعد هذه العملية ، تقوم بتنفيذ الوظيفة / الأداة المحددة واستخدام مخرجاتها لإنشاء استجابة أخرى إذا لزم الأمر.

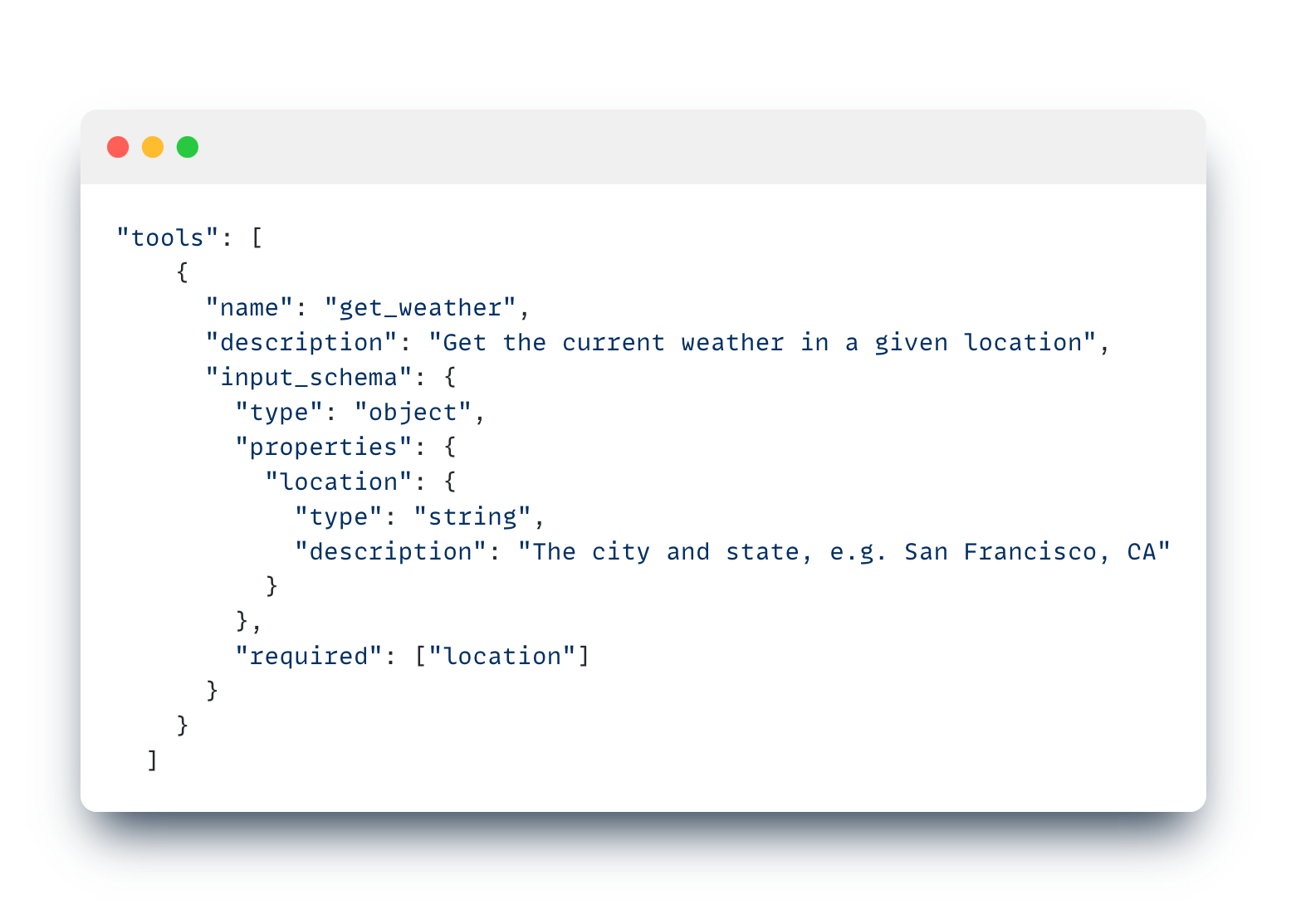

المخطط العام للأداة

يعمل هذا المخطط كوسيلة لتوصيل متطلبات عملية استدعاء الوظيفة إلى LLM. لا يستدعي مباشرة أي وظيفة أو يؤدي إلى أي إجراء من تلقاء نفسه. لضمان التحديد الدقيق للأدوات ، يجب تقديم وصف مفصل لكل أداة. Properties داخل المخطط يتم استخدامها لتحديد المعلمات التي سيتم تمريرها إلى الوظيفة في مرحلة لاحقة.

مظاهره

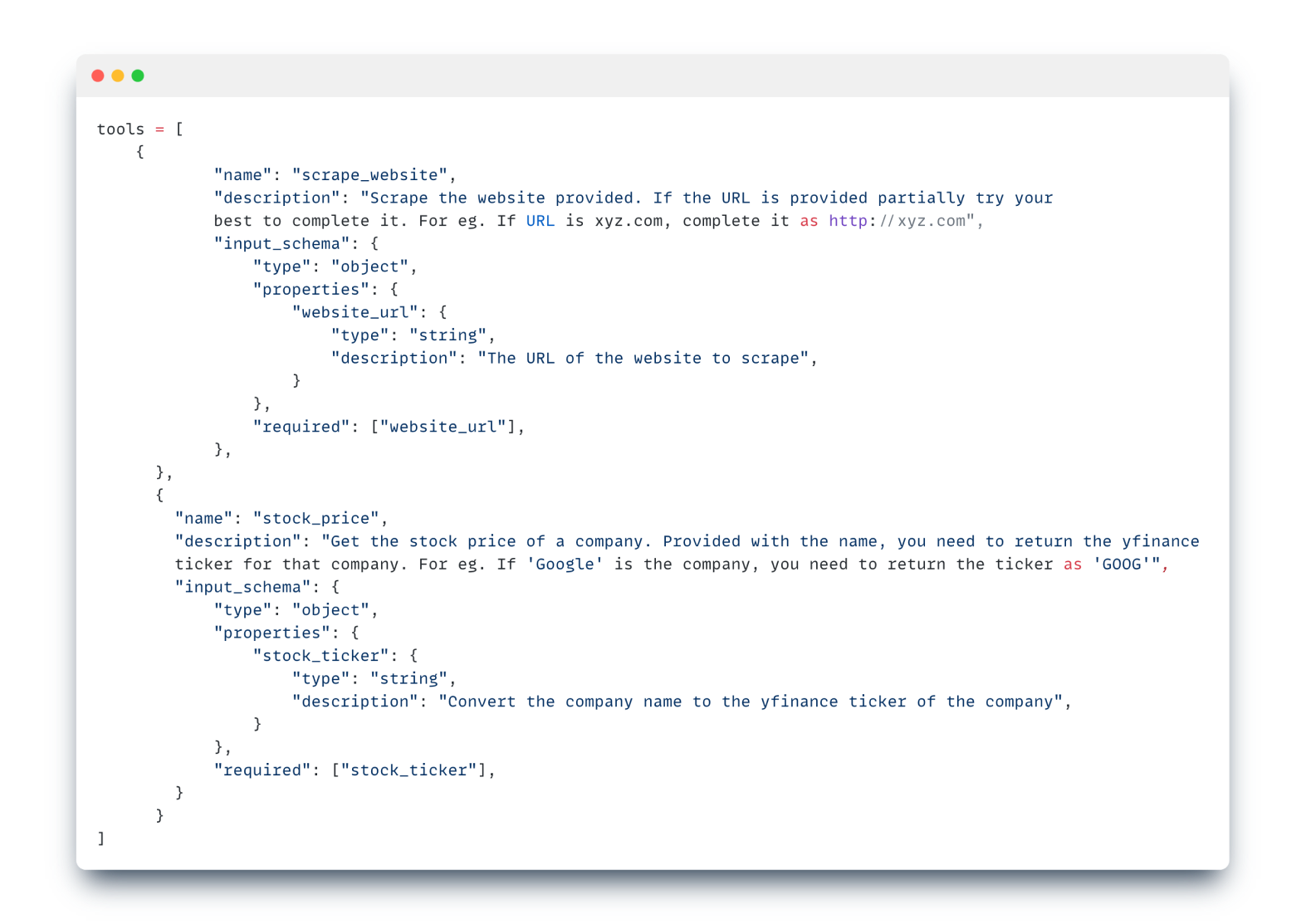

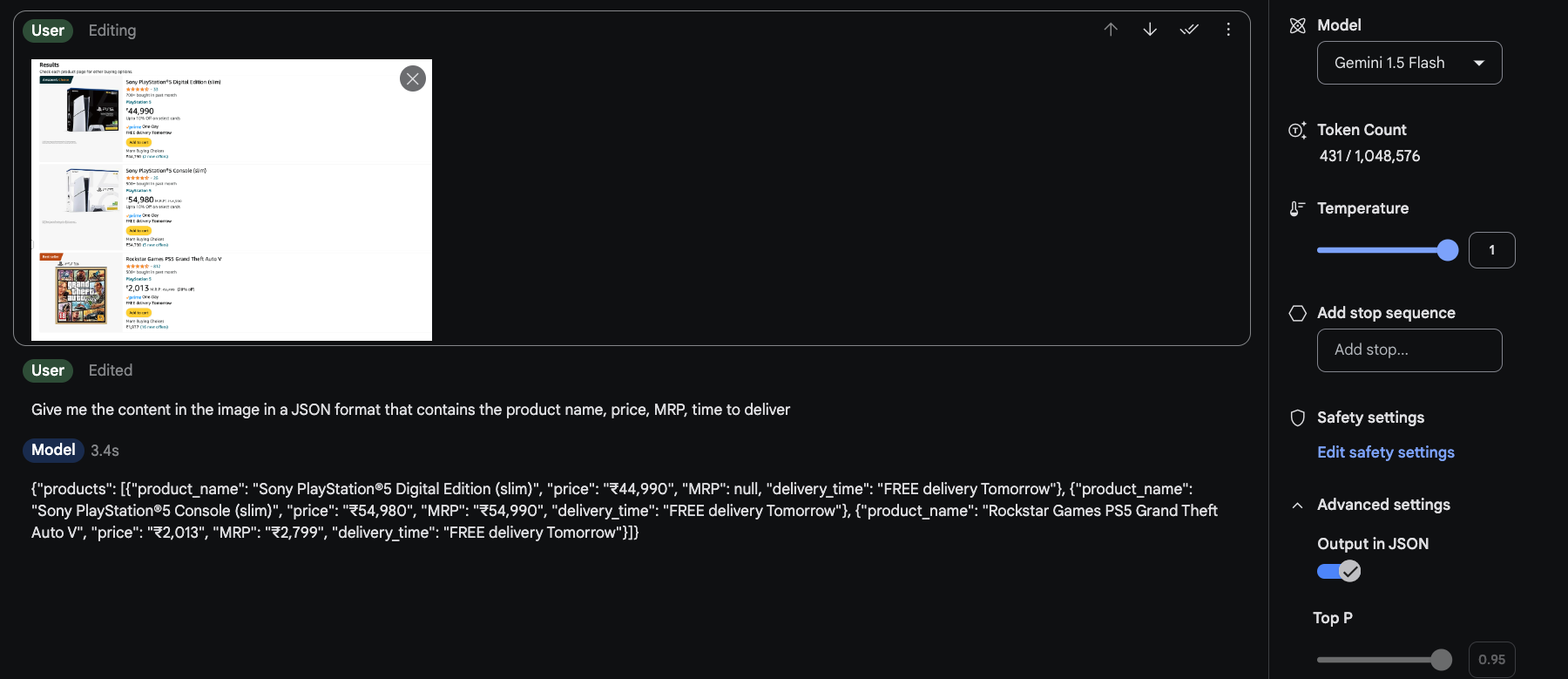

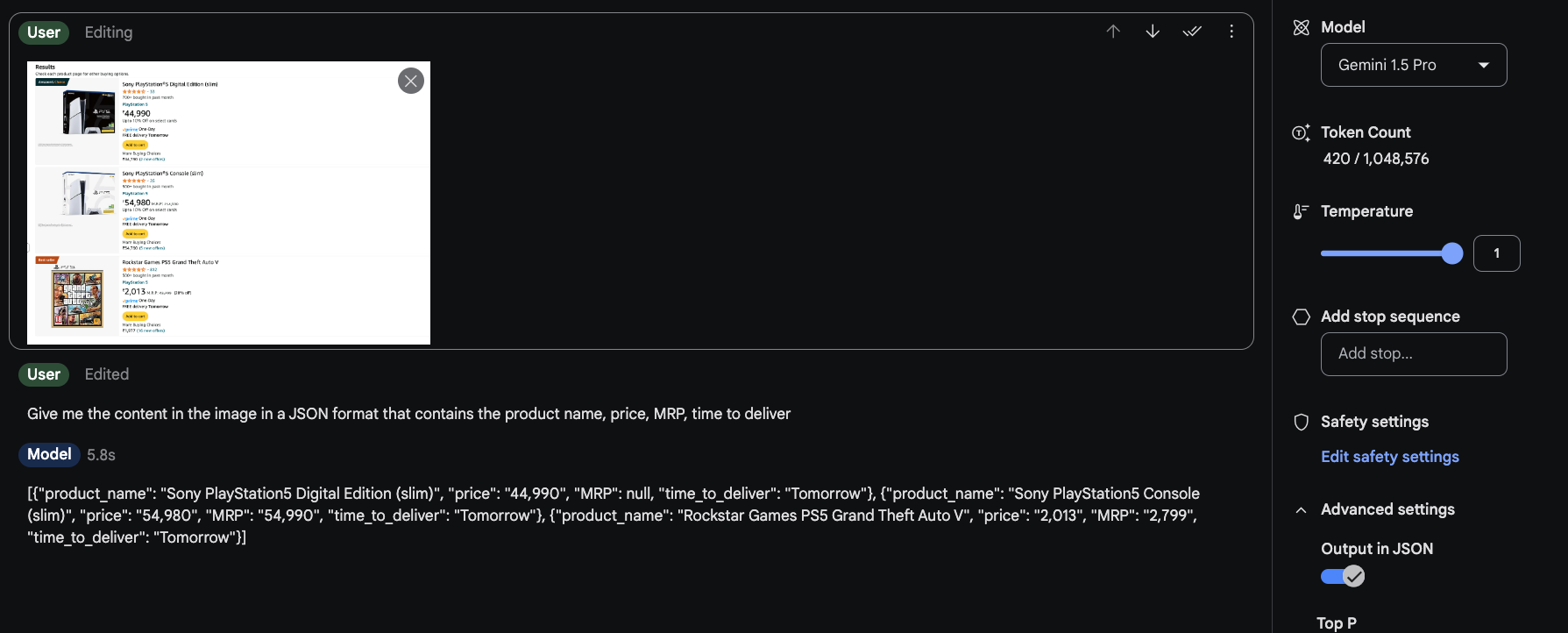

دعنا نمضي قدما ونبني أدوات لكشط الويب وإيجاد سعر أي سهم.

مخطط الأدوات

في الأداة scrape_website ، ستجلب عنوان URL لموقع الويب من موجه المستخدم. بالنسبة للأداة stock_price ، ستحدد اسم الشركة من موجه المستخدم وتحوله إلى شريط yfinance.

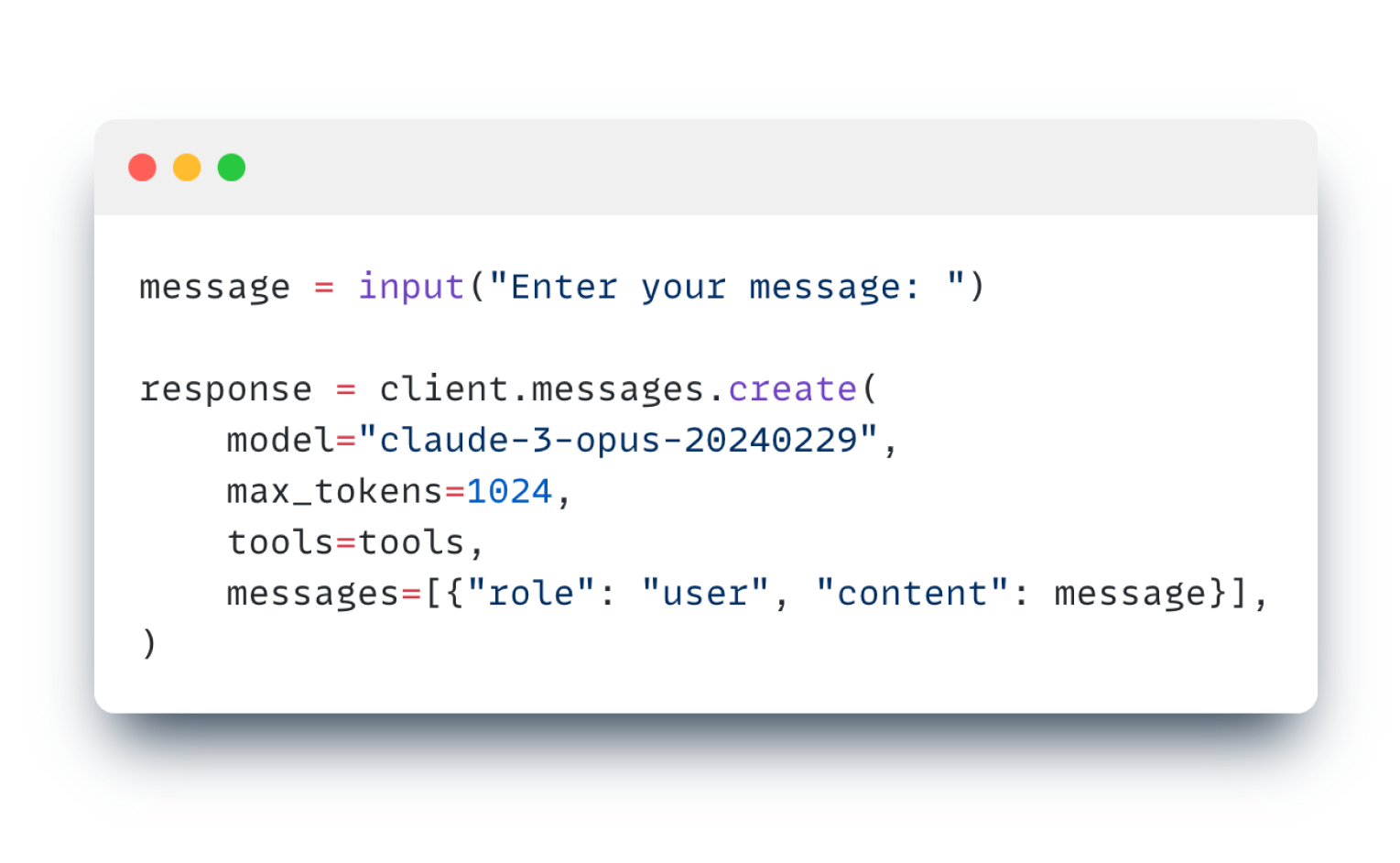

موجه المستخدم

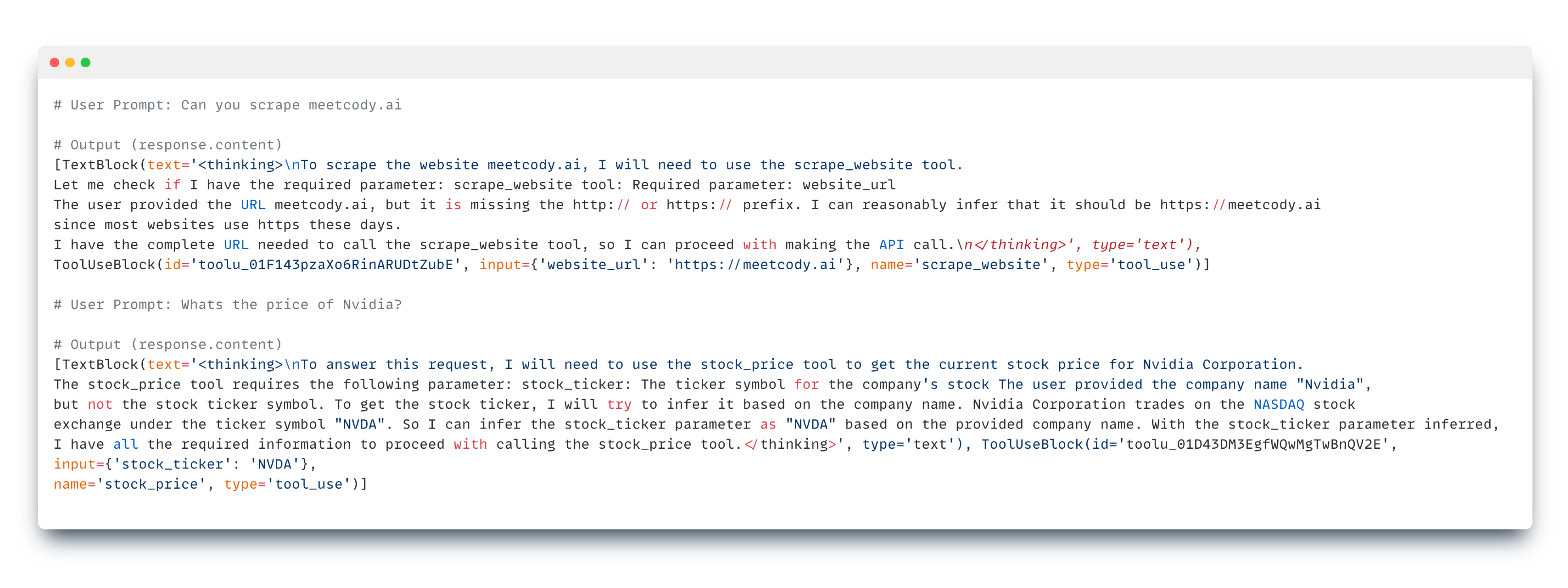

طرح استعلامين على الروبوت ، واحد لكل أداة ، يعطينا المخرجات التالية:

تسرد عملية التفكير جميع الخطوات التي اتخذتها LLM لتحديد الأداة الصحيحة بدقة لكل استعلام وتنفيذ التحويلات اللازمة كما هو موضح في أوصاف الأداة.

اختيار الأداة ذات الصلة

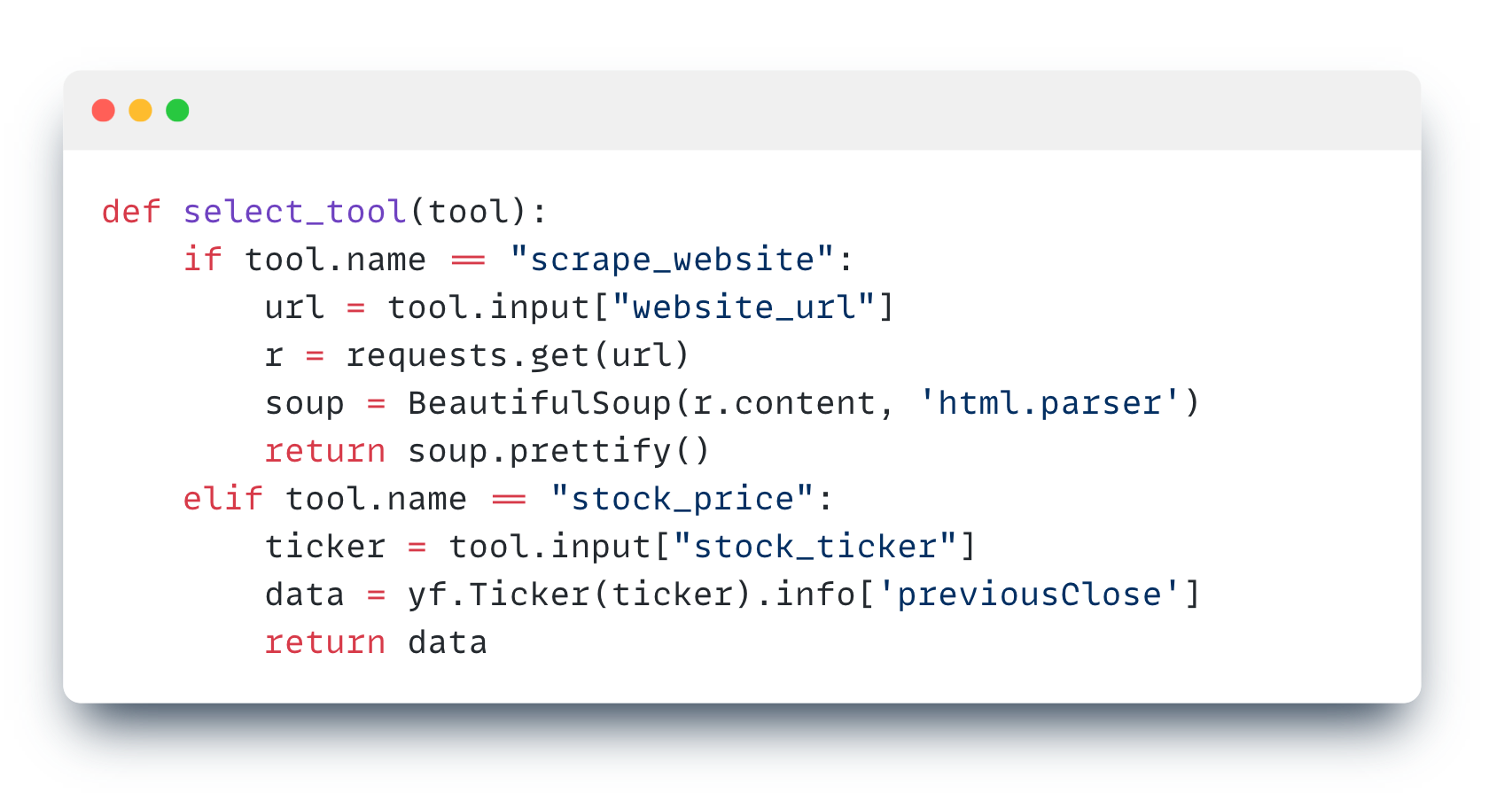

سيتعين علينا كتابة بعض التعليمات البرمجية الإضافية التي ستؤدي إلى تشغيل الوظائف ذات الصلة بناء على الظروف.

تعمل هذه الوظيفة على تنشيط التعليمات البرمجية المناسبة بناء على اسم الأداة الذي تم استرداده في استجابة LLM. في الحالة الأولى ، نقوم بكشط عنوان URL لموقع الويب الذي تم الحصول عليه من إدخال الأداة ، بينما في الحالة الثانية ، نجلب مؤشر الأسهم ونمرره إلى مكتبة yfinance python.

تنفيذ الوظائف

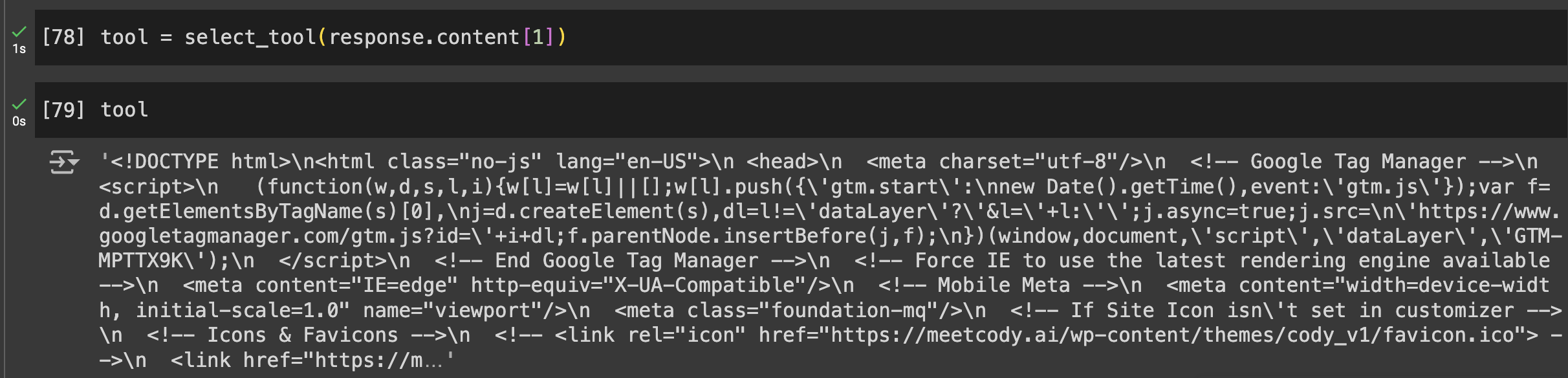

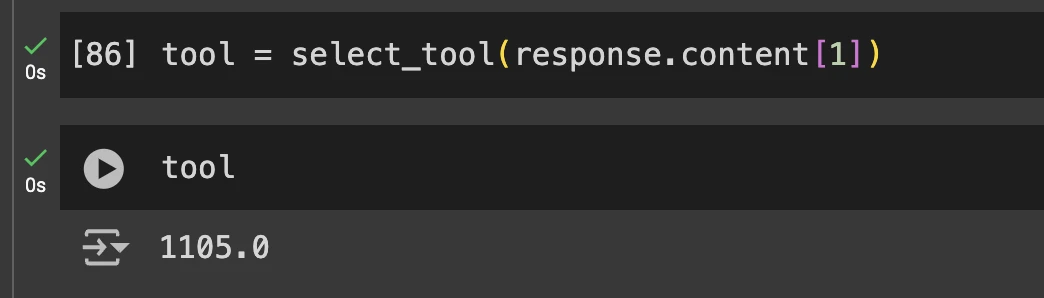

سنقوم بتمرير الوظيفة بالكامل ToolUseBlock select_tool() لتشغيل الكود ذي الصلة.

النواتج

- الموجه الأول

- الموجه الثاني

إذا كنت تريد عرض التعليمات البرمجية المصدر بالكامل لهذا العرض التوضيحي، يمكنك عرض دفتر الملاحظات هذا.

بعض حالات الاستخدام

تعمل ميزة “استخدام الأداة” لكلود على رفع تعدد استخدامات LLM إلى مستوى جديد تماما. في حين أن المثال المقدم أساسي ، إلا أنه بمثابة أساس لتوسيع الوظائف. إليك تطبيق واقعي واحد منه:

أمس أطلقت @AnthropicAI أداة استخدام بيتا!

إليك مثال على شيء قمت بإنشائه به: روبوت خدمة العملاء يمكنه بالفعل حل مشكلتك!

نتطلع إلى رؤية ما يبنيه الناس أيضا! https://t.co/Xmi7pnwouS pic.twitter.com/T5bE4peexR

– إريك شلونتز (@ErikSchluntz) 5 أبريل 2024

للعثور على المزيد من حالات الاستخدام ، يمكنك زيارة المستودع الرسمي ل Anthropic

هنا

.

![Gemma] بناء الذكاء الاصطناعي مساعد لعلوم 🤖 البيانات](https://blogger.googleusercontent.com/img/b/R29vZ2xl/AVvXsEgg06dhS6iRpIv8hvyonlwncW-RC5n59E8vhaWRgIVqTP-Z1AbTBDtdJsX8ClDILimlGWlRAIORuZn8349TfUFmgqYyCRcoctTvNC_Kv70z41hCKd-0Fy4Ic4EgKyY0LxQ5rDt1eXi3jvEcTxgTC62glTl4e5Cffge50iiF0fxCBqmq9v-u7KTfIL4Lxb0/s1600/Gemma_social.png)