Google vs OpenAI: czy Google wygrywa?

Po tym, jak Bard nie trafił w gusta fanów AI, Google niedawno zaprezentowało swój najnowszy produkt AI, Gemini. W ramach tej premiery Bard został przemianowany na Gemini i teraz zawiera nowy Gemini Pro LLM. Przyjrzyjmy się bliżej zakresowi tych zmian.

Czym jest Gemini AI?

Gemini reprezentuje najnowszy duży model językowy Google (LLM), po wydaniu LaMDA i PaLM. W przeciwieństwie do swoich poprzedników, Gemini jest natywnie multimodalny, zdolny do rozumienia tekstu, obrazów, mowy i kodu, a także oferuje ulepszone zdolności rozumienia i rozumowania.

Warianty Gemini AI

Sztuczna inteligencja Gemini składa się z trzech dużych modeli językowych:

- Gemini Nano: Zoptymalizowany pod kątem wydajności na urządzeniu, zapewniający szybkie rozwiązania AI bezpośrednio na urządzeniu osobistym.

- Gemini Pro: Wszechstronny i skalowalny model, zdolny do radzenia sobie z różnorodnymi zadaniami z solidną wydajnością. Dostępna w darmowej wersji interfejsu czatu Gemini.

- Gemini Ultra: Szczyt serii Gemini, umożliwiający rozwiązywanie złożonych problemów i rozwijający możliwości sztucznej inteligencji. Wyłącznie dla subskrybentów planu Google One AI Premium.

Modele Gemini zostały wytrenowane przy użyciu TPUv5e i TPUv4, w zależności od ich rozmiarów i konfiguracji. Training Gemini Ultra wykorzystywał dużą flotę akceleratorów TPUv4 należących do Google w wielu centrach danych. Stanowi to znaczny wzrost skali w porównaniu z poprzednim flagowym modelem PaLM-2, który stanowił nowe wyzwania infrastrukturalne.

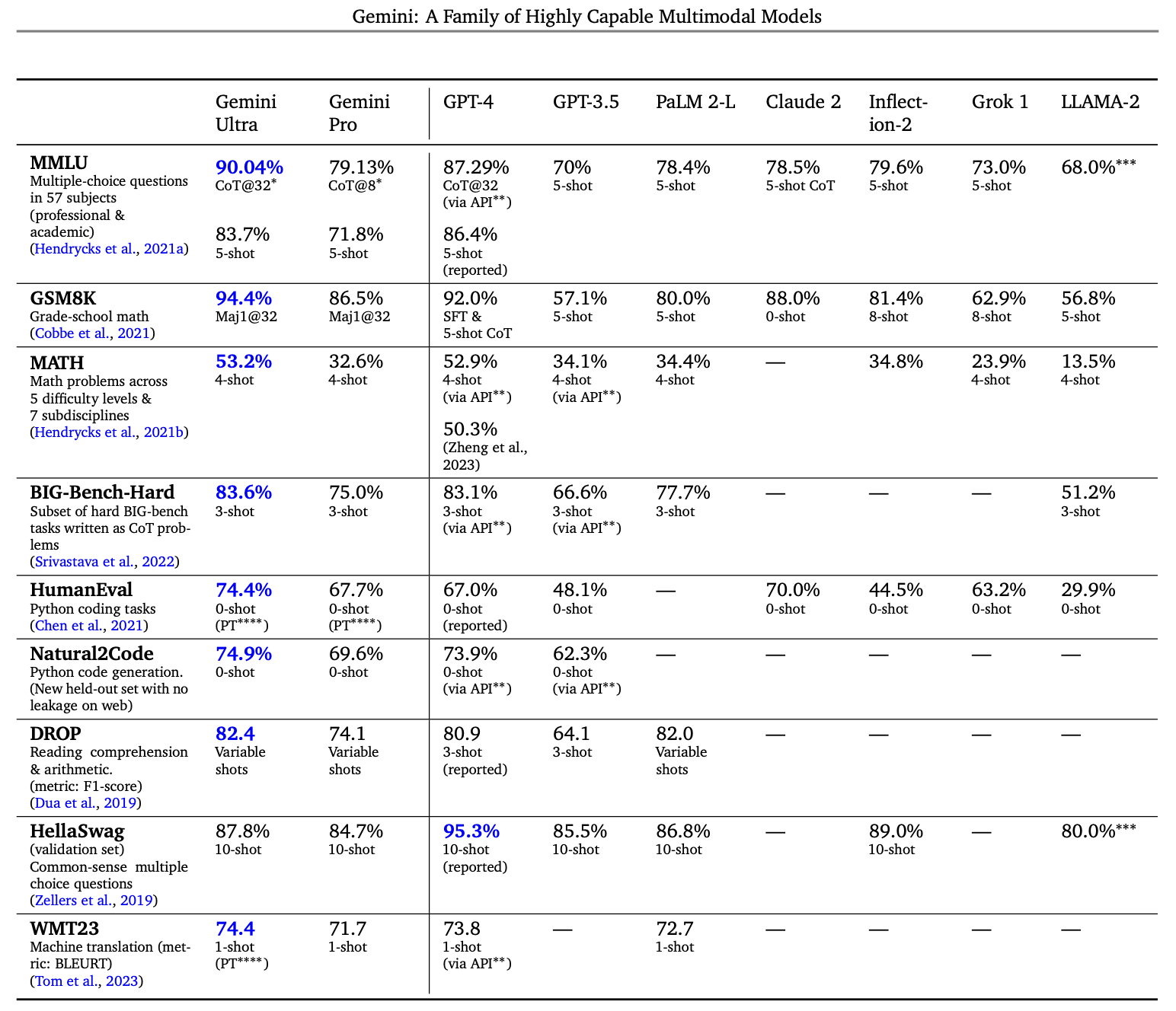

Porównanie Gemini z innymi programami LLM

Zrozumienie tekstu

Źródło: Google Deepmind

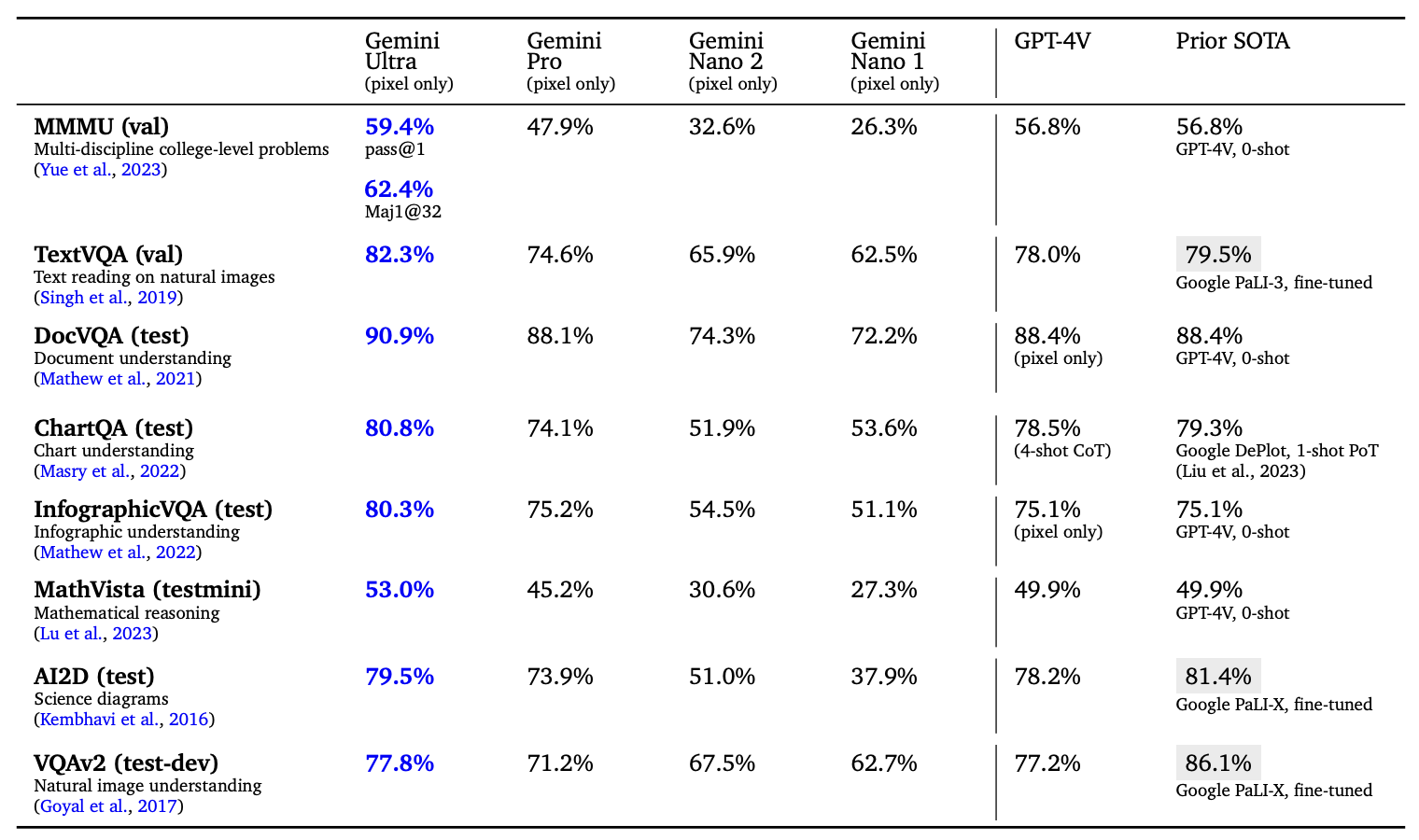

Zrozumienie obrazu

Źródło: Google Deepmind

Więcej na ten temat można przeczytać tutaj.

Zalety Gemini

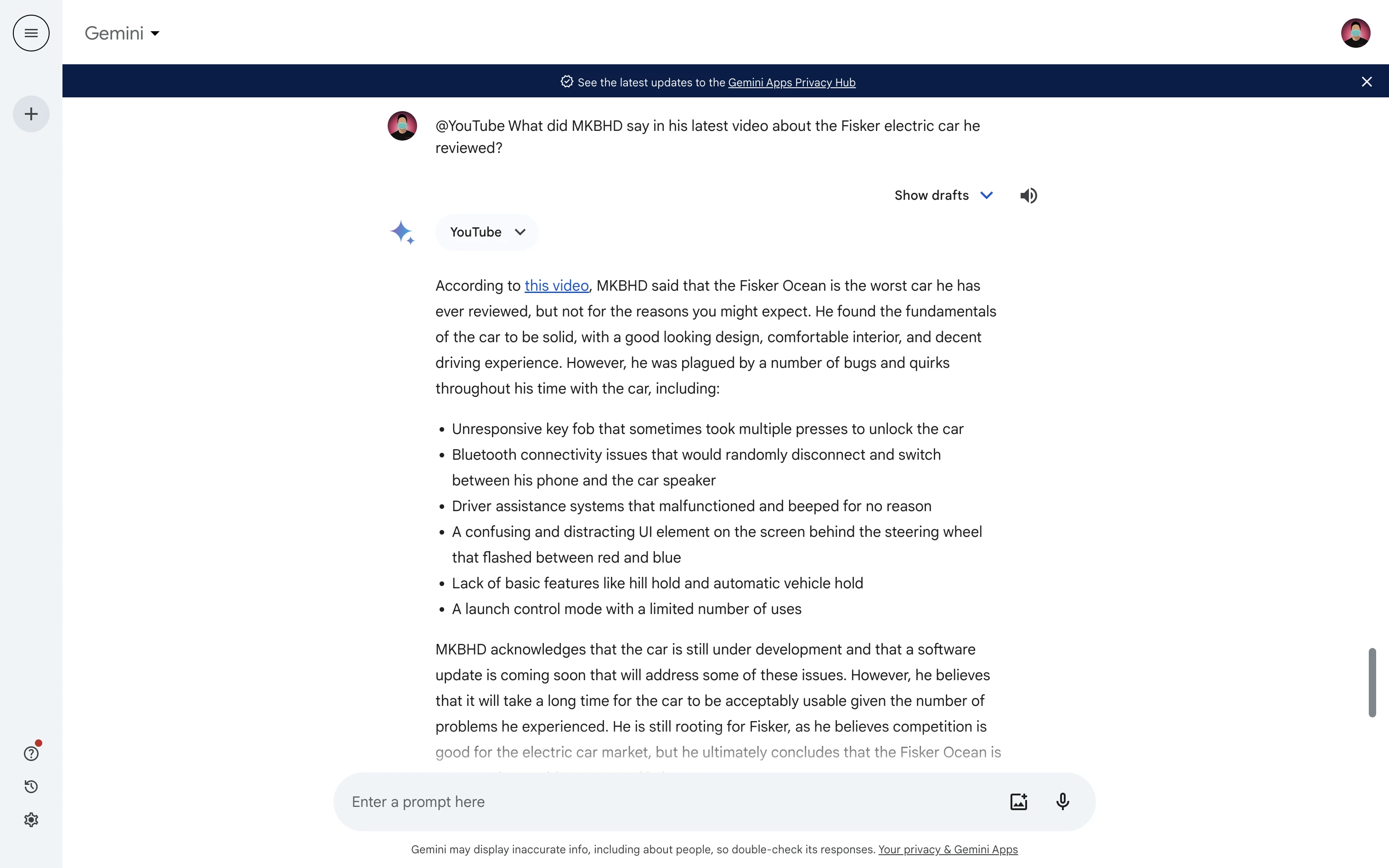

1. Płynna integracja ze wszystkimi aplikacjami Google

Gemini płynnie integruje się teraz ze wszystkimi aplikacjami Google, w tym Mapami, YouTube, Gmailem i nie tylko. Aby zapytać o konkretne aplikacje, wystarczy poprzedzić nazwę aplikacji znakiem “@”, a następnie zapytać. Podczas gdy podobne integracje są osiągalne w ChatGPT przy użyciu GPT i wtyczek, mogą one nie oferować takiego samego poziomu płynności jak natywne integracje Gemini.

Słynne doświadczenie Google w technologii wyszukiwarek niewątpliwie rozszerza możliwości Gemini w zakresie przeglądania stron internetowych. Wykorzystując fundamentalne zalety algorytmów wyszukiwania i indeksowania, Gemini oferuje użytkownikom płynne i wydajne przeglądanie.

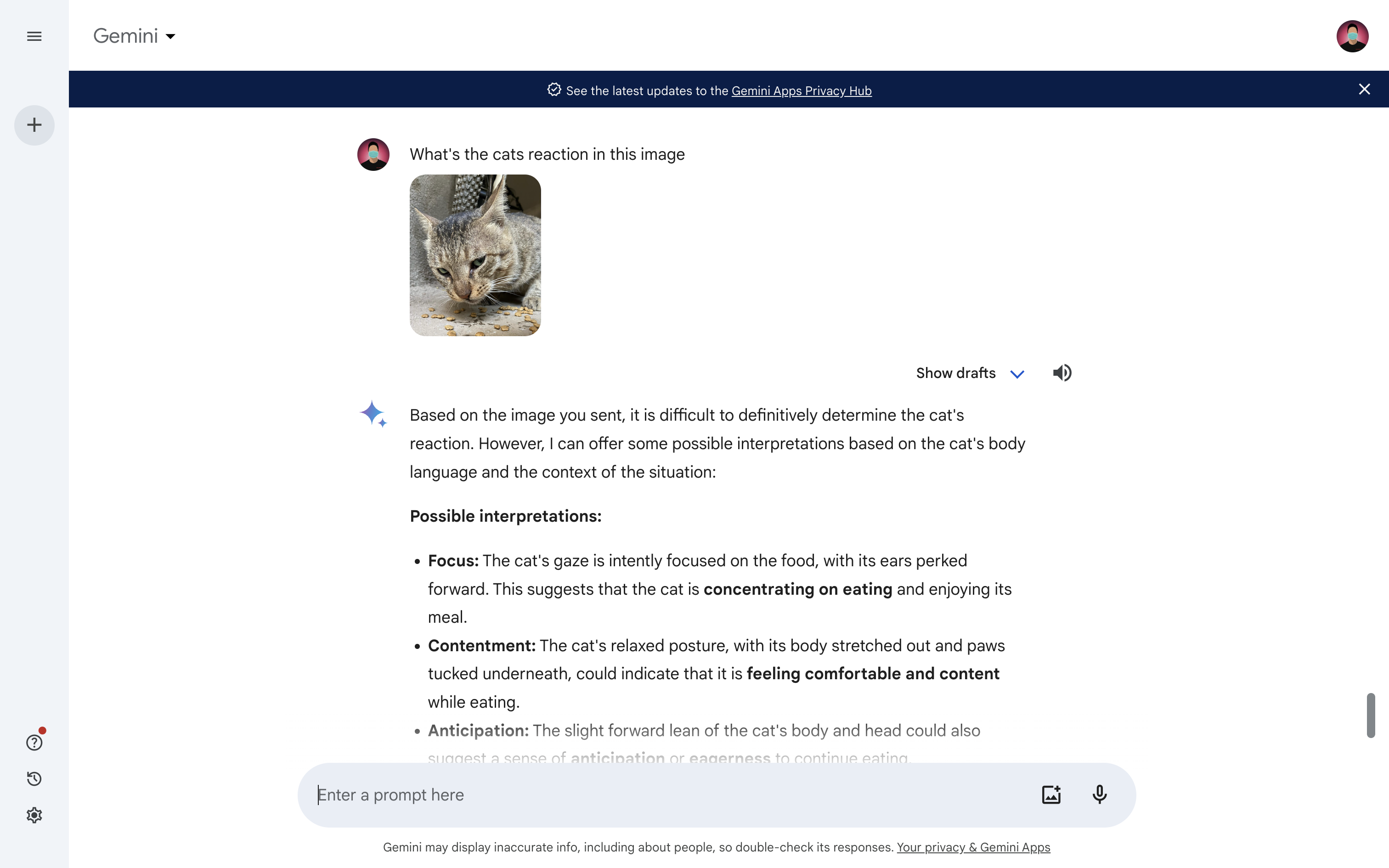

2. Możliwości multimodalne

Gemini zapewnia teraz funkcje multimodalne, w tym rozumienie obrazu, w interfejsie czatu Gemini bez dodatkowych kosztów. Chociaż jego wydajność podczas testów była przyzwoita, może nie dorównywać dokładności GPT-4V. Niemniej jednak, biorąc pod uwagę, że jest darmowy, nie możemy narzekać, prawda? 😉 Istnieje szansa, że Gemini Ultra może przewyższać GPT-4V w oparciu o metryki

3. Bezpłatny dostęp dla hobbystów i studentów

Dla aspirujących programistów LLM, którzy chcą zanurzyć się w tej dziedzinie, ale napotykają ograniczenia w dostępie do interfejsów API GPT ze względu na koszty, Google oferuje bezpłatny dostęp do interfejsu API Gemini Pro 1.0. Dzięki temu można wykonać do 60 zapytań na minutę w Google AI Studio, bezpłatnym internetowym narzędziu dla programistów. Google AI Studio umożliwia szybkie tworzenie podpowiedzi i uzyskanie klucza API do tworzenia aplikacji. Logując się do Google AI Studio za pomocą konta Google, możesz skorzystać z tego bezpłatnego limitu. To doskonała okazja, aby rozpocząć swoją przygodę z LLM i zapoznać się z osadzaniem, wektorowymi bazami danych, wyszukiwaniem semantycznym i nie tylko.

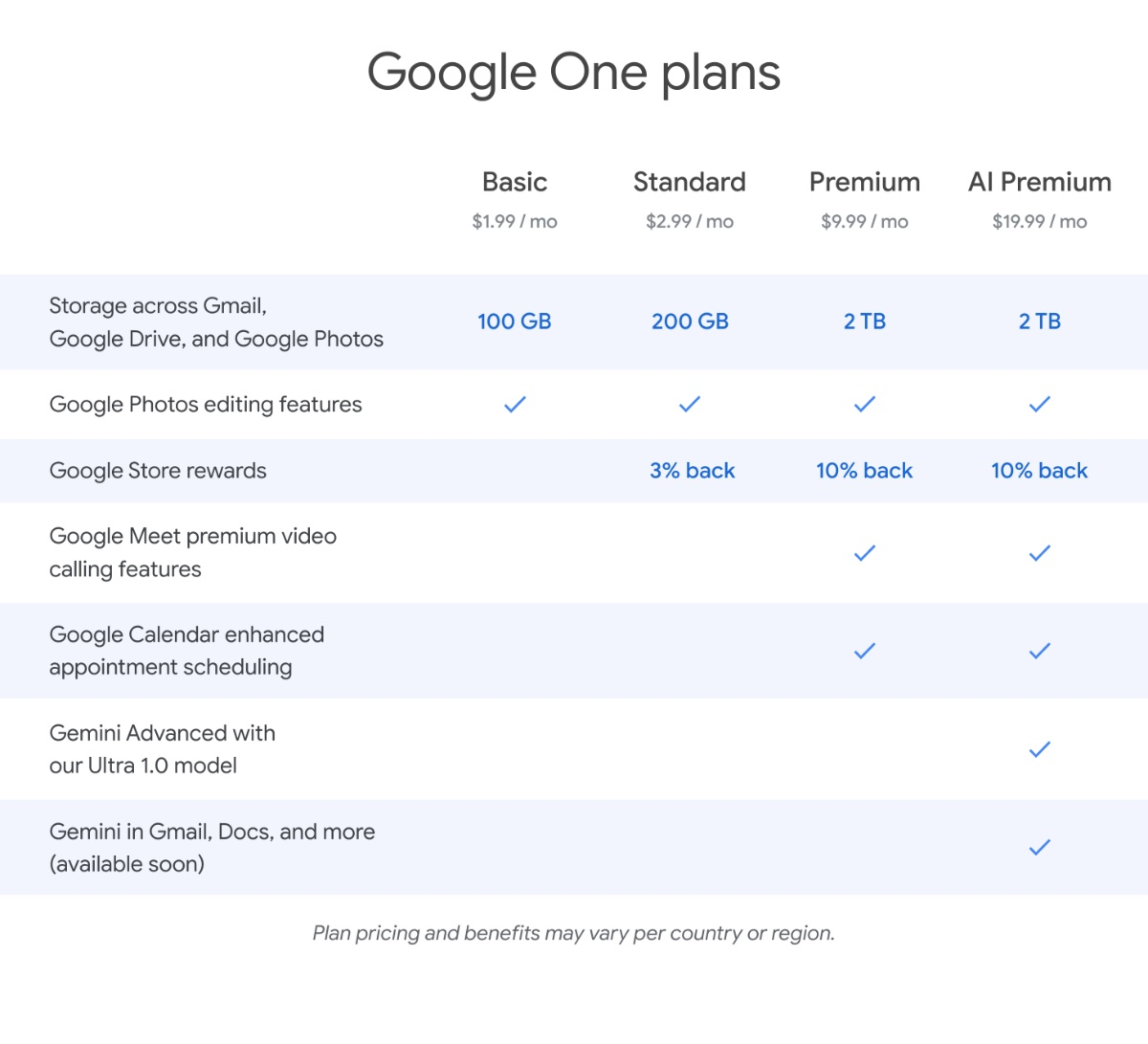

4. Stosunek jakości do ceny

Za 20 USD miesięcznie użytkownicy mogą uzyskać dostęp do GPT-4 za pośrednictwem ChatGPT Plus. Alternatywnie, za tę samą cenę mogą uzyskać dostęp do Gemini Advanced z Gemini Ultra 1.0, który obejmuje dodatkowe korzyści, takie jak 2 TB przestrzeni dyskowej w chmurze i integrację z aplikacjami Google, takimi jak Gmail i Dokumenty. Dostęp do Gemini Advanced wymaga jednak subskrypcji planu Google One AI Premium. Pomimo tego wymogu, oferuje większą wartość za swoje pieniądze.

Wprowadzenie planu średniego poziomu z 500 GB przestrzeni dyskowej i dostępem do Gemini Advanced pomiędzy planami Standard i Premium znacznie zwiększyłoby dostępność Gemini, szczególnie dla studentów i użytkowników o umiarkowanych wymaganiach dotyczących przestrzeni dyskowej. Google, jeśli słuchasz, rozważ tę sugestię.

Co dalej z Gemini?

Google DeepMind stale rozwija model Gemini, a niedawno, zaledwie tydzień temu, wprowadzono Gemini Pro 1.5. W tym zaktualizowanym wariancie okno kontekstu zostało rozszerzone do 128 000 tokenów. Dodatkowo, wybrana grupa deweloperów i klientów korporacyjnych może teraz eksperymentować z jeszcze większymi oknami kontekstowymi do 1 miliona tokenów poprzez prywatne podglądy w AI Studio i Vertex AI. Aby spojrzeć na to z innej perspektywy, typowa książka non-fiction zawiera około 300 000 tokenów. Dzięki oknu kontekstowemu Gemini Pro 1.5 z 1 milionem tokenów użytkownicy mogą teraz przesyłać całe książki w żądaniach zapytań – to znaczący postęp w porównaniu z oknem kontekstowym GPT-4 z 128 000 tokenów.

Wśród nasycenia LLM w branży sztucznej inteligencji, Google wydaje się tym razem trafić w dziesiątkę dzięki ulepszonej architekturze, szybkim reakcjom i płynnej integracji z ekosystemem Google. Może to być rzeczywiście krok we właściwym kierunku, utrzymujący OpenAI i innych konkurentów na palcach.

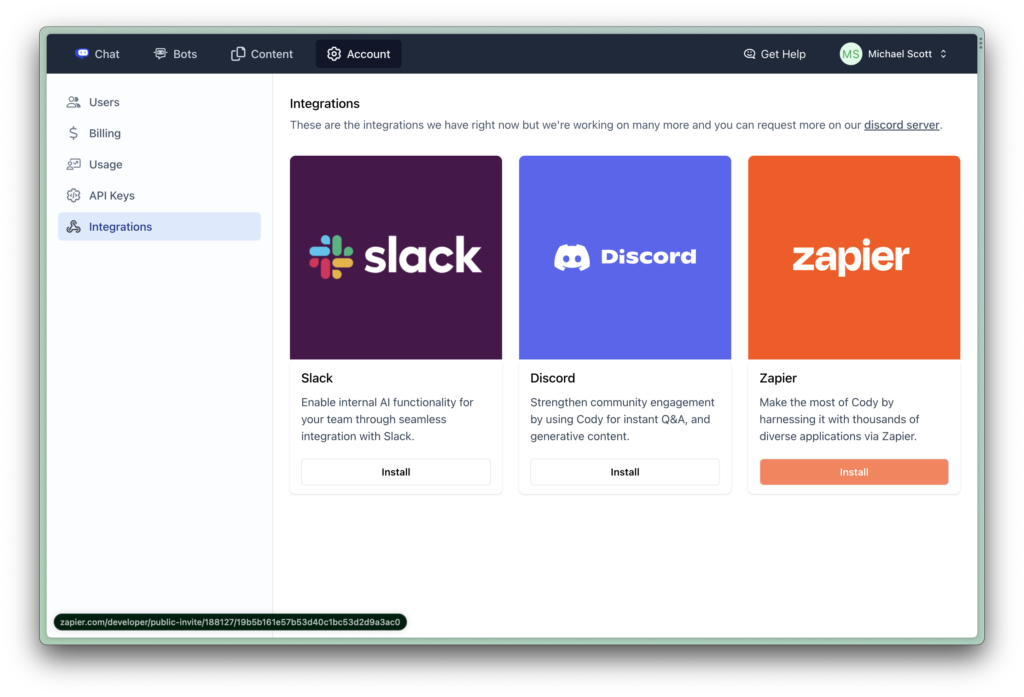

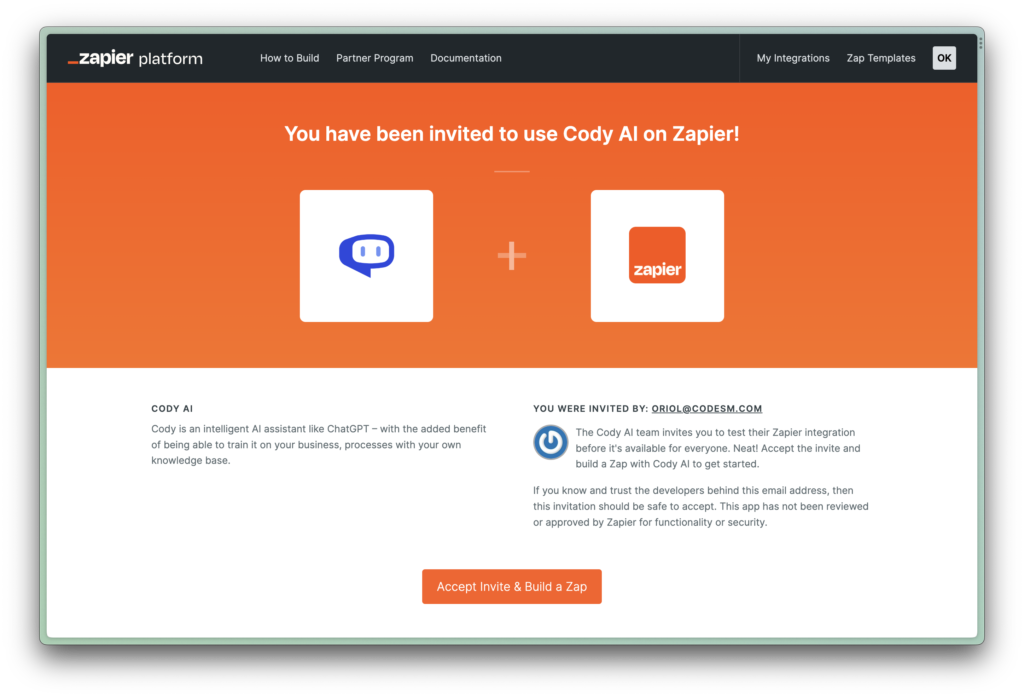

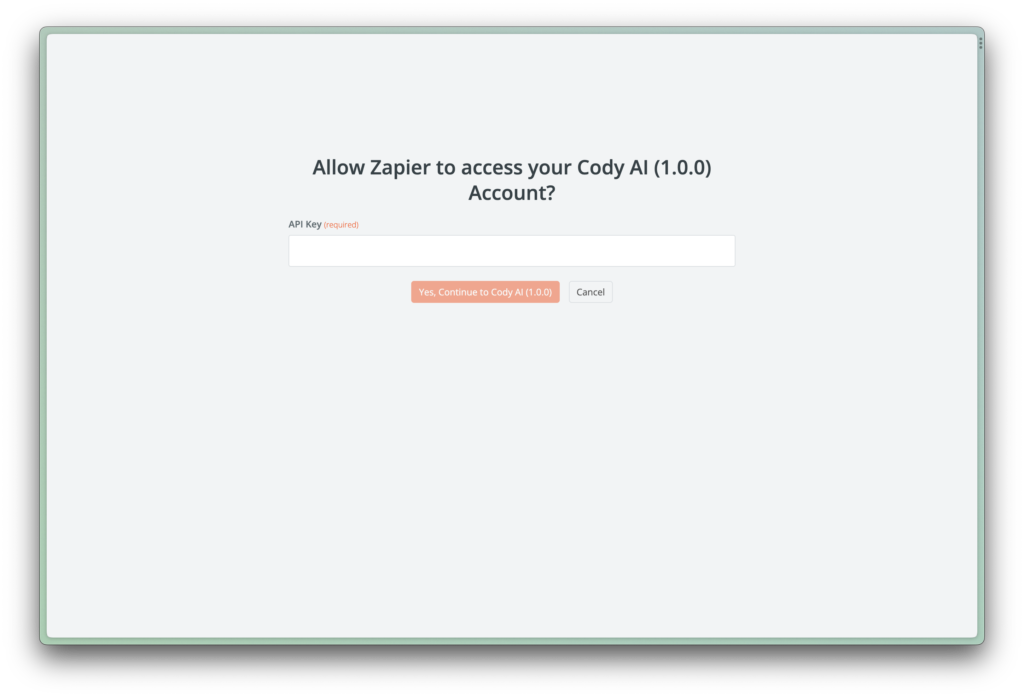

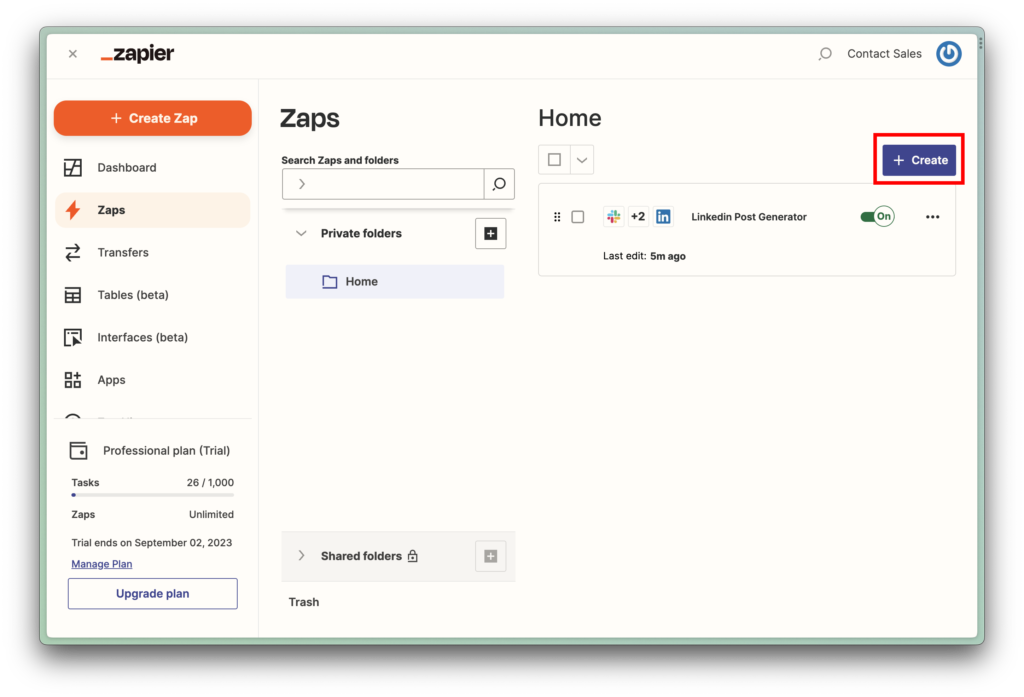

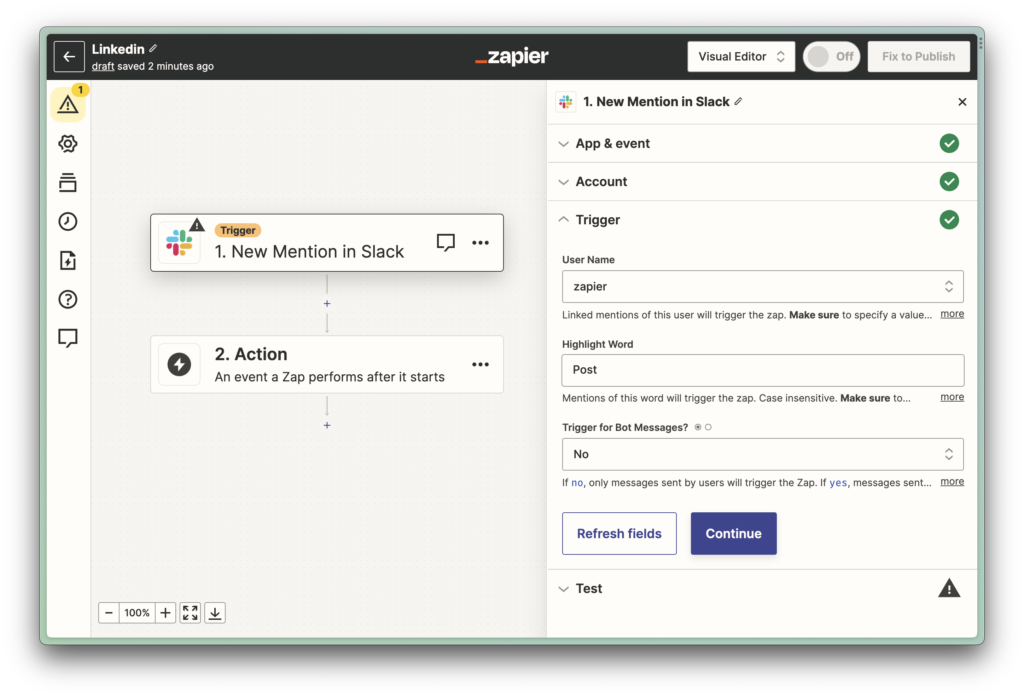

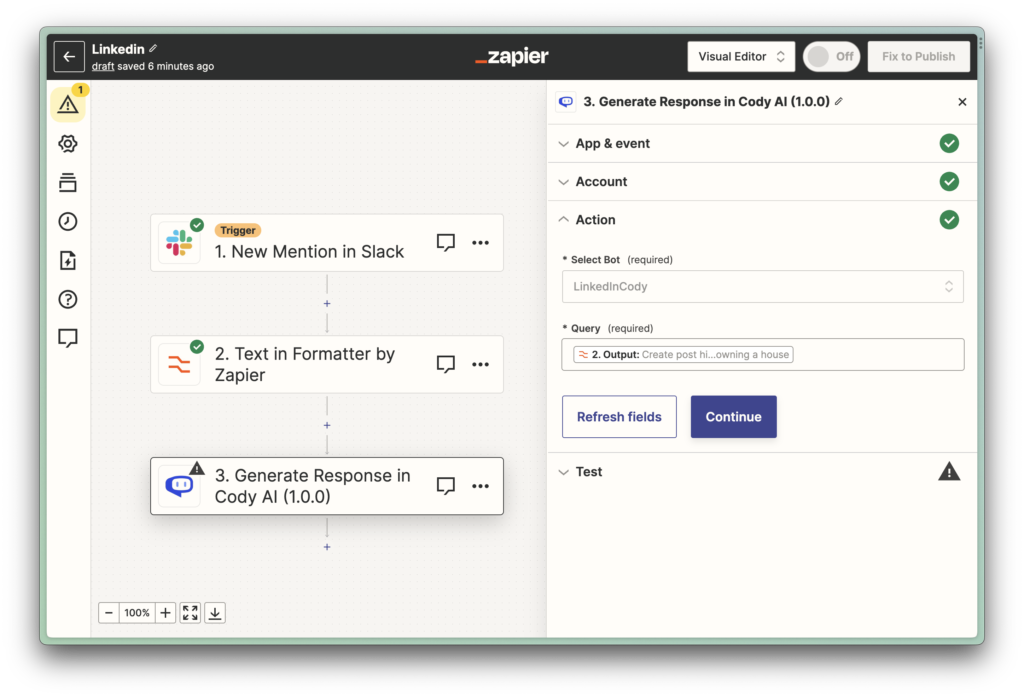

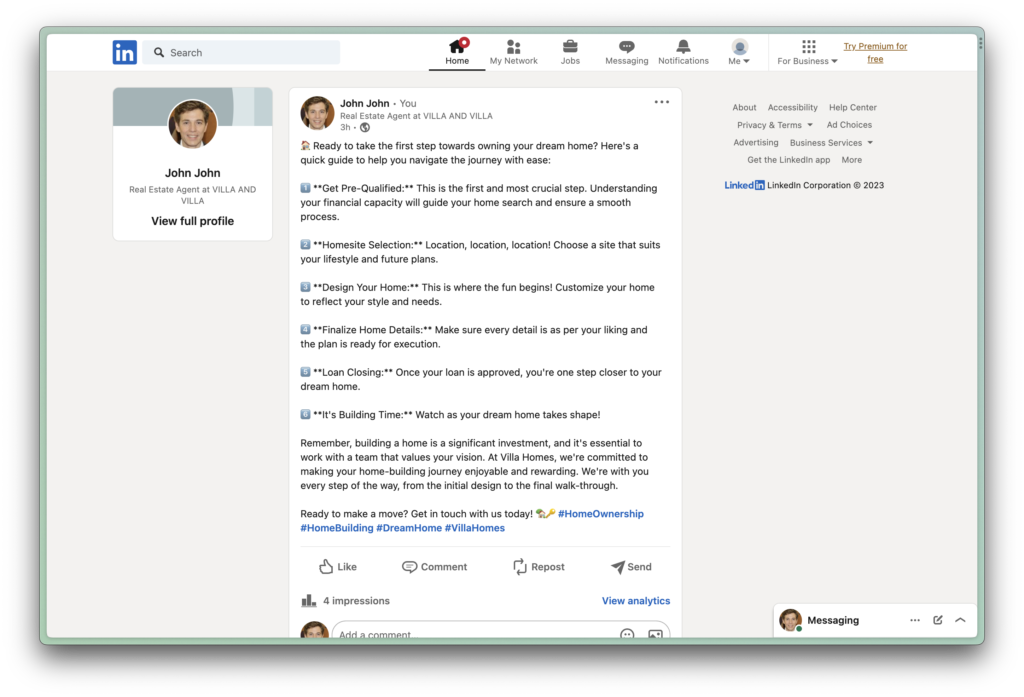

W erze sztucznej inteligencji kluczowe znaczenie dla firm ma posiadanie dobrze wyszkolonych pracowników, a włączenie sztucznej inteligencji do szkolenia pracowników może być znaczącą inwestycją. Jeśli szukasz rozwiązań AI do szkolenia swoich pracowników, Cody jest odpowiednim narzędziem dla Ciebie. Podobnie jak ChatGPT i Gemini, Cody może zostać przeszkolony w zakresie danych biznesowych, zespołu, procesów i klientów, korzystając z unikalnej bazy wiedzy. Cody jest niezależny od modelu, co ułatwia przełączanie modeli zgodnie z wymaganiami.

Dzięki Cody firmy mogą wykorzystać moc sztucznej inteligencji do stworzenia spersonalizowanego i inteligentnego asystenta, który zaspokaja ich potrzeby, co czyni go obiecującym dodatkiem do świata rozwiązań biznesowych opartych na sztucznej inteligencji.