Gemini Embedding 2: funkcje, testy porównawcze, ceny i sposób rozpoczęcia pracy

W zeszłym tygodniu Google opublikowało Gemini Embedding 2, pierwszy natywnie multimodalny model osadzania zbudowany na architekturze Gemini. Jeśli pracujesz z osadzeniami w jakimkolwiek charakterze, zasługuje to na twoją uwagę. Ma potencjał, aby znacząco zakłócić potoki osadzania wielu modeli, na których polega obecnie większość zespołów.

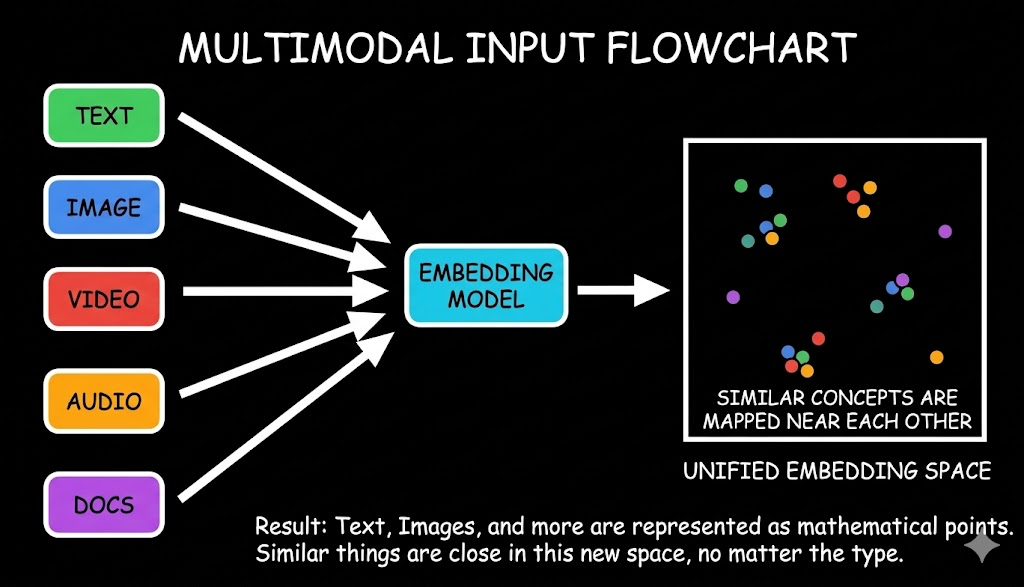

Do tej pory flagowe modele osadzania OpenAI, Cohere i Voyage były oparte głównie na tekście. Istniało kilka opcji multimodalnych – CLIP dla wyrównania obrazu i tekstu, Voyage Multimodal 3.5 dla obrazów i wideo – ale żadna nie obejmowała pełnego spektrum modalności w jednej, ujednoliconej przestrzeni wektorowej. Dźwięk zazwyczaj musiał być transkrybowany przed osadzeniem. Wideo wymagało ekstrakcji klatek w połączeniu z oddzielnym osadzaniem transkrypcji. Obrazy żyły całkowicie we własnej przestrzeni wektorowej.

Gemini Embedding 2 zmienia to równanie. Jeden model, jedno wywołanie API, jedna przestrzeń wektorowa.

Przyjrzyjmy się nowościom.

Czym jest Gemini Embedding 2?

Gemini Embedding 2 (gemini-embedding-2-preview) to pierwszy w pełni multimodalny model osadzania Google DeepMind. Bierze tekst, obrazy, klipy wideo, nagrania audio i dokumenty PDF i konwertuje je wszystkie na wektory, które żyją w tej samej wspólnej przestrzeni semantycznej.

W przeciwieństwie do wcześniejszych podejść multimodalnych, takich jak CLIP, które łączą koder wizyjny z koderem tekstowym i dostosowują je do kontrastowego uczenia się na końcu, Gemini Embedding 2 jest zbudowany na samym modelu Gemini. Oznacza to, że od podstaw dziedziczy głębokie zrozumienie intermodalne.

Obraz wygenerowany przy użyciu Nano Banana

Praktyczny przykład: Wyobraź sobie, że tworzysz system zarządzania nauczaniem (LMS) z samouczkami wideo, wykładami audio i pisemnymi przewodnikami. Dzięki Gemini Embedding 2 możesz przechowywać osadzenia dla całej tej zawartości w jednej przestrzeni wektorowej i zbudować chatbota opartego na RAG, który pobiera odpowiednie fragmenty zarówno z filmów, audio, jak i dokumentów. Wcześniej wymagało to wielowarstwowego potoku osadzania – a nawet wtedy przechwytywało tylko transkrypcje, pomijając wizualny kontekst wideo lub ton głosu mówcy.

Model wykorzystuje Matryoshka Representation Learning, co oznacza, że nie musisz używać wszystkich 3072 wymiarów, jeśli ich nie potrzebujesz. Można zmniejszyć rozmiar do 1536 lub 768 i nadal uzyskiwać użyteczne wyniki.

Matryoshka Representation Learning (MRL) to technika uczenia modeli osadzania tak, aby wyuczone reprezentacje były użyteczne nie tylko w ich pełnej wymiarowości, ale także w różnych mniejszych wymiarach – zagnieżdżonych jedna w drugiej jak rosyjskie lalki matrioszki. Podczas treningu funkcja straty jest obliczana nie tylko na pełnym osadzeniu, ale także na wielu prefiksach wektora osadzenia. Zachęca to model do upakowania najważniejszych informacji w najwcześniejszych wymiarach, przy czym każdy kolejny wymiar dodaje drobniejsze szczegóły – strukturę od grubej do drobnej.

Obsługiwane tryby i limity wejściowe

Model akceptuje pięć typów danych wejściowych, z których wszystkie są mapowane do tej samej przestrzeni osadzania:

| Modalność | Limit wejściowy | Formaty |

|---|---|---|

| Tekst | Do 8 192 tokenów | Zwykły tekst |

| Obrazy | Do 6 obrazów na żądanie | PNG, JPEG |

| Wideo | Do 120 sekund | MP4, MOV |

| Dźwięk | Do 80 sekund (natywny, bez transkrypcji) | MP3, WAV |

| Pliki PDF | Bezpośrednio osadzone | Dokumenty PDF |

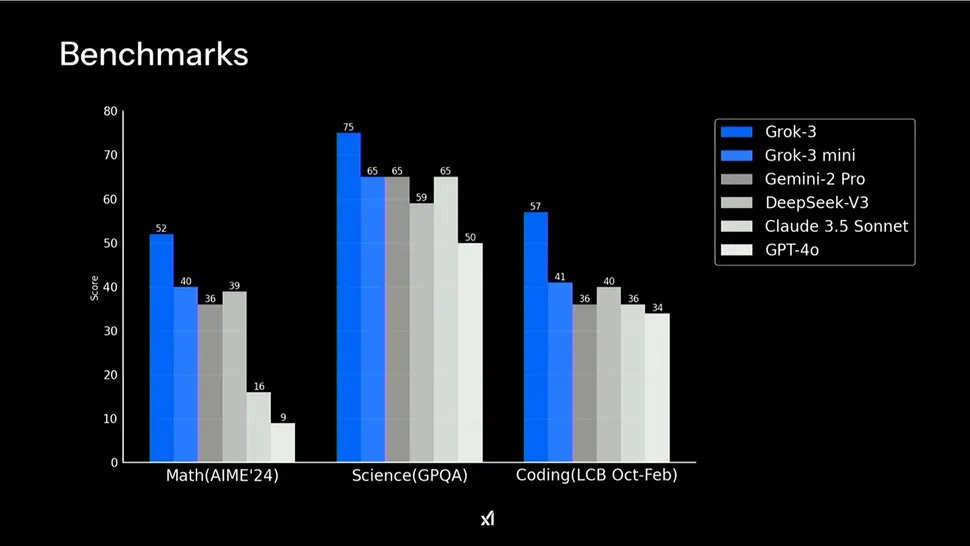

Jak wypada w porównaniu z istniejącymi modelami

TLDR: Nowy model Google Gemini Embedding 2 przewyższa swoich konkurentów (swojego poprzednika, Amazon Nova 2 i Voyage Multimodal 3.5) w niemal każdej modalności: tekście, obrazie, wideo i mowie. Najbardziej przekonująco prowadzi w wyszukiwaniu wideo i dopasowywaniu obrazów do tekstu. Jedynym testem porównawczym, w którym nie wygrywa, jest wyszukiwanie dokumentów, w którym Voyage nieznacznie wyprzedza. Wyszukiwanie tekstu za pomocą mowy to kategoria, w której Gemini jest jedynym właścicielem, ponieważ żaden konkurent nawet jej nie obsługuje.

Google opublikowało porównania z własnymi starszymi modelami, Amazon Nova 2 Multimodal Embeddings i Voyage Multimodal 3.5. Oto pełny obraz sytuacji:

Tekst-Tekst

| Metryczny | Gemini Embedding 2 | gemini-embedding-001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| MTEB Wielojęzyczny (średnie zadanie) | 69.9 | 68.4 | 63.8** | 58.5*** |

| Kod MTEB (średnie zadanie) | 84.0 | 76.0 | * | * |

Gemini Embedding 2 prowadzi w wielojęzycznym tekście z wygodnym marginesem i przeskakuje o 8 punktów nad swoim poprzednikiem w wyszukiwaniu kodu. Ani Amazon Nova 2, ani Voyage nie zgłaszają wyników kodu.

Obraz tekstowy

| Metryczny | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (recall@1) | 89.6 | 74.0 | 76.0 | 79.4 |

| Docci (recall@1) | 93.4 | – | 84.0 | 83.8 |

Wyraźna przewaga w wyszukiwaniu tekstu na obraz – ponad 9 punktów przewagi nad najbliższym konkurentem w obu testach porównawczych.

Obraz-Tekst

| Metryczny | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (recall@1) | 97.4 | 88.1 | 88.9 | 88.6 |

| Docci (recall@1) | 91.3 | – | 76.5 | 77.4 |

Wyszukiwanie obraz-tekst wykazuje największą lukę – prawie 15 punktów przewagi nad Amazon Nova 2 na Docci.

Dokument tekstowy

| Metryczny | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| ViDoRe v2 (ndcg@10) | 64.9 | 28.9 | 60.6 | 65.5** |

Jedyny test porównawczy, w którym Voyage Multimodal 3.5 wyprzedza (zgłoszony przez użytkownika). Wyszukiwanie dokumentów jest zbliżone między najlepszymi modelami.

Tekst-Wideo

| Metryczny | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| Vatex (ndcg@10) | 68.8 | 54.9 | 60.3 | 55.2 |

| MSR-VTT (ndcg@10) | 68.0 | 57.9 | 67.0 | 63.0** |

| Youcook2 (ndcg@10) | 52.5 | 34.9 | 34.7 | 31.4** |

Pobieranie wideo to miejsce, w którym Gemini Embedding 2 osiąga największą przewagę – ponad 17 punktów nad Voyage na Youcook2 i ponad 13 punktów na Vatex.

Mowa-tekst

| Metryczny | Gemini Embedding 2 |

|---|---|

| MSEB (mrr@10) | 73.9 |

| MSEB ASR**** (mrr@10) | 70.4 |

Pobieranie tekstu mowy jest całkowicie bezsporne – ani Amazon, ani Voyage go nie obsługują. Jest to kategoria, której Gemini Embedding 2 jest bezpośrednim właścicielem.

– wynik nie jest dostępny ** zgłoszony samodzielnie *** voyage-3.5 **** Model ASR konwertuje zapytania audio na tekst

Wycena

Model jest obecnie darmowy w ramach publicznej wersji zapoznawczej. Po przejściu na płatny poziom, oto podział:

| Poziom darmowy | Poziom płatny (za 1 mln tokenów) | |

|---|---|---|

| Wprowadzanie tekstu | Bezpłatnie | $0.20 |

| Wprowadzanie obrazu | Bezpłatnie | 0,45 USD (0,00012 USD za obraz) |

| Wejście audio | Bezpłatnie | 6,50 USD (0,00016 USD za sekundę) |

| Wejście wideo | Bezpłatnie | 12,00 USD (0,00079 USD za klatkę) |

| Używane do ulepszania produktów Google | Tak | Nie |

Pierwsze kroki

Model jest już dostępny w publicznej wersji zapoznawczej za pośrednictwem Gemini API i Vertex AI pod identyfikatorem modelu gemini-embedding-2-preview. Integruje się z LangChain, LlamaIndex, Haystack, Weaviate, Qdrant, ChromaDB i Vector Search.

from google import genai

from google.genai import types

# For Vertex AI:

# PROJECT_ID='<add_here>'

# client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1')

client = genai.Client()

with open("example.png", "rb") as f:

image_bytes = f.read()

with open("sample.mp3", "rb") as f:

audio_bytes = f.read()

# Embed text, image, and audio

result = client.models.embed_content(

model="gemini-embedding-2-preview",

contents=[

"What is the meaning of life?",

types.Part.from_bytes(

data=image_bytes,

mime_type="image/png",

),

types.Part.from_bytes(

data=audio_bytes,

mime_type="audio/mpeg",

),

],

)

print(result.embeddings)

Wypróbuj tutaj!

Stworzyliśmy aplikację demonstracyjną, w której można przetestować multimodalną wydajność wyszukiwania gemini-embedding-2.

Klucz API można uzyskać, logując się na stronie aistudio.google.com.

Ograniczenia, na które należy zwrócić uwagę

- Model jest wciąż w fazie publicznej wersji zapoznawczej (tag “preview” oznacza, że ceny i zachowanie mogą ulec zmianie przed GA).

- Wejście wideo jest ograniczone do 120 sekund, a audio do 80 sekund.

- Wydajność w niszowych domenach, takich jak finansowa kontrola jakości, jest słabsza; przed podjęciem decyzji należy ocenić ją pod kątem konkretnych danych.

- W przypadku potoków czysto tekstowych, bez planów multimodalnych, premia kosztowa w stosunku do modeli tekstowych może nie być uzasadniona.

Podsumowanie

Gemini Embedding 2 to nie tylko stopniowa poprawa, to zmiana kategorii. Dla zespołów budujących multimodalne systemy RAG, wyszukiwanie semantyczne w różnych typach mediów lub ujednolicone bazy wiedzy, rozwiązanie to sprowadza to, co kiedyś było problemem związanym z wieloma modelami i wieloma potokami, do pojedynczego wywołania API. Jeśli Twoje dane obejmują więcej niż tylko tekst, jest to model, który należy ocenić w pierwszej kolejności.

Tworzenie multimodalnego RAG nie powinno oznaczać zszywania od podstaw modeli osadzania, wektorowych baz danych i logiki wyszukiwania. Jeśli potrzebujesz zarządzanego rozwiązania RAG-as-a-Service, które obsługuje potok osadzania, zarejestruj się w bezpłatnej wersji próbnej w Cody i zacznij tworzyć już dziś.