Gemini 임베딩 2: 기능, 벤치마크, 가격 및 시작 방법

지난주 구글은 쌍둥이자리 Gemini 아키텍처를 기반으로 구축된 최초의 네이티브 멀티모달 임베딩 모델인 임베딩 2. 어떤 방식으로든 임베딩 작업을 하고 있다면 주목할 가치가 있습니다. 오늘날 대부분의 팀이 사용하는 다중 모델 임베딩 파이프라인을 크게 혁신할 수 있는 잠재력을 가지고 있습니다.

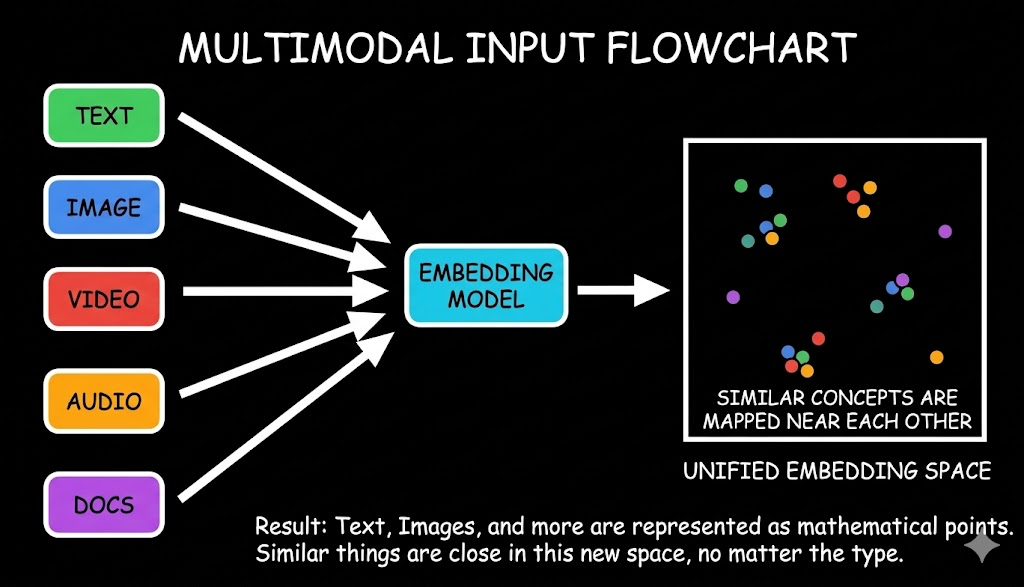

지금까지 OpenAI, Cohere, Voyage의 대표적인 임베딩 모델은 주로 텍스트 기반이었습니다. 이미지-텍스트 정렬을 위한 CLIP, 이미지와 동영상을 위한 Voyage Multimodal 3.5 등 몇 가지 멀티모달 옵션이 존재했지만, 단일 통합 벡터 공간에서 모든 모달리티를 포괄하는 것은 없었습니다. 오디오는 일반적으로 임베딩하기 전에 트랜스크립션해야 했습니다. 비디오는 별도의 트랜스크립트 임베딩과 결합된 프레임 추출이 필요했습니다. 이미지는 완전히 독자적인 벡터 공간에 존재했습니다.

Gemini Embedding 2는 이 공식을 바꿉니다. 하나의 모델, 하나의 API 호출, 하나의 벡터 공간.

새로운 기능에 대해 자세히 알아보세요.

제미니 임베딩 2란 무엇인가요?

Gemini Embedding 2 (gemini-embedding-2-preview)는 Google DeepMind의 첫 번째 완전 멀티모달 임베딩 모델입니다. 텍스트, 이미지, 비디오 클립, 오디오 녹음, PDF 문서를 모두 동일한 공유 의미 공간에 있는 벡터로 변환합니다.

비전 인코더와 텍스트 인코더를 페어링하고 마지막에 대조 학습으로 정렬하는 CLIP과 같은 이전의 멀티모달 접근 방식과 달리 Gemini Embedding 2는 Gemini 기반 모델 자체에 구축되었습니다. 즉, 처음부터 심층적인 크로스 모달 이해를 계승합니다.

나노 바나나를 사용하여 생성된 이미지

실제 예시: 비디오 튜토리얼, 오디오 강의, 서면 가이드가 포함된 학습 관리 시스템(LMS)을 구축한다고 상상해 보세요. Gemini 임베딩 2를 사용하면 이러한 모든 콘텐츠의 임베딩을 단일 벡터 공간에 저장하고 비디오, 오디오 및 문서에서 관련 청크를 모두 검색하는 RAG 기반 챗봇을 구축할 수 있습니다. 이전에는 다층 임베딩 파이프라인이 필요했고, 그마저도 대본만 캡처하여 동영상의 시각적 맥락이나 화자의 목소리 톤을 놓쳤습니다.

이 모델은 마트료시카 표현 학습을 사용하므로 필요하지 않은 경우 3072개의 차원을 모두 사용할 필요는 없습니다. 1536 또는 768로 축소해도 여전히 사용 가능한 결과를 얻을 수 있습니다.

지원되는 모달리티 및 입력 제한

이 모델은 동일한 임베딩 공간에 매핑된 다섯 가지 유형의 입력을 허용합니다:

| 양식 | 입력 제한 | 형식 |

|---|---|---|

| 텍스트 | 최대 8,192 토큰 | 일반 텍스트 |

| 이미지 | 요청당 최대 6개의 이미지 | PNG, JPEG |

| 동영상 | 최대 120초 | MP4, MOV |

| 오디오 | 최대 80초(네이티브, 트랜스크립션 없음) | MP3, WAV |

| 직접 임베드 | PDF 문서 |

기존 모델과 비교하는 방법

Google은 자체 레거시 모델인 Amazon Nova 2 멀티모달 임베딩 및 Voyage 멀티모달 3.5와의 벤치마크 비교 결과를 발표했습니다. 전체 내용은 다음과 같습니다:

텍스트-텍스트

| Metric | 제미니 임베딩 2 | 제미니 임베딩-001 | Amazon Nova 2 | Voyage 멀티모달 3.5 |

|---|---|---|---|---|

| MTEB 다국어(평균 작업) | 69.9 | 68.4 | 63.8** | 58.5*** |

| MTEB 코드(평균 작업) | 84.0 | 76.0 | * | * |

다국어 텍스트에서는 Gemini Embedding 2가 여유 있는 차이로 앞섰고 코드 검색에서는 이전 버전보다 8점이나 뛰어올랐습니다. Amazon Nova 2와 Voyage 모두 코드 점수를 보고하지 않습니다.

텍스트-이미지

| Metric | 제미니 임베딩 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage 멀티모달 3.5 |

|---|---|---|---|---|

| 텍스트 캡(recall@1) | 89.6 | 74.0 | 76.0 | 79.4 |

| Docci(리콜@1) | 93.4 | – | 84.0 | 83.8 |

두 벤치마크 모두에서 가장 가까운 경쟁사보다 9점 이상 앞서며 텍스트-이미지 검색에서 확실한 우위를 점하고 있습니다.

이미지-텍스트

| Metric | 제미니 임베딩 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage 멀티모달 3.5 |

|---|---|---|---|---|

| 텍스트 캡(recall@1) | 97.4 | 88.1 | 88.9 | 88.6 |

| Docci(리콜@1) | 91.3 | – | 76.5 | 77.4 |

이미지-텍스트 검색에서 가장 큰 격차를 보인 것은 Docci의 Amazon Nova 2로, 거의 15점이나 앞섰습니다.

텍스트-문서

| Metric | 제미니 임베딩 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage 멀티모달 3.5 |

|---|---|---|---|---|

| ViDoRe v2 (ndcg@10) | 64.9 | 28.9 | 60.6 | 65.5** |

Voyage Multimodal 3.5가 앞서 있는 유일한 벤치마크입니다(자체 보고). 문서 검색은 상위 모델 간에 비슷합니다.

텍스트-비디오

| Metric | 제미니 임베딩 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage 멀티모달 3.5 |

|---|---|---|---|---|

| 바텍스 (ndcg@10) | 68.8 | 54.9 | 60.3 | 55.2 |

| MSR-VTT (ndcg@10) | 68.0 | 57.9 | 67.0 | 63.0** |

| Youcook2 (ndcg@10) | 52.5 | 34.9 | 34.7 | 31.4** |

동영상 검색은 Gemini Embedding 2가 Youcook2의 Voyage보다 17점 이상, Vatex보다 13점 이상 앞서고 있는 분야입니다.

음성-텍스트

| Metric | 제미니 임베딩 2 |

|---|---|

| MSEB(mrr@10) | 73.9 |

| MSEB ASR**** (mrr@10) | 70.4 |

음성 텍스트 검색은 완전히 경쟁이 없는 분야로, Amazon이나 Voyage 모두 이를 지원하지 않습니다. 이것은 Gemini Embedding 2가 완전히 독점하고 있는 카테고리입니다.

– 점수를 사용할 수 없음 ** 자체 보고 *** voyage-3.5 **** ASR 모델이 오디오 쿼리를 텍스트로 변환합니다.

가격

이 모델은 현재 공개 미리 보기 기간 동안 무료로 제공됩니다. 유료 티어로 전환되면 다음과 같은 세부 정보가 제공됩니다:

| 무료 티어 | 유료 티어(1백만 토큰당) | |

|---|---|---|

| 텍스트 입력 | 무료 | $0.20 |

| 이미지 입력 | 무료 | 0.45달러(이미지당 $0.00012) |

| 오디오 입력 | 무료 | 6.50 (초당 $0.00016) |

| 비디오 입력 | 무료 | 12.00(프레임당 $0.00079) |

| Google 제품 개선에 사용 | 예 | 아니요 |

시작하기

이 모델은 현재 Gemini API 및 Vertex AI를 통해 모델 ID로 공개 미리 보기에서 사용할 수 있습니다. gemini-embedding-2-preview. LangChain, LlamaIndex, Haystack, Weaviate, Qdrant, ChromaDB 및 Vector Search와 통합됩니다.

from google import genai

from google.genai import types

# For Vertex AI:

# PROJECT_ID='<add_here>'

# client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1')

client = genai.Client()

with open("example.png", "rb") as f:

image_bytes = f.read()

with open("sample.mp3", "rb") as f:

audio_bytes = f.read()

# Embed text, image, and audio

result = client.models.embed_content(

model="gemini-embedding-2-preview",

contents=[

"What is the meaning of life?",

types.Part.from_bytes(

data=image_bytes,

mime_type="image/png",

),

types.Part.from_bytes(

data=audio_bytes,

mime_type="audio/mpeg",

),

],

)

print(result.embeddings)

여기에서 사용해보세요!

gemini-embedding-2의 멀티모달 검색 성능을 테스트할 수 있는 데모 앱을 구축했습니다.

aistudio.google.com에 로그인하여 API 키를 받을 수 있습니다.

주의해야 할 제한 사항

- 이 모델은 아직 공개 미리 보기 상태입니다(‘미리 보기’ 태그는 가격 및 동작이 GA 전에 변경될 수 있음을 의미합니다).

- 비디오 입력은 120초, 오디오는 80초로 제한됩니다.

- 금융 QA와 같은 틈새 도메인의 성능은 더 약하므로 커밋하기 전에 특정 데이터와 비교하여 평가하세요.

- 복합 요금제가 없는 순수 텍스트 파이프라인의 경우, 텍스트 전용 모델에 비해 비용 프리미엄이 정당화되지 않을 수 있습니다.

결론

Gemini Embedding 2는 단순한 점진적 개선이 아니라 카테고리의 전환입니다. 멀티모달 RAG 시스템, 미디어 유형 간 시맨틱 검색 또는 통합 지식 베이스를 구축하는 팀의 경우, 다중 모델, 다중 파이프라인 문제였던 것을 단일 API 호출로 축소합니다. 데이터가 텍스트 그 이상에 걸쳐 있는 경우, 이 모델을 가장 먼저 평가해야 합니다.

멀티모달 RAG를 구축한다고 해서 임베딩 모델, 벡터 데이터베이스, 검색 로직을 처음부터 새로 만들어야 하는 것은 아닙니다. 임베딩 파이프라인을 처리하는 관리형 RAG-as-a-Service 솔루션이 필요하다면 Cody의 무료 평가판에 등록하고 지금 바로 구축을 시작하세요.