Gemini Embedding 2:機能、ベンチマーク、価格、開始方法

先週、グーグルは ジェミニ エンベッディング2は、Geminiアーキテクチャ上に構築された初のネイティブなマルチモーダルエンベッディングモデルである。エンベッディングを何らかの形で扱うのであれば、これは注目に値する。これは、今日ほとんどのチームが依存しているマルチモデルのエンベッディングパイプラインを大きく破壊する可能性を秘めています。

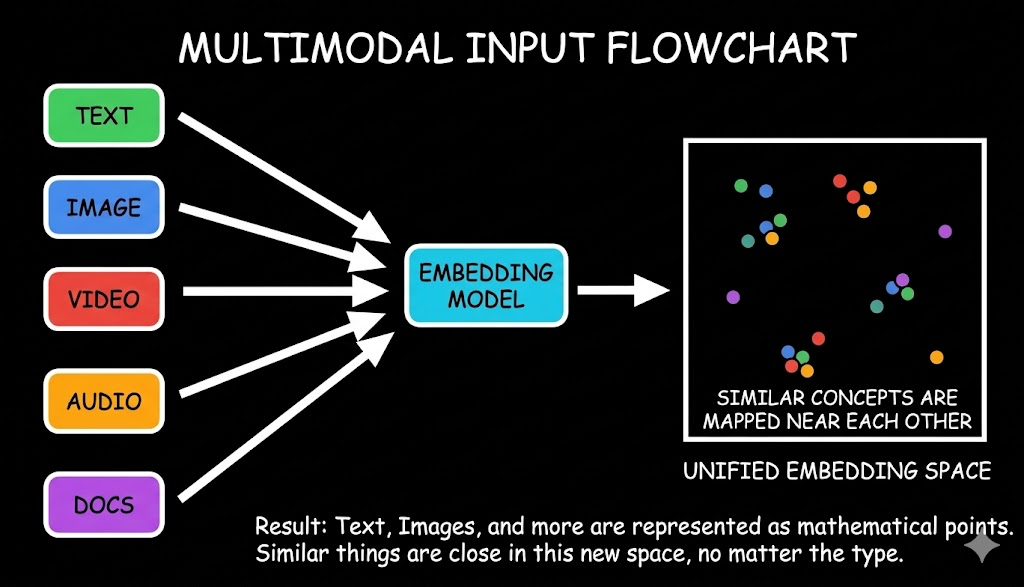

これまで、OpenAI、Cohere、Voyageの主要な埋め込みモデルは、主にテキストベースでした。画像とテキストのアライメントにはCLIP、画像とビデオにはVoyage Multimodal 3.5など、いくつかのマルチモーダル・オプションは存在しましたが、単一の統一されたベクトル空間で、あらゆるモダリティをカバーするものはありませんでした。音声は通常、埋め込む前に書き起こす必要があった。ビデオでは、フレーム抽出と個別のトランスクリプト埋め込みが必要でした。画像は、完全に独自のベクトル空間に存在していました。

Gemini Embedding 2はその方程式を変える。1つのモデル、1つのAPIコール、1つのベクトル空間。

新情報を掘り下げてみよう。

Gemini Embedding 2とは何ですか?

Gemini Embedding 2(gemini-embedding-2-preview) は、Google DeepMind初の完全なマルチモーダル埋め込みモデルである。テキスト、画像、ビデオクリップ、音声記録、PDF文書を取り込み、それらすべてを同じ共有意味空間に存在するベクトルに変換する。

CLIPのような以前のマルチモーダルアプローチは、ビジョンエンコーダとテキストエンコーダをペアにして、最後に対比学習でそれらを調整するものであったが、Gemini Embedding 2は、Geminiの基礎モデルそのものに基づいて構築されている。これは、深いクロスモーダル理解を基礎から受け継いでいることを意味する。

ナノバナナを使用した画像

実例ビデオチュートリアル、オーディオレクチャー、文書によるガイドで学習管理システム(LMS)を構築しているとします。Gemini Embedding 2を使用すると、これらすべてのコンテンツのエンベッディングを単一のベクトル空間に格納し、ビデオ、オーディオ、ドキュメントから関連するチャンクを取得するRAGベースのチャットボットを構築することができます。これまでは、何層ものエンベッディングパイプラインが必要でしたが、それでも、トランスクリプトをキャプチャするだけで、ビデオのビジュアルコンテキストやスピーカーの声のトーンを逃していました。

このモデルはマトリョーシカ表現学習を使用しているため、必要なければ3072次元すべてを使用する必要はない。1536や768に縮小しても、使用可能な結果を得ることができる。

マトリョーシカ表現学習(MRL)は、学習された表現が完全な次元だけでなく、ロシアのマトリョーシカ人形のように互いに入れ子になっている様々な小さな次元でも有用であるように、埋め込みモデルを学習する手法です。学習中、損失関数は完全な埋め込みだけでなく、埋め込みベクトルの複数の接頭辞に対しても計算されます。これによりモデルは、最も重要な情報を最も初期の次元に詰め込み、それに続く各次元がより細かいディテールを追加していく、つまり粗いものから細かいものへの構造を持つようになる。

対応モダリティと入力制限

このモデルは5種類の入力を受け入れ、すべて同じ埋め込み空間にマッピングされる:

| モダリティ | 入力制限 | フォーマット |

|---|---|---|

| テキスト | 最大8,192トークン | プレーンテキスト |

| 画像 | 1リクエストにつき6枚まで | PNG, JPEG |

| ビデオ | 最大120秒 | MP4、MOV |

| 音声 | 最大80秒(ネイティブ、トランスクリプションなし) | MP3, WAV |

| 直接埋め込む | PDFドキュメント |

既存モデルとの比較

TLDR:Googleの新しいGemini Embedding 2モデルは、テキスト、画像、ビデオ、音声のほぼ全てのモダリティにおいて、競合他社(自身の前身、Amazon Nova 2、Voyage Multimodal 3.5)を圧倒している。ビデオ検索と画像とテキストのマッチングでは、最も説得力を持ってリードしている。唯一勝てなかったベンチマークは文書検索で、Voyageがわずかにリードしている。音声テキスト検索は、競合他社がサポートしていないため、ジェミニの独壇場である。

Googleは、自社のレガシーモデル、Amazon Nova 2 Multimodal Embeddings、Voyage Multimodal 3.5とのベンチマーク比較を発表した。これがその全貌だ:

テキスト-テキスト

| メトリック | ジェミニエンベッディング2 | ジェミニ・エンベディング001 | アマゾン・ノヴァ 2 | ボヤージュ・マルチモーダル3.5 |

|---|---|---|---|---|

| MTEB多言語(平均タスク) | 69.9 | 68.4 | 63.8** | 58.5*** |

| MTEBコード(平均課題) | 84.0 | 76.0 | * | * |

Gemini Embedding 2は、多言語テキストでは余裕でリードし、コード検索では前作を8ポイント上回った。Amazon Nova 2もVoyageもコードスコアを報告していない。

テキスト画像

| メトリック | ジェミニエンベッディング2 | マルチモーダルエンベディング@001 | アマゾン・ノヴァ2 | ボヤージュ・マルチモーダル3.5 |

|---|---|---|---|---|

| テキストキャップス(リコール@1) | 89.6 | 74.0 | 76.0 | 79.4 |

| ドッチ(リコール@1) | 93.4 | – | 84.0 | 83.8 |

テキストから画像への検索では、両ベンチマークで最も近い競合他社に9ポイント以上の差をつけている。

画像-テキスト

| メトリック | ジェミニエンベッディング2 | マルチモーダルエンベディング@001 | アマゾン・ノヴァ2 | ボヤージュ・マルチモーダル3.5 |

|---|---|---|---|---|

| テキストキャップス(リコール@1) | 97.4 | 88.1 | 88.9 | 88.6 |

| ドッチ(リコール@1) | 91.3 | – | 76.5 | 77.4 |

画像からテキストへの検索では、DocciのAmazon Nova 2に15ポイント近い差をつけている。

テキスト・ドキュメント

| メトリック | ジェミニエンベッディング2 | マルチモーダルエンベディング@001 | アマゾン・ノヴァ2 | ボヤージュ・マルチモーダル3.5 |

|---|---|---|---|---|

| ViDoRe v2 (ndcg@10) | 64.9 | 28.9 | 60.6 | 65.5** |

Voyage Multimodal 3.5が優位に立つベンチマークは1つ(自己申告)。文書検索は上位モデル間で拮抗している。

テキスト-ビデオ

| メトリック | ジェミニエンベッディング2 | マルチモーダルエンベディング@001 | アマゾン・ノヴァ2 | ボヤージュ・マルチモーダル3.5 |

|---|---|---|---|---|

| バテックス(ndcg@10) | 68.8 | 54.9 | 60.3 | 55.2 |

| MSR-VTT (ndcg@10) | 68.0 | 57.9 | 67.0 | 63.0** |

| ユーコック2 (ndcg@10) | 52.5 | 34.9 | 34.7 | 31.4** |

ビデオ検索では、Gemini Embedding 2が最も優位に立っており、Youcook2ではVoyageを17ポイント以上、Vatexでは13ポイント以上上回っている。

スピーチ・テキスト

| メトリック | ジェミニ・エンベッディング2 |

|---|---|

| MSEB (mrr@10) | 73.9 |

| MSEB ASR**** (mrr@10) | 70.4 |

音声テキスト検索は、AmazonもVoyageもサポートしていない。これはGemini Embedding 2が完全に所有しているカテゴリーである。

– スコアは不明 ** 自己申告 **** voyage-3.5 **** ASRモデルが音声クエリをテキストに変換

価格設定

このモデルは現在、パブリックプレビュー中は無料です。有料版になると、その内訳は以下のようになる:

| 無料ティア | 有料ティア(1Mトークンあたり) | |

|---|---|---|

| テキスト入力 | 無料 | $0.20 |

| 画像入力 | 無料 | 0.45ドル(画像1枚につき0.00012ドル) |

| 音声入力 | 無料 | 6.50ドル(1秒あたり0.00016ドル) |

| ビデオ入力 | 無料 | 12ドル(1フレームあたり0.00079ドル) |

| Google 製品の改善に使用 | 利用目的 | いいえ |

はじめに

このモデルは現在、Gemini APIおよびVertex AIを通じて、モデルID gemini-embedding-2-preview. LangChain、LlamaIndex、Haystack、Weaviate、Qdrant、ChromaDB、Vector Searchと統合されています。

from google import genai

from google.genai import types

# For Vertex AI:

# PROJECT_ID='<add_here>'

# client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1')

client = genai.Client()

with open("example.png", "rb") as f:

image_bytes = f.read()

with open("sample.mp3", "rb") as f:

audio_bytes = f.read()

# Embed text, image, and audio

result = client.models.embed_content(

model="gemini-embedding-2-preview",

contents=[

"What is the meaning of life?",

types.Part.from_bytes(

data=image_bytes,

mime_type="image/png",

),

types.Part.from_bytes(

data=audio_bytes,

mime_type="audio/mpeg",

),

],

)

print(result.embeddings)

ここで試してみよう!

gemini-embedding-2のマルチモーダル検索性能をテストできるデモアプリを作りました。

APIキーはaistudio.google.comにログインして取得できます。

注意すべき制限

- このモデルはまだ公開プレビュー中だ(「プレビュー」タグは、GA前に価格や動作が変更される可能性があることを意味する)。

- ビデオ入力の上限は120秒、オーディオは80秒。

- 金融QAのようなニッチな領域でのパフォーマンスは弱い。

- マルチモーダル計画を持たない純粋なテキストパイプラインの場合、テキストのみのモデルに対するコストプレミアムは正当化されないかもしれない。

結論

Gemini Embedding 2は、単なる漸進的な改善ではなく、カテゴリーシフトである。マルチモーダルなRAGシステム、メディアタイプにまたがるセマンティック検索、または統合されたナレッジベースを構築するチームにとって、マルチモデル、マルチパイプラインの問題であったものが、単一のAPI呼び出しに集約される。もしあなたのデータがテキスト以上のものに及ぶのであれば、まずこのモデルを評価すべきだろう。

マルチモーダルRAGの構築は、エンベッディングモデル、ベクターデータベース、検索ロジックをゼロからつなぎ合わせることを意味すべきではありません。エンベッディング・パイプラインを処理するマネージドRAG-as-a-Serviceソリューションをお望みなら、Codyの無料トライアルにサインアップして、今すぐ構築を開始してください。