DeepSeek R1 to innowacyjny model rozumowania o otwartym kodzie źródłowym opracowany przez DeepSeek, chińską firmę zajmującą się sztuczną inteligencją, który robi furorę w świecie sztucznej inteligencji. W przeciwieństwie do tradycyjnych modeli językowych, które koncentrują się głównie na generowaniu i rozumieniu tekstu, DeepSeek R1 specjalizuje się w logicznym wnioskowaniu, rozwiązywaniu problemów matematycznych i podejmowaniu decyzji w czasie rzeczywistym. To unikalne ukierunkowanie wyróżnia go na tle innych modeli sztucznej inteligencji, oferując lepsze możliwości wyjaśniania i wnioskowania. To, co naprawdę wyróżnia DeepSeek R1, to jego otwarty charakter, umożliwiający programistom i badaczom eksplorację, modyfikację i wdrażanie modelu w ramach pewnych ograniczeń technicznych. Ta otwartość sprzyja innowacjom i współpracy w społeczności AI. Co więcej, DeepSeek R1 wyróżnia się przystępną ceną, a koszty operacyjne są znacznie niższe niż u konkurencji. W rzeczywistości szacuje się, że kosztuje tylko 2% tego, co użytkownicy wydaliby na model O1 OpenAI, dzięki czemu zaawansowane rozumowanie AI jest dostępne dla szerszego grona odbiorców.

Zrozumienie modelu DeepSeek R1

DeepSeek R1 został zaprojektowany tak, aby wyróżniać się w obszarach, które odróżniają go od tradycyjnych modeli językowych. Jak zauważają eksperci, “w przeciwieństwie do tradycyjnych modeli językowych, modele rozumowania takie jak DeepSeek-R1 specjalizują się w: Wnioskowaniu logicznym, Matematycznym rozwiązywaniu problemów, Podejmowaniu decyzji w czasie rzeczywistym”. Ta specjalizacja umożliwia DeepSeek R1 rozwiązywanie złożonych problemów z poziomem rozumowania, który naśladuje ludzkie procesy poznawcze. Droga do stworzenia DeepSeek R1 nie była pozbawiona wyzwań. DeepSeek-R1 ewoluował od swojego poprzednika, DeepSeek-R1-Zero, który początkowo opierał się na czystym uczeniu wzmacniającym, co prowadziło do trudności w czytelności i odpowiedzi w różnych językach. Aby przezwyciężyć te problemy, deweloperzy wdrożyli podejście hybrydowe, łącząc uczenie ze wzmocnieniem z nadzorowanym dostrajaniem. Ta innowacyjna metoda znacznie poprawiła spójność i użyteczność modelu, w wyniku czego powstał potężny i wszechstronny DeepSeek R1, który widzimy dzisiaj.

Uruchamianie DeepSeek R1 lokalnie

Chociaż możliwości DeepSeek R1 są imponujące, możesz zastanawiać się, jak wykorzystać jego moc na własnej maszynie. W tym miejscu do gry wkracza Ollama. Ollama to wszechstronne narzędzie zaprojektowane do uruchamiania i zarządzania dużymi modelami językowymi (LLM), takimi jak DeepSeek R1, na komputerach osobistych. To, co sprawia, że Ollama jest szczególnie atrakcyjna, to jej kompatybilność z głównymi systemami operacyjnymi, w tym macOS, Linux i Windows, dzięki czemu jest dostępna dla szerokiego grona użytkowników. Jedną z wyróżniających się cech Ollamy jest obsługa API, w tym kompatybilność z OpenAI API. Oznacza to, że można płynnie zintegrować DeepSeek R1 z istniejącymi projektami lub aplikacjami, które są już skonfigurowane do pracy z modelami OpenAI. Aby rozpocząć uruchamianie DeepSeek R1 lokalnie za pomocą Ollama, postępuj zgodnie z instrukcjami instalacji dla swojego systemu operacyjnego:

- Dla macOS:

- Pobierz instalator ze strony internetowej Ollama

- Zainstaluj i uruchom aplikację

- Dla systemu Linux:

- Użyj polecenia curl do szybkiej instalacji: curl https://ollama.ai/install.sh | sh

- Alternatywą jest ręczna instalacja przy użyciu pakietu .tgz

- Dla systemu Windows:

- Pobierz i uruchom instalator ze strony internetowej Ollama

Po zainstalowaniu można rozpocząć korzystanie z DeepSeek R1 za pomocą prostych poleceń. Sprawdź wersję Ollama za pomocą ollama -v, pobierz model DeepSeek R1 za pomocą ollama pull deepseek-r1 i uruchom go za pomocą ollama run deepseek-r1. Dzięki tym krokom będziesz w stanie wykorzystać moc DeepSeek R1 bezpośrednio na swoim komputerze osobistym, otwierając świat możliwości rozumowania i rozwiązywania problemów opartych na sztucznej inteligencji.

Modele destylowane DeepSeek R1

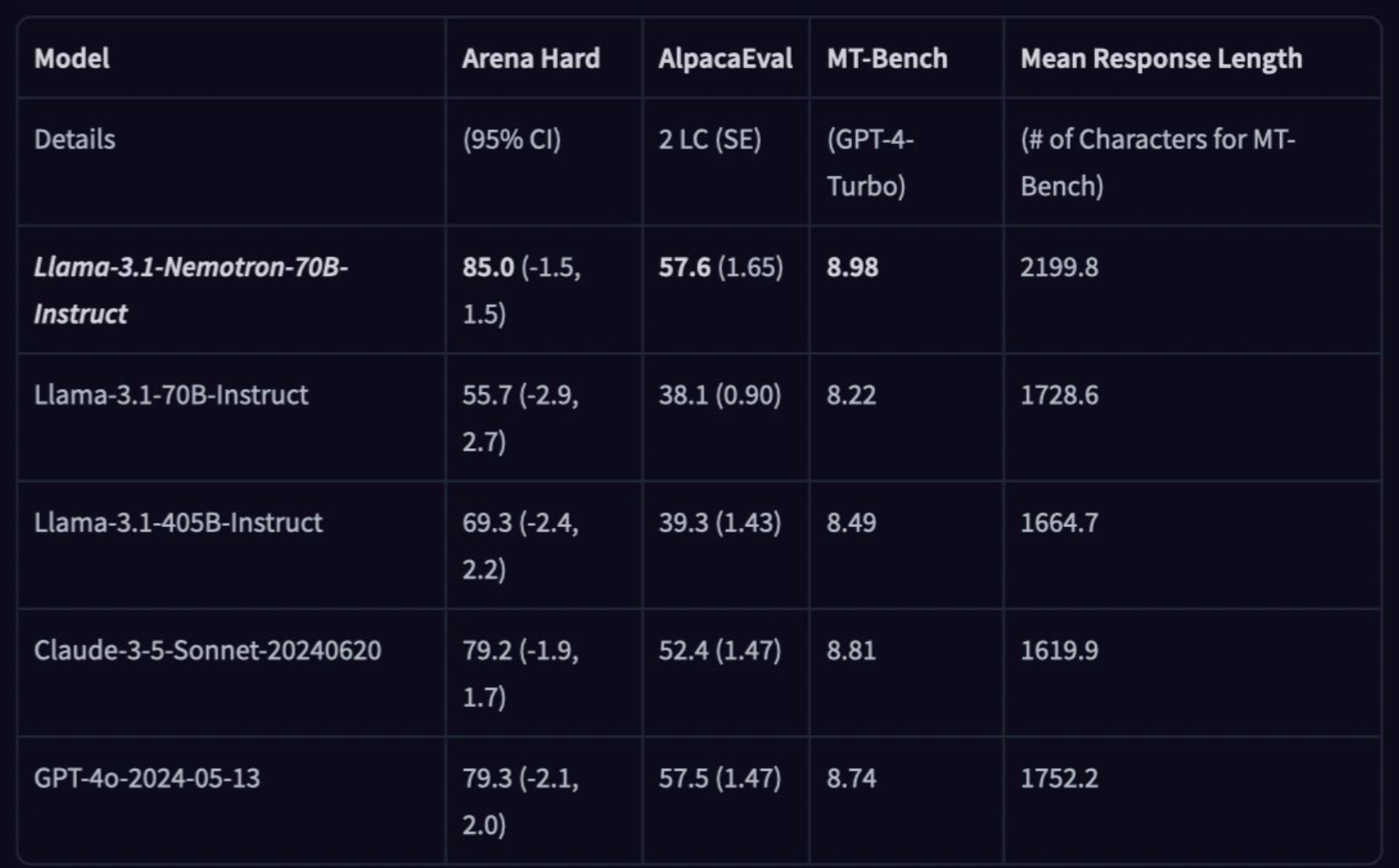

Aby zwiększyć wydajność przy jednoczesnym zachowaniu solidnych możliwości rozumowania, DeepSeek opracował szereg modeli destylowanych opartych na architekturze R1. Modele te są dostępne w różnych rozmiarach, zaspokajając różne potrzeby obliczeniowe i konfiguracje sprzętowe. Proces destylacji pozwala na uzyskanie bardziej kompaktowych modeli, które zachowują większość mocy oryginalnego modelu, dzięki czemu zaawansowane rozumowanie AI jest dostępne dla szerszego grona użytkowników i urządzeń.

Modele oparte na Qwen

- DeepSeek-R1-Distill-Qwen-1.5B: osiąga imponującą dokładność 83,9% w benchmarku MATH-500, choć wykazuje niższą wydajność w zadaniach kodowania.

- DeepSeek-R1-Distill-Qwen-7B : Demonstruje siłę w rozumowaniu matematycznym i pytaniach dotyczących faktów, z umiarkowanymi umiejętnościami kodowania.

- DeepSeek-R1-Distill-Qwen-14B: Doskonale radzi sobie ze złożonymi problemami matematycznymi, ale wymaga poprawy w zadaniach związanych z kodowaniem.

- DeepSeek-R1-Distill-Qwen-32B: wykazuje doskonałą wydajność w wieloetapowym rozumowaniu matematycznym i wszechstronność w różnych zadaniach, chociaż jest mniej zoptymalizowany pod kątem programowania.

Modele oparte na lamach

- DeepSeek-R1-Distill-Llama-8B : Dobrze radzi sobie z zadaniami matematycznymi, ale ma ograniczenia w zastosowaniach związanych z kodowaniem.

- DeepSeek-R1-Distill-Llama-70B: Osiąga najlepsze wyniki w matematyce i wykazuje się kompetentnymi umiejętnościami kodowania, porównywalnymi z modelem o1-mini OpenAI.

Jedną z kluczowych zalet tych destylowanych modeli jest ich wszechstronność pod względem kompatybilności sprzętowej. Zostały one zaprojektowane do wydajnego działania na różnych konfiguracjach, w tym na komputerach osobistych z procesorami CPU, GPU lub Apple Silicon. Ta elastyczność pozwala użytkownikom wybrać rozmiar modelu, który najlepiej pasuje do ich dostępnych zasobów obliczeniowych i konkretnych wymagań, niezależnie od tego, czy chodzi o rozwiązywanie problemów matematycznych, pomoc w kodowaniu, czy ogólne zadania rozumowania.

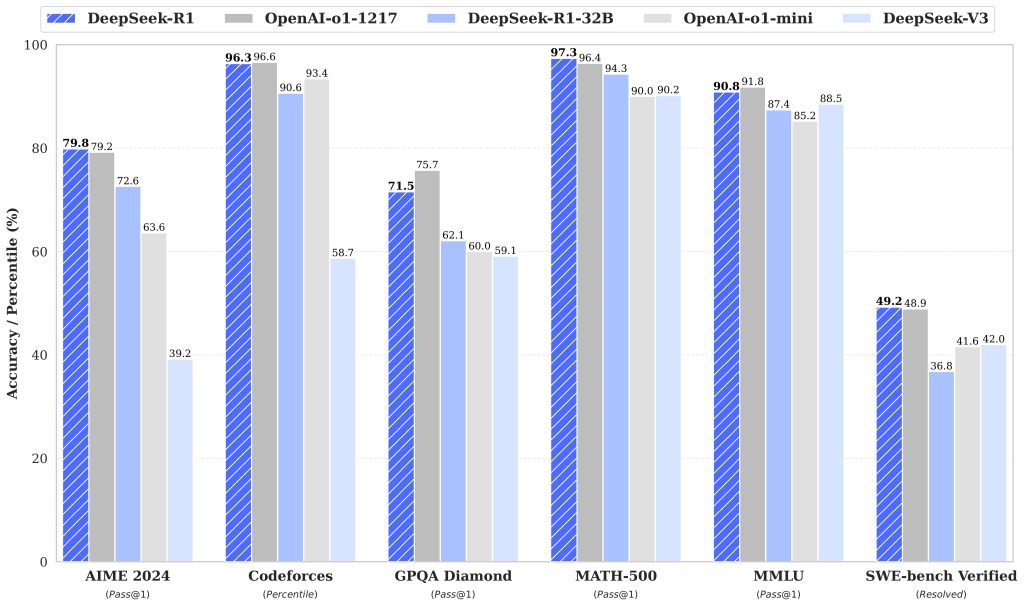

DeepSeek R1 vs. OpenAI O1

Gdy zagłębiamy się w możliwości DeepSeek R1, ważne jest, aby zrozumieć, jak wypada on w porównaniu z jednym z wiodących modeli w branży, OpenAI O1. To porównanie nie tylko podkreśla mocne strony DeepSeek R1, ale także rzuca światło na obszary, w których może wymagać poprawy.

Jedną z najbardziej uderzających różnic między tymi modelami jest ich koszt. DeepSeek R1 oferuje znacznie bardziej przystępną opcję, kosztując zaledwie 2% tego, co użytkownicy wydaliby na OpenAI O1. Ta opłacalność staje się jeszcze bardziej widoczna, gdy przyjrzymy się konkretnym cenom:

| Model | Koszt wejściowy (na milion tokenów) | Koszt wyjściowy (na milion tokenów) |

|---|---|---|

| DeepSeek R1 | $0.55 | $2.19 |

| OpenAI O1 | $15.00 | $60.00 |

Pod względem funkcjonalności oba modele zostały przetestowane przy użyciu historycznych danych finansowych inwestycji SPY. Jeśli chodzi o generowanie zapytań SQL do analizy danych, zarówno DeepSeek R1, jak i OpenAI O1 wykazały się wysoką dokładnością. Jednak R1 wykazał przewagę w zakresie efektywności kosztowej, czasami dostarczając bardziej wnikliwych odpowiedzi, takich jak uwzględnienie wskaźników w celu lepszego porównania. Oba modele przodowały w generowaniu algorytmicznych strategii handlowych. Warto zauważyć, że strategie DeepSeek R1 wykazały obiecujące wyniki, przewyższając S&P 500 i utrzymując lepsze wskaźniki Sharpe’a i Sortino w porównaniu z rynkiem. Pokazuje to potencjał R1 jako potężnego narzędzia do analizy finansowej i opracowywania strategii. Należy jednak zauważyć, że DeepSeek R1 nie jest pozbawiony wyzwań. Model czasami generował nieprawidłowe zapytania SQL i doświadczał limitów czasu. Problemy te były często łagodzone przez samokorygującą się logikę R1, ale podkreślają obszary, w których model można ulepszyć, aby dopasować go do spójności bardziej uznanych konkurentów, takich jak OpenAI O1.

Co dalej?

DeepSeek R1 stał się przełomem w dziedzinie analizy finansowej i modelowania AI. DeepSeek R1 oferuje rewolucyjne narzędzie do analizy finansowej, które jest open-source i niedrogie, dzięki czemu jest dostępne dla szerokiego grona odbiorców, w tym niepłacących użytkowników. Ta dostępność, w połączeniu z imponującą wydajnością w obszarach takich jak handel algorytmiczny i złożone rozumowanie, pozycjonuje DeepSeek R1 jako potężnego gracza w krajobrazie sztucznej inteligencji.

P: Jak DeepSeek R1 może ewoluować w przyszłości?

O: Jako model open-source, DeepSeek R1 ma potencjał do ciągłego ulepszania dzięki wkładowi społeczności. Możemy zobaczyć zwiększoną wydajność, rozszerzone możliwości, a nawet bardziej wyspecjalizowane wersje dostosowane do konkretnych branż lub zadań.

P: Jakie możliwości DeepSeek R1 oferuje deweloperom?

O: Deweloperzy mają wyjątkową możliwość odkrywania, modyfikowania i rozwijania modelu DeepSeek R1. Ta otwartość pozwala na innowacje w zastosowaniach sztucznej inteligencji, potencjalnie prowadząc do przełomów w dziedzinach od finansów po badania naukowe. Podsumowując, zachęcamy zarówno doświadczonych praktyków AI, jak i nowicjuszy do odkrywania modeli DeepSeek i przyczyniania się do ich rozwoju na zasadach open-source. Demokratyzacja zaawansowanych narzędzi sztucznej inteligencji, takich jak DeepSeek R1, otwiera ekscytujące możliwości innowacji i postępu w dziedzinie sztucznej inteligencji.