ジェンマ2 2b アーキテクチャ:革新と応用

最近、グーグル・ディープマインドは、その素晴らしいAIモデルのラインナップに最新のものを追加して発表した:Gemma 2 2bである。

20億個のパラメータを持つこのモデルは、先進的でありながらコンパクトなAIソリューションの開発における重要なマイルストーンとなる。

Gemma 2 2bは、業界の他のモデルと比較して比較的小型であるにもかかわらず、クラス最高のパフォーマンスを提供するように設計されています。

Gemma 2 2bが他と一線を画しているのは、非常に大型の同等製品を凌駕する卓越した能力である。

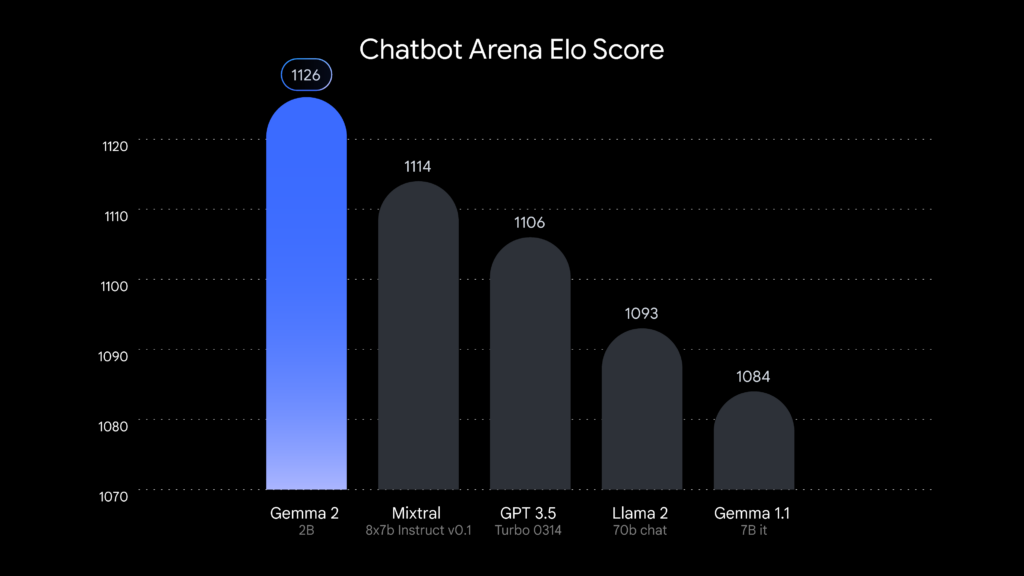

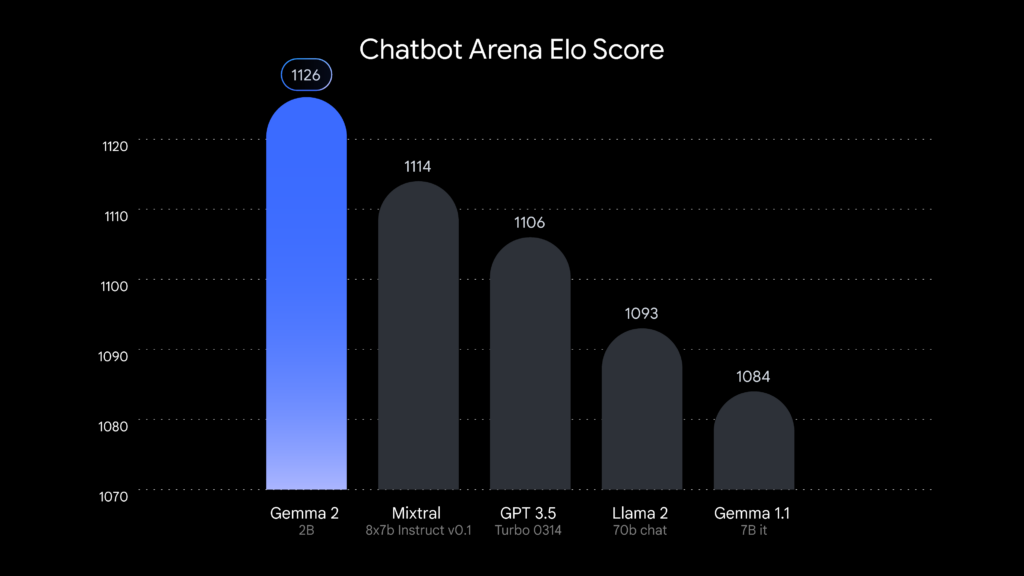

特に、GPT-3.5とMixtral 8x7Bの両方を様々なベンチマークで上回っており、その優れた効率性と堅牢性を証明している。

これはAI性能の新たな基準を打ち立て、大きければ良いというものではないことを証明している。

ジェンマ2bの主な特徴

Gemma 2 2bの際立った特徴は、その印象的なパフォーマンス指標です。

LMSYS Chatbot Arenaで1130点を獲得したGemma 2 2bは、GPT-3.5-Turbo-0613(1117)やMixtral-8x7B(1114)のようなはるかに大きなモデルを凌駕しており、単なるパラメータサイズよりも洗練されたトレーニング技術の有効性を実証しています。

これらのベンチマークは、Gemma 2 2bが強力であるだけでなく、非常に効率的であることを示している。

もう一つの重要な特徴は、有害なコンテンツを検出し、中程度に抑えるように設計されたShieldGemma安全性分類器である。

ShieldGemmaは、ヘイトスピーチや性的に露骨なものなど、様々なカテゴリーをターゲットにしており、より安全なAIインタラクションを保証する。

これにより、Gemma 2 2bは、機密性の高いアプリケーション向けの信頼性の高いAIソリューションとして位置づけられる。

さらにGemma Scopeは、モデルの意思決定プロセスを解き明かすためにスパースオートエンコーダを使用することで、透明性を高めています。

このツールは、Gemma 2 2bアーキテクチャがどのように情報を処理するかを明確に理解し、より透明で信頼性の高いAIシステムの開発に貢献します。

ジェンマ2b建築

Gemma 2 2bアーキテクチャは、そのコンパクトなサイズにもかかわらず優れたパフォーマンスを達成するために、高度なモデル圧縮と蒸留技術を活用しています。

これらの手法により、モデルはより大きな先行モデルから知識を抽出することができ、その結果、非常に効率的でありながら強力なAIシステムを実現します。

Gemma 2 2bは、Googleの最先端のTPU v5eハードウェアを利用し、2兆トークンからなる膨大なデータセットで学習されました。

これにより、迅速かつ効果的な学習が可能になり、モデルが複数の言語にわたる多様で複雑なタスクを処理できることを保証します。

90億(9B)や270億(27B)のパラメータバリエーションなど、Gemmaファミリーの他のモデルと比較すると、Gemma 2 2bはサイズと効率のバランスで際立っています。

そのアーキテクチャは、ラップトップからクラウド展開まで、幅広いハードウェア上で非常に優れた性能を発揮するように設計されており、研究者と開発者の両方にとって汎用性の高い選択肢となっている。

ジェンマ2 2bは本当にゲームチェンジャーなのか?

Gemma 2 2bアーキテクチャは、モバイルAIとエッジ・コンピューティングにとって重要な意味を持つ。

そのコンパクトなサイズは、性能を犠牲にすることなく様々なコンシューマーグレードのデバイスへの展開に適しており、スマートフォンやその他のポータブルガジェットに新たな可能性を開く。

Gemma 2 2bのもうひとつの重要な側面は、環境面での利点である。

Gemma 2 2bのような小型で効率的なモデルは、トレーニングや配備に必要な計算能力を削減し、大規模なAIシステムの二酸化炭素排出量に対する懸念の高まりに対応する。

この効率性は、AIをより身近なものにするだけでなく、持続可能な技術開発をサポートする。

今後、グーグルが競争力を維持するためには、継続的なイノベーションが不可欠となる。

メタ社のLlama 3.1やオープンエーアイ社のGPT-4oなど、他のハイテク大手がより新しく、より高度なモデルをリリースする中、グーグルはジェンマ・シリーズのさらなる改良に注力しなければならない。

ShieldGemmaのような安全機能の向上や、Gemma Scopeのようなツールによる透明性の向上などが考えられる。

結論ジェンマ2bの進むべき道

Gemma 2 2b アーキテクチャは、コンパクトなパラメータ数を維持しながら、多様なハードウェア構成において素晴らしいパフォーマンスを発揮し、AI業界において新たなベンチマークを打ち立てました。

GPT-3.5やMixtral 8x7bのような大規模モデルを凌駕するGemma 2 2bは、効率的なアーキテクチャと高品質なデータセットが、生のパラメータサイズに匹敵することを証明しています。

Gemma 2 2bの顕著な成果のひとつは、AI技術の民主化である。

コンシューマーグレードのデバイスやHugging Faceのようなオープンソースプラットフォームでモデルを利用できるようにすることで、グーグルはよりアクセスしやすく透明性の高いAIエコシステムをサポートしている。

ShieldGemmaやGemma Scopeのようなツールは、より安全で透明性の高いAIアプリケーションにさらに貢献する。

AIが進化し続けるにつれ、その焦点は、より巨大なモデルの作成から、より小さく効率的なモデルの改良へと移っていくかもしれない。

Gemma 2 2bは、この方向への極めて重要な動きを意味し、持続可能性とアクセシビリティを促進する。

これは、高度なAIモデルが様々なハードウェア上で効率的に実行され、高度なAI能力を民主化する新しい時代の先駆けとなるかもしれない。

まとめると、ジェンマ2 2bの成功は、AIの未来に有望な道筋を示すものだ。

グーグルが革新を続ける中、効率的で利用しやすいAIモデルの進歩は、AIが世界的に達成できることの視野を広げ、業界を前進させるだろう。