Gemini 1.5 Flash vs GPT-4o : La réponse de Google à GPT-4o ?

La course à l’IA s’est intensifiée, devenant un jeu de rattrapage entre les grands acteurs de la technologie. Le lancement de GPT-4o juste avant la conférence Google I/O n’est pas une coïncidence. Les incroyables capacités de GPT-4o en matière de multimodalité, ou d’omnimodalité pour être précis, ont eu un impact significatif sur la compétition Generative AI. Cependant, Google n’est pas du genre à se retenir. Lors de la conférence Google I/O, ils ont annoncé de nouvelles variantes de leurs modèles Gemini et Gemma. Parmi tous les modèles annoncés, le Gemini 1.5 Flash est celui qui a le plus d’impact. Dans ce blog, nous allons explorer les principales caractéristiques du Gemini 1.5 Flash et le comparer au Gemini 1.5 Pro et au Gemini 1.5 Flash vs GPT-4o pour déterminer lequel est le meilleur.

Comparaison entre Gemini 1.5 Flash et GPT-4o

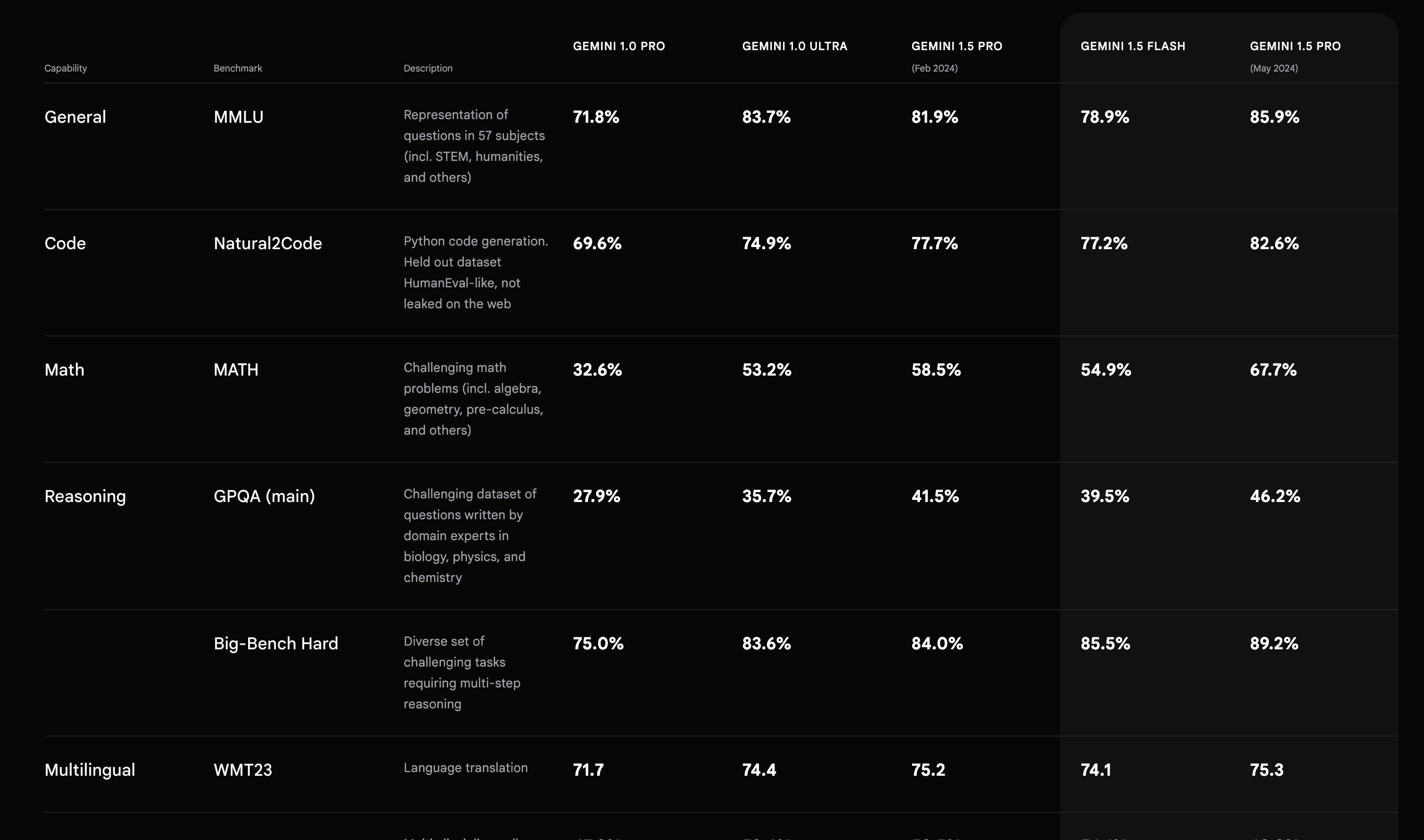

D’après les résultats des tests publiés par Google, le Gemini 1.5 Flash a des performances audio supérieures à celles de tous les autres LLM de Google et se situe au même niveau que le modèle sortant Gemini 1.5 Pro (février 2024) pour les autres tests. Bien que nous ne recommandions pas de s’appuyer entièrement sur les critères de référence pour évaluer les performances d’un LLM, ils permettent de quantifier la différence de performance et les mises à niveau mineures.

Fenêtre contextuelle

Tout comme le Gemini 1.5 Pro, le Flash est doté d’une fenêtre contextuelle de 1 million de jetons, ce qui est plus que n’importe quel modèle OpenAI et constitue l’une des plus grandes fenêtres contextuelles pour les LLM de niveau de production. Une fenêtre contextuelle plus large permet une meilleure compréhension des données et peut améliorer les techniques tierces telles que RAG (Retrieval-Augmented Generation) pour les cas d’utilisation avec une grande base de connaissances en augmentant la taille des morceaux. En outre, une fenêtre contextuelle plus grande permet de générer plus de texte, ce qui est utile dans des scénarios tels que la rédaction d’articles, de courriels et de communiqués de presse.

Multimodalité

Gemini-1.5 Flash est multimodal. La multimodalité permet de saisir le contexte sous la forme d’audio, de vidéo, de documents, etc. Les LLM avec multimodalité sont plus polyvalents et ouvrent les portes à davantage d’applications de l’IA générative sans aucun prétraitement requis.

“Les modèles Gemini 1.5 sont conçus pour traiter des contextes extrêmement longs ; ils ont la capacité de rappeler et de raisonner sur des informations à grain fin provenant d’au moins 10 millions de tokens. Cette échelle est sans précédent parmi les grands modèles de langage (LLM) contemporains, et permet le traitement d’entrées multimodales de longue durée, y compris des collections entières de documents, plusieurs heures de vidéo et près de cinq jours d’audio.” – Rapport DeepMind

Dabbas = voiture de train en hindi. Démonstration de la multimodalité et de la performance multilingue.

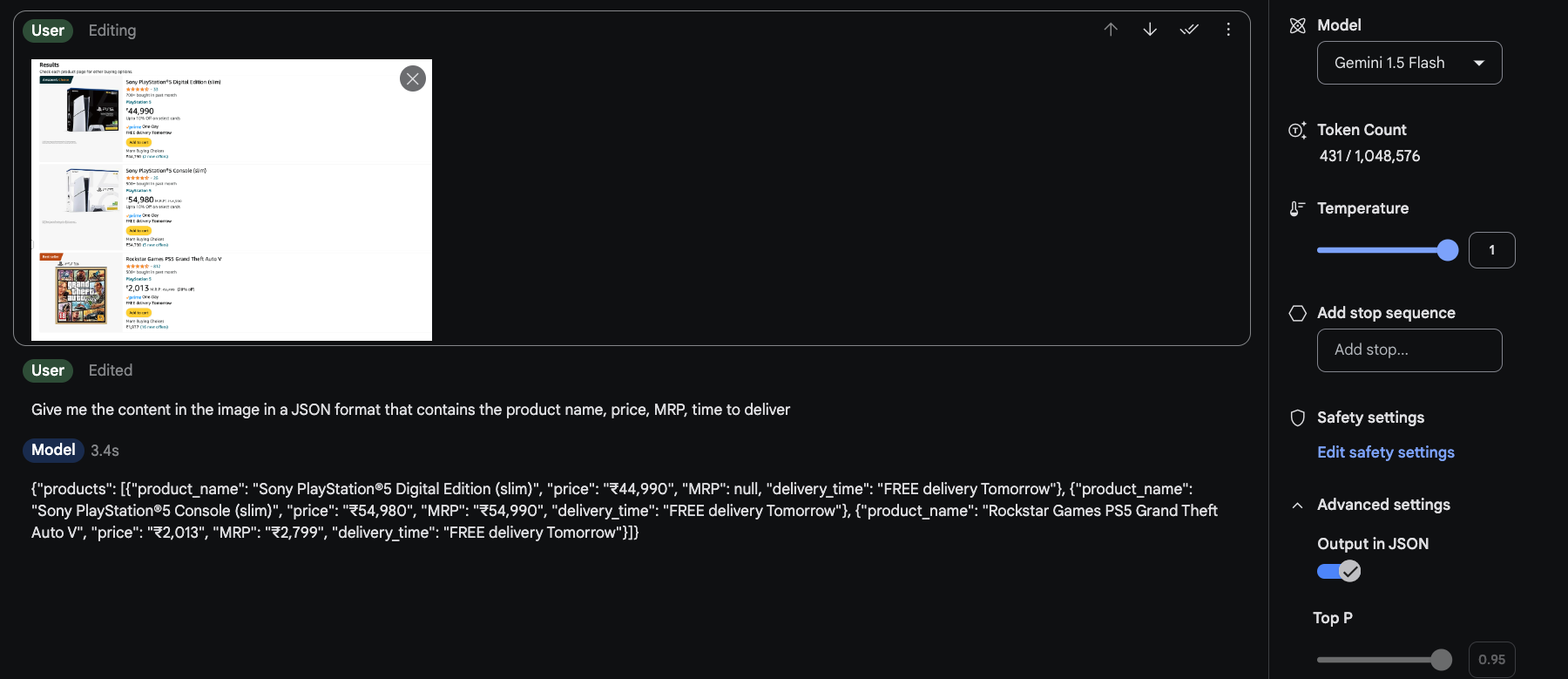

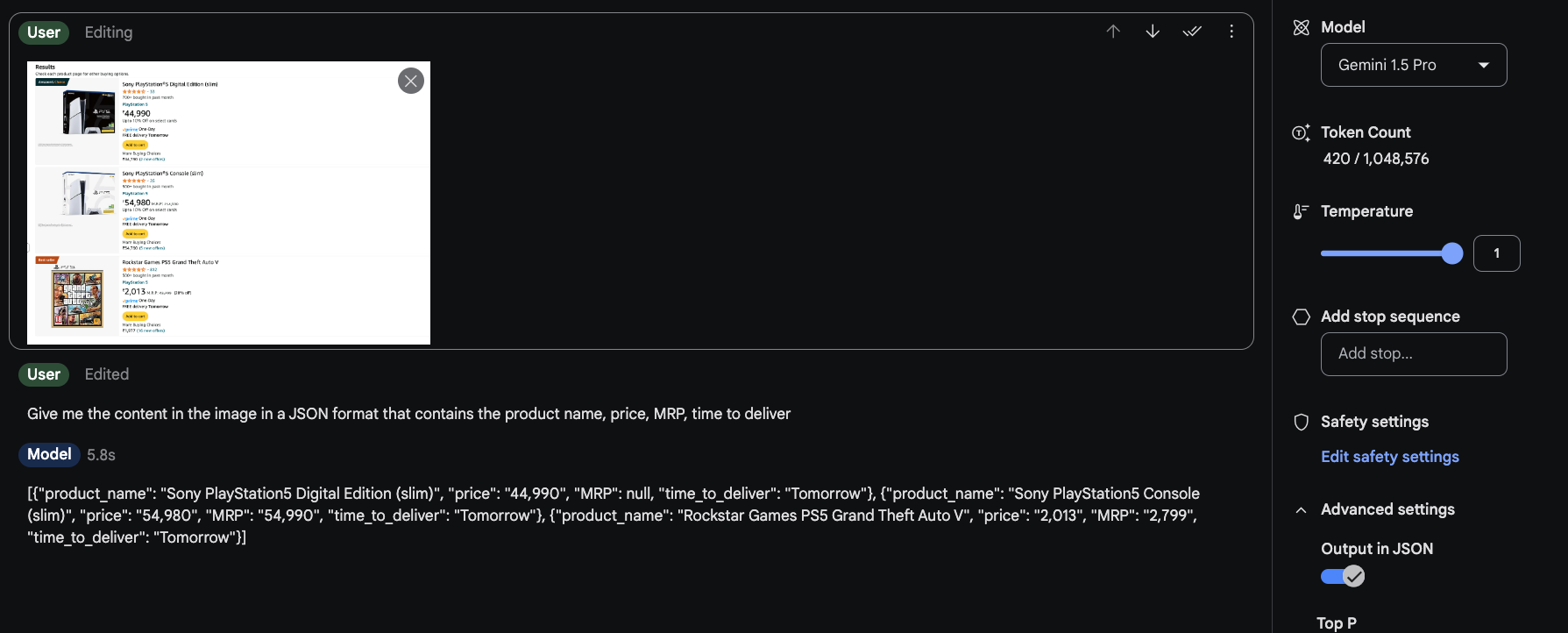

La multimodalité nous permet également d’utiliser les MLD comme substituts à d’autres services spécialisés. Par exemple. OCR ou Web Scraping.

Récupérez facilement des données sur des pages web et transformez-les.

Vitesse

Gemini 1.5 Flash, comme son nom l’indique, est conçu pour avoir une longueur d’avance sur les autres modèles en termes de temps de réponse. Pour l’exemple du web scraping mentionné ci-dessus, la différence de temps de réponse est d’environ 2,5 secondes, soit près de 40 % plus rapide, ce qui fait du Gemini 1.5 Flash un meilleur choix pour l’automatisation ou tout autre cas d’utilisation nécessitant une latence plus faible.

Quelques cas d’utilisation intéressants de Gemini 1.5 Flash

Résumer des vidéos

La compréhension vidéo de Gemini 1.5 Pro est l’élément le plus sous-estimé de l’IA.

Dans les années 50, il a “vu” une vidéo Youtube de 11 minutes (~175k tokens) des moments les plus emblématiques du sport et a été capable de lister parfaitement (à ma connaissance) les 18 moments. Il n’y a pas d’autre IA vidéo aussi bonne ! pic.twitter.com/LaVGR3ATfU – Deedy (@deedydas) April 5, 2024

Écrire du code à l’aide de la vidéo

C’est époustouflant 🤯

J’ai donné à Gemini un enregistrement vidéo Flash 1.5 de moi en train de faire des courses et il m’a donné le code Selenium en ~5 secondes. Cela peut changer beaucoup de choses. pic.twitter.com/Ojm6aueLe7 – Min Choi (@minchoi) 18 mai 2024

Automatiser le jeu

J’ai construit mon propre assistant omni en utilisant Gemini 1.5 Flash pour me guider dans Super Mario 64.

Gemini peut voir ce que je fais sur mon écran et communiquer avec moi en temps réel par la voix, et grâce au long contexte de 1M, il a une mémoire de tout ce que nous faisons ensemble. Incroyable. pic.twitter.com/doTngufjFL – Pietro Schirano (@skirano) 21 mai 2024