Google vs OpenAI : Google gagne-t-il ?

Après avoir raté le coche avec Bard dans le train de l’IA, Google a récemment dévoilé son dernier produit d’IA, Gemini. Dans le cadre de ce lancement, Bard a été rebaptisé Gemini et intègre désormais le nouveau Gemini Pro LLM. Approfondissons la question pour saisir l’ampleur de ces changements.

Qu’est-ce que Gemini AI ?

Gemini représente le tout dernier modèle de langue étendu (LLM) de Google, après LaMDA et PaLM. Contrairement à ses prédécesseurs, Gemini est nativement multimodal, capable de comprendre du texte, des images, de la parole et du code, et dispose de capacités de compréhension et de raisonnement améliorées.

Variantes de Gemini AI

L’IA Gemini se compose de trois grands modèles linguistiques :

- Gemini Nano : Optimisé pour l’efficacité sur l’appareil, il fournit des solutions d’IA rapides directement sur votre appareil personnel.

- Gemini Pro : Un modèle polyvalent et évolutif, capable de s’attaquer à diverses tâches avec des performances solides. Accessible sur la version gratuite de l’interface de chat Gemini.

- Gemini Ultra : le summum de la série Gemini, qui permet de résoudre des problèmes complexes et de repousser les limites des capacités de l’IA. Exclusif aux abonnés du plan Google One AI Premium.

Les modèles Gemini ont été entraînés en utilisant TPUv5e et TPUv4, en fonction de leur taille et de leur configuration. Training Gemini Ultra a utilisé une vaste flotte d’accélérateurs TPUv4 appartenant à Google et répartis dans plusieurs centres de données. Cela représente une augmentation significative de l’échelle par rapport à leur modèle phare précédent, le PaLM-2, qui présentait de nouveaux défis en matière d’infrastructure.

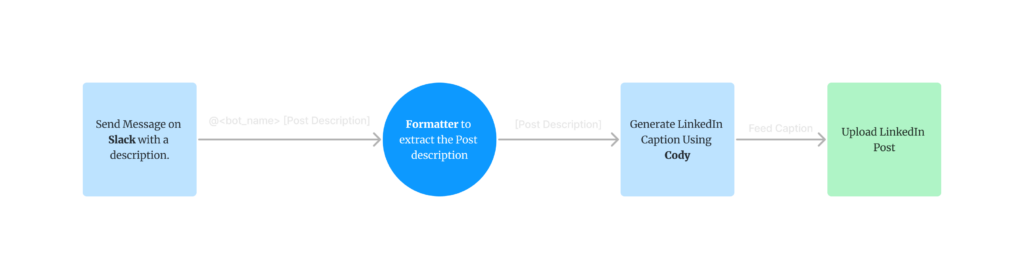

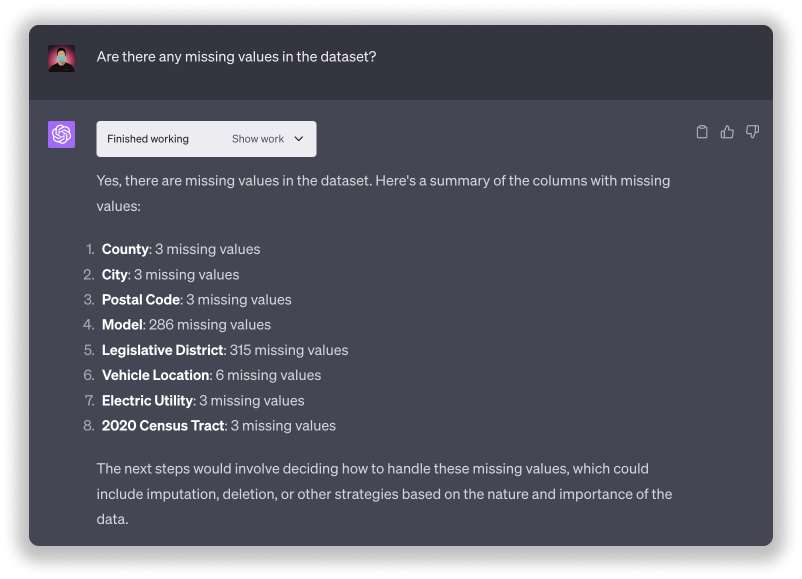

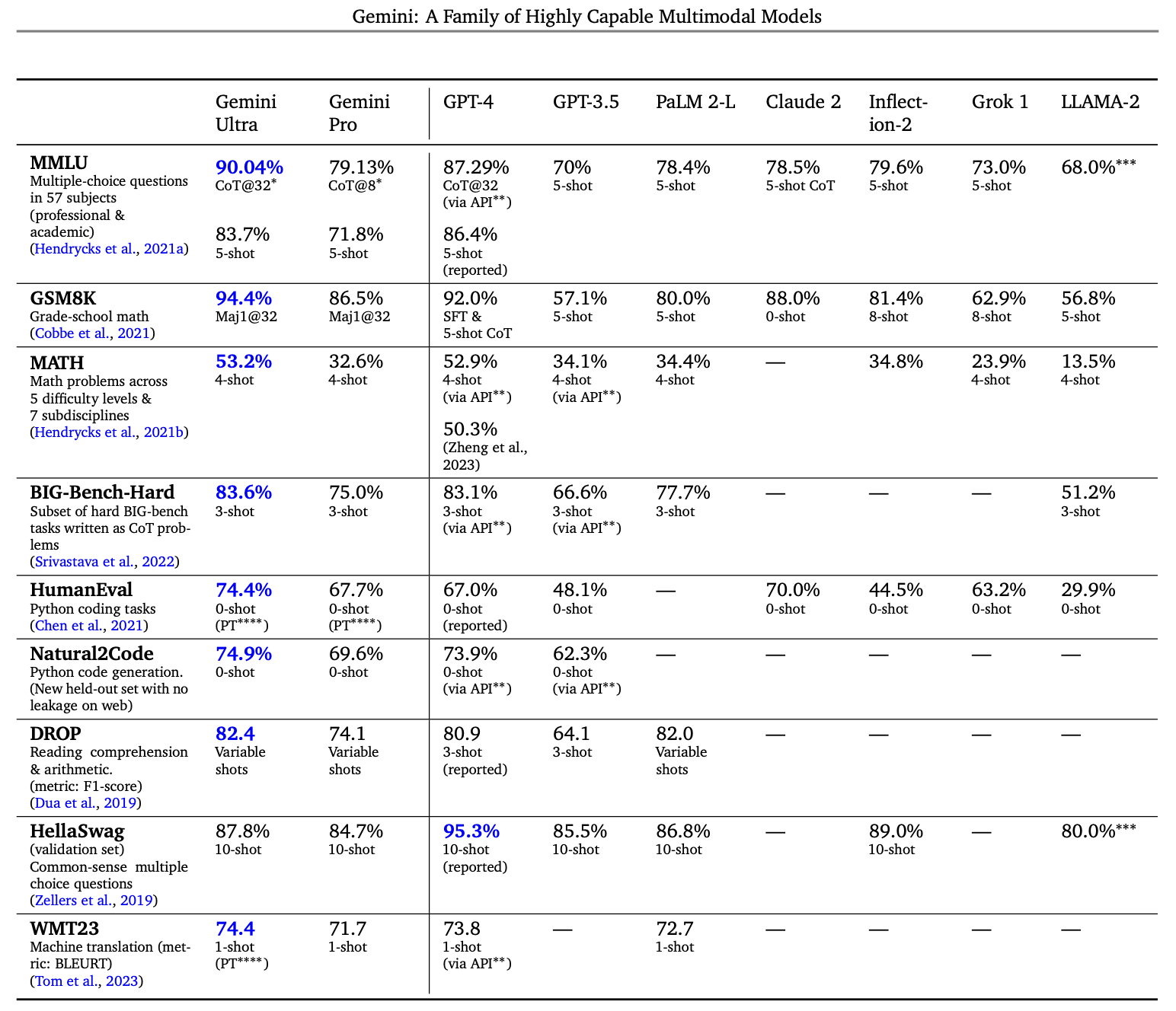

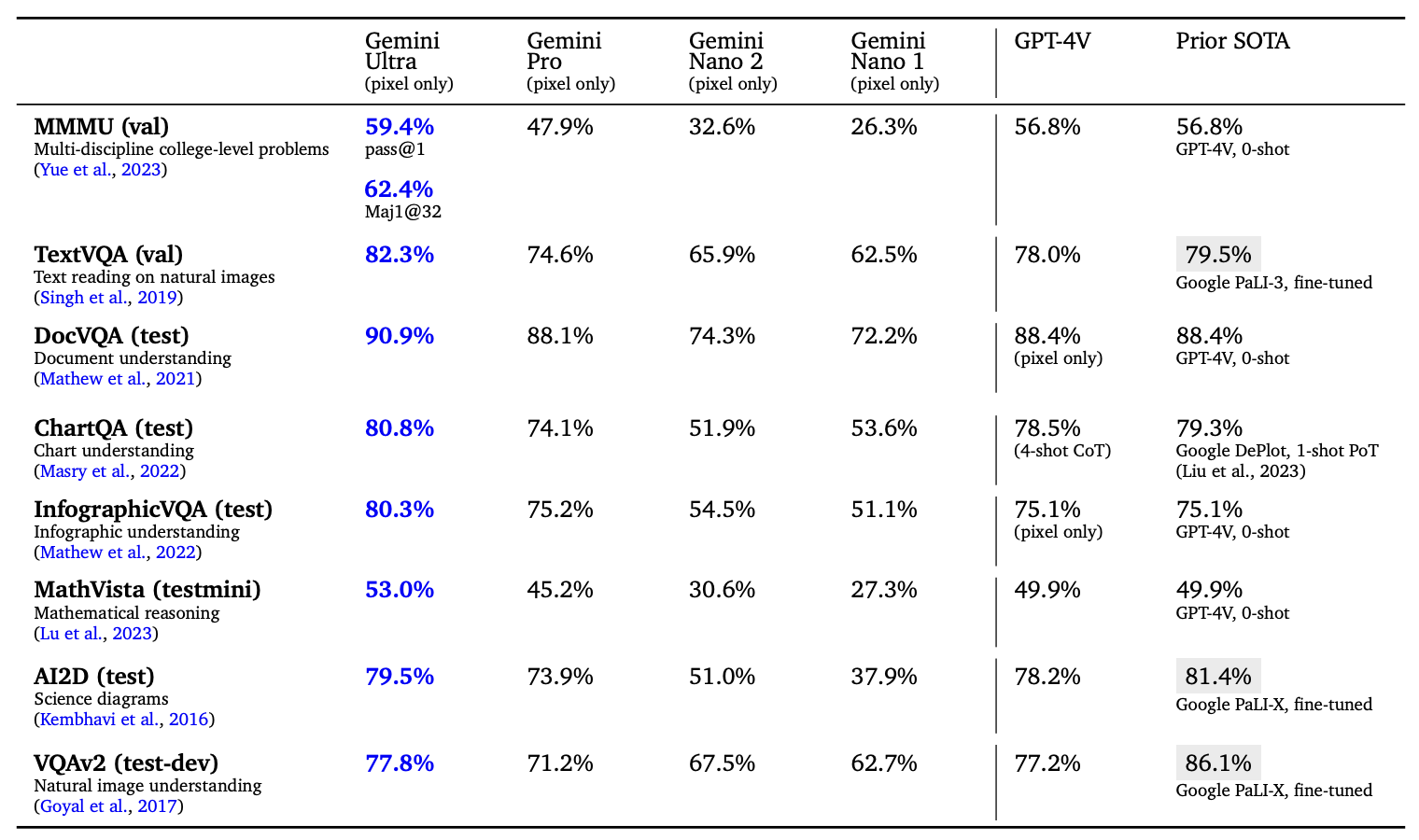

Comparaison de Gemini avec d’autres LLM

Compréhension du texte

Source : Google Deepmind

Compréhension de l’image

Source : Google Deepmind

Pour en savoir plus, cliquez ici.

Les avantages des Gémeaux

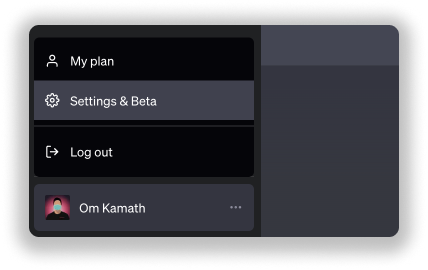

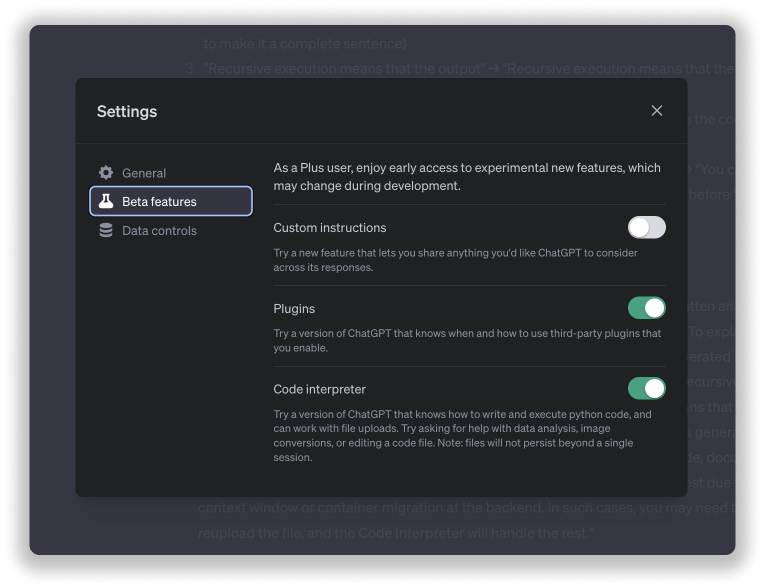

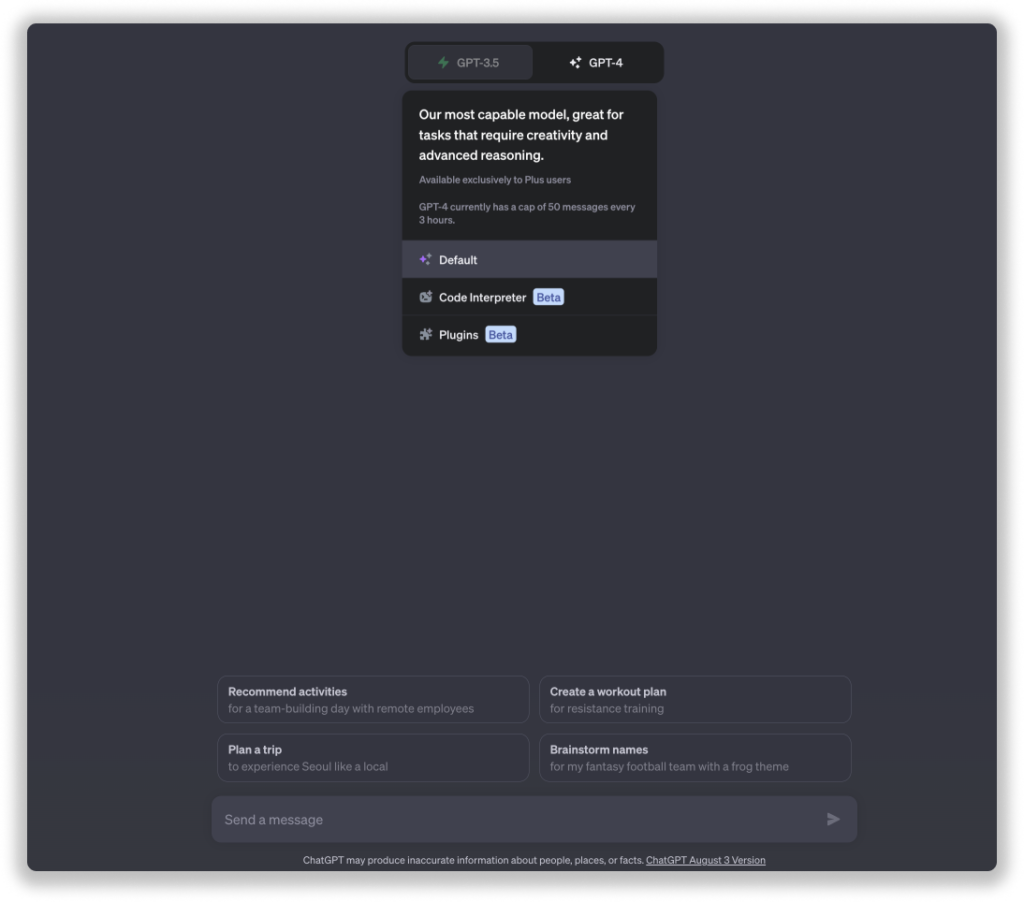

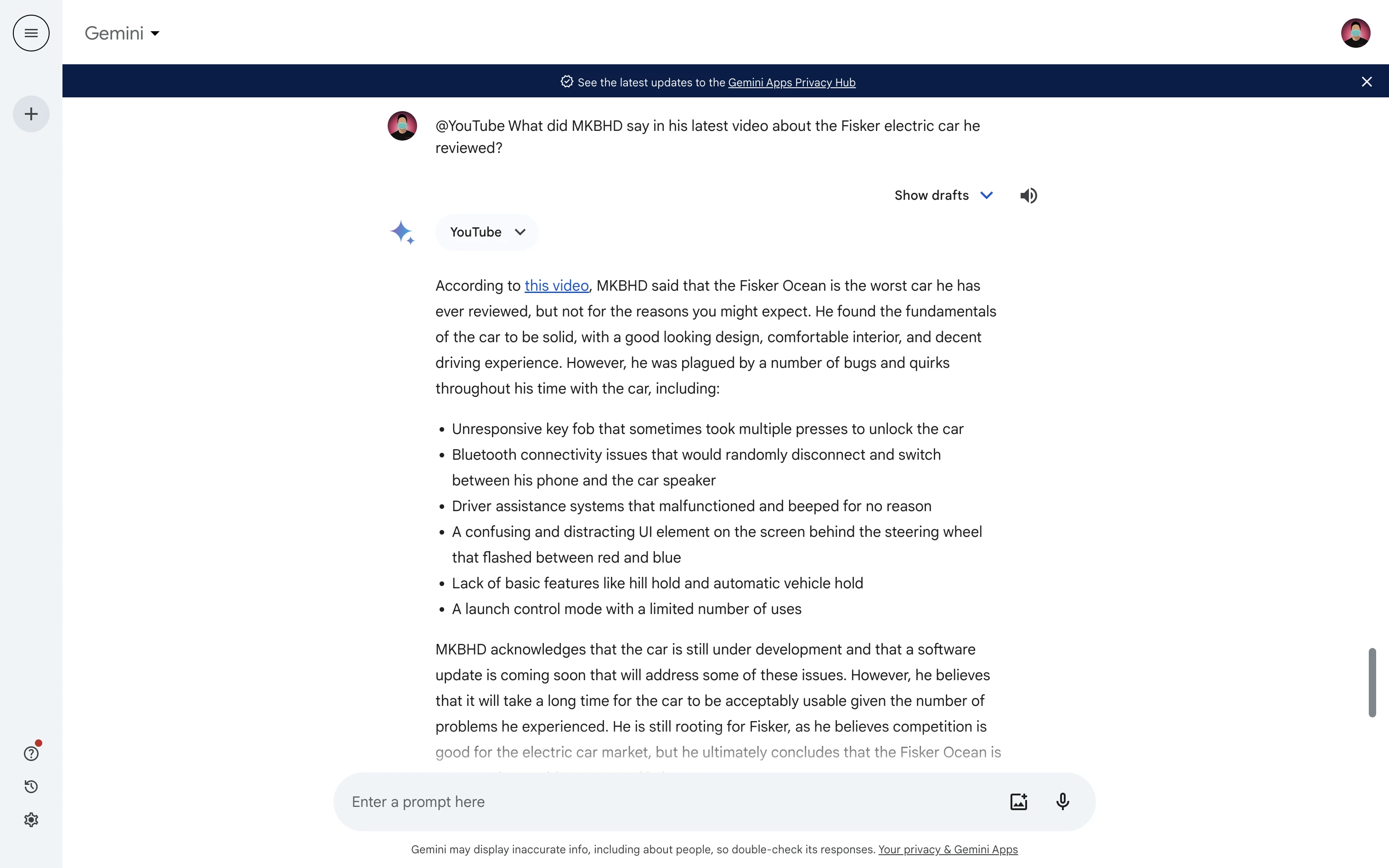

1. Intégration transparente avec toutes les applications Google

Gemini s’intègre désormais de manière transparente à toutes les applications Google, y compris Maps, YouTube, Gmail, etc. Pour interroger des applications spécifiques, il suffit de faire précéder le nom de l’application d’un “@” suivi de votre requête. Bien que des intégrations similaires soient possibles sur ChatGPT en utilisant des GPT et des plugins, elles n’offrent pas le même niveau d’homogénéité que les intégrations natives de Gemini.

L’expertise reconnue de Google en matière de technologie des moteurs de recherche permettra sans aucun doute d’améliorer les capacités de navigation sur le web de Gemini. S’appuyant sur les atouts fondamentaux des algorithmes de recherche et de l’indexation, Gemini offre aux utilisateurs une expérience de navigation transparente et efficace.

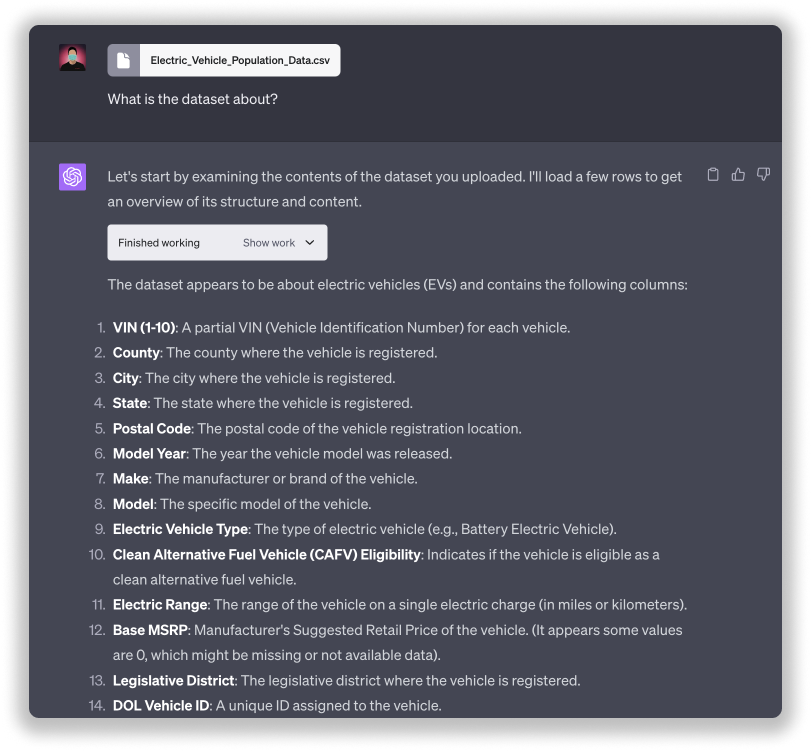

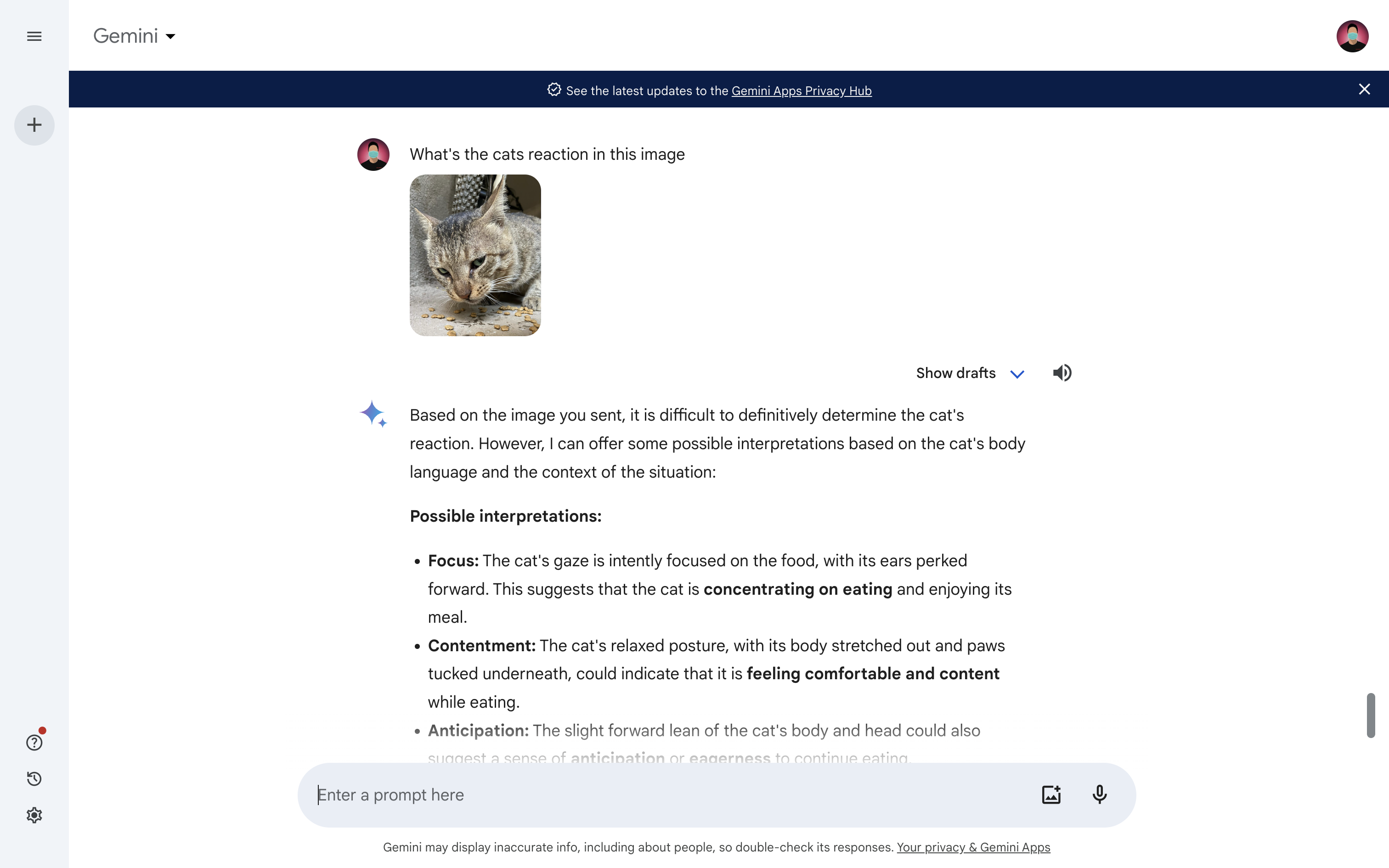

2. Capacités multimodales

Gemini offre désormais des capacités multimodales, y compris la compréhension des images, sur l’interface de chat Gemini, sans coût supplémentaire. Bien que ses performances lors des tests aient été décentes, il n’atteindra peut-être pas la précision de GPT-4V. Néanmoins, étant donné que c’est gratuit, nous ne pouvons pas vraiment nous plaindre, n’est-ce pas ? 😉 Il est possible que Gemini Ultra soit plus performant que GPT-4V sur la base des paramètres suivants

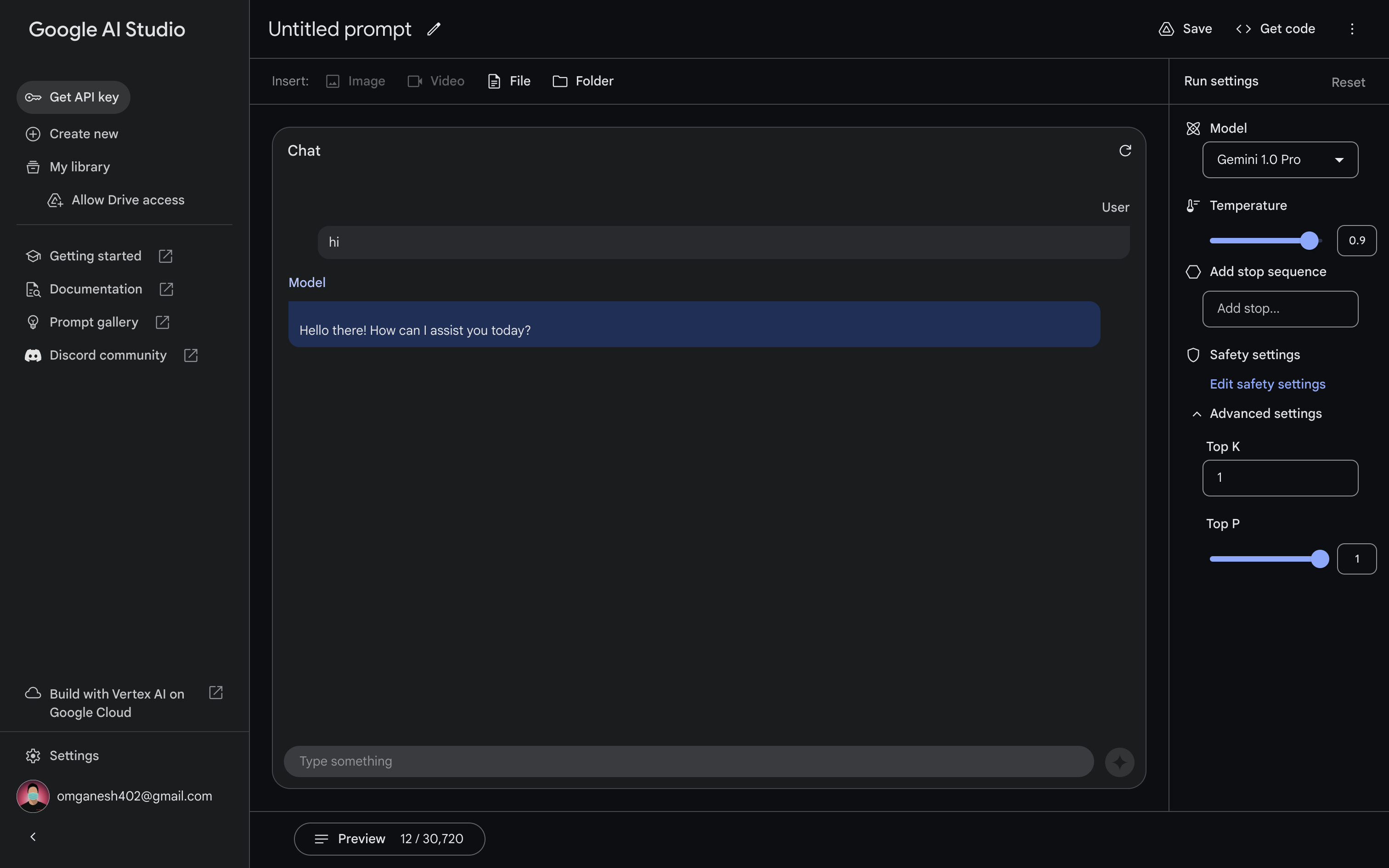

3. Accès gratuit pour les amateurs et les étudiants

Pour les développeurs LLM en herbe qui souhaitent se lancer dans ce domaine mais qui sont confrontés à des contraintes d’accès aux API GPT en raison des coûts, Google offre un accès gratuit à l’API Gemini Pro 1.0. Vous pouvez ainsi effectuer jusqu’à 60 requêtes par minute sur Google AI Studio, un outil de développement gratuit basé sur le web. Google AI Studio vous permet de développer rapidement des invites et d’obtenir une clé API pour le développement d’applications. En vous connectant à Google AI Studio avec votre compte Google, vous pouvez bénéficier de ce quota gratuit. C’est une excellente occasion de démarrer votre parcours LLM et d’explorer les embeddings, les bases de données vectorielles, la recherche sémantique, et bien plus encore.

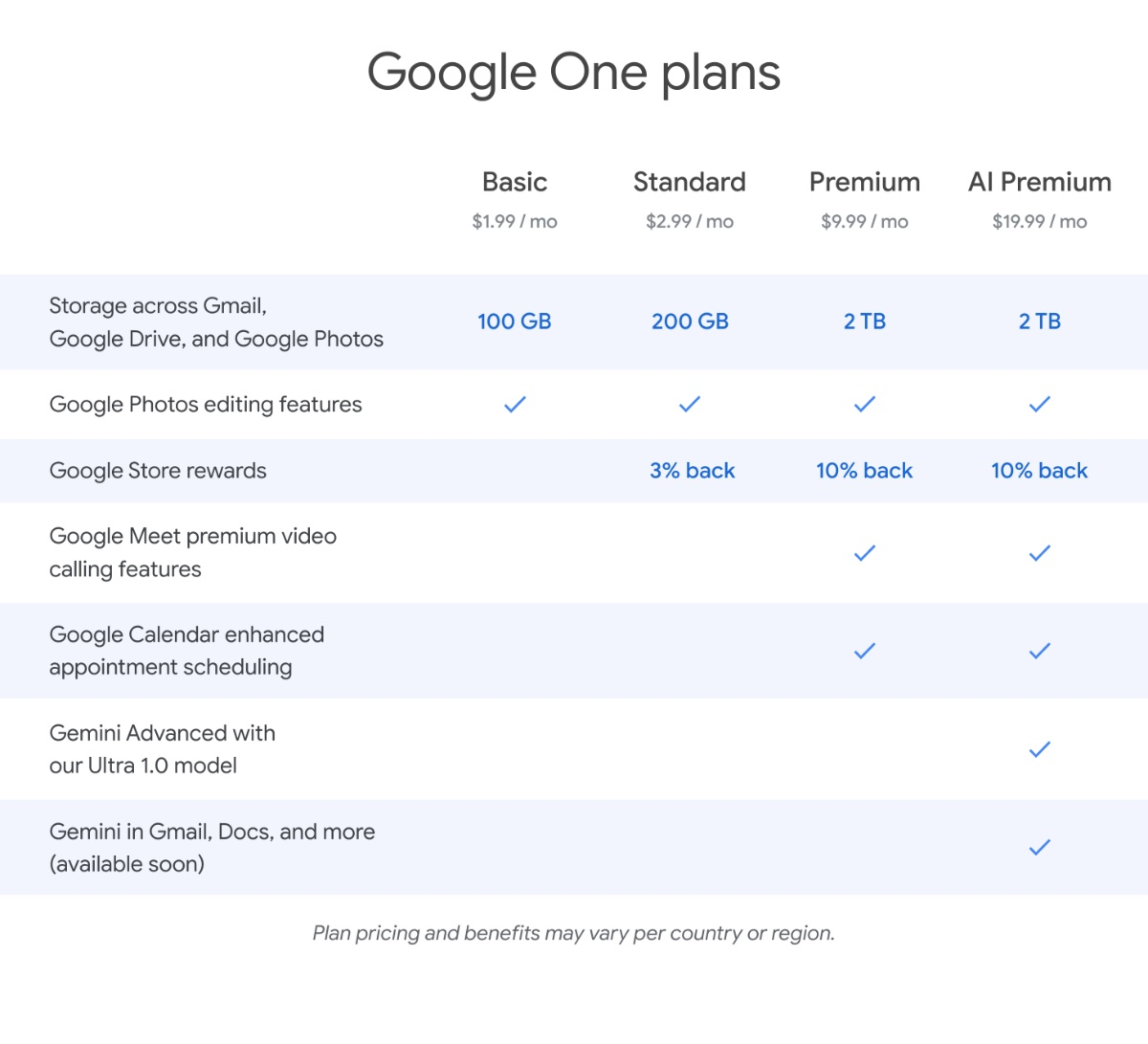

4. Rapport qualité-prix

Pour 20 dollars par mois, les utilisateurs peuvent accéder à GPT-4 via ChatGPT Plus. Pour le même prix, ils peuvent également accéder à Gemini Advanced avec Gemini Ultra 1.0, qui comprend des avantages supplémentaires tels que 2 To de stockage dans le nuage et l’intégration avec les applications Google telles que Gmail et Docs. Cependant, l’accès à Gemini Advanced nécessite un abonnement au plan Google One AI Premium. Malgré cette exigence, il offre un meilleur rapport qualité-prix.

L’introduction d’un plan de niveau intermédiaire avec 500 Go de stockage et l’accès à Gemini Advanced entre les plans Standard et Premium améliorerait considérablement l’accessibilité de Gemini, en particulier pour les étudiants et les utilisateurs ayant des besoins de stockage modérés. Google, si vous nous écoutez, merci de prendre en compte cette suggestion.

Quelle est la prochaine étape pour les Gémeaux ?

DeepMind, l’entreprise de Google, ne cesse de faire évoluer le modèle Gemini, avec le lancement récent de Gemini Pro 1.5, il y a tout juste une semaine. Dans cette variante actualisée, la fenêtre contextuelle a été étendue à 128 000 jetons. En outre, un groupe restreint de développeurs et d’entreprises clientes peut désormais expérimenter des fenêtres contextuelles encore plus larges, allant jusqu’à 1 million de jetons, par le biais d’avant-premières privées sur AI Studio et Vertex AI. Pour donner un ordre d’idée, un livre de non-fiction classique contient environ 300 000 jetons. Grâce à la fenêtre contextuelle de 1 million de jetons de Gemini Pro 1.5, les utilisateurs peuvent désormais télécharger des livres entiers dans le cadre de requêtes – une avancée remarquable par rapport à la fenêtre contextuelle de 128 000 jetons de GPT-4.

Face à la saturation des LLM dans le secteur de l’IA, Google semble avoir trouvé l’or avec son architecture améliorée, ses réponses rapides et son intégration transparente dans l’écosystème Google. Il pourrait en effet s’agir d’un pas dans la bonne direction, qui permettrait à OpenAI et à d’autres concurrents de rester vigilants.

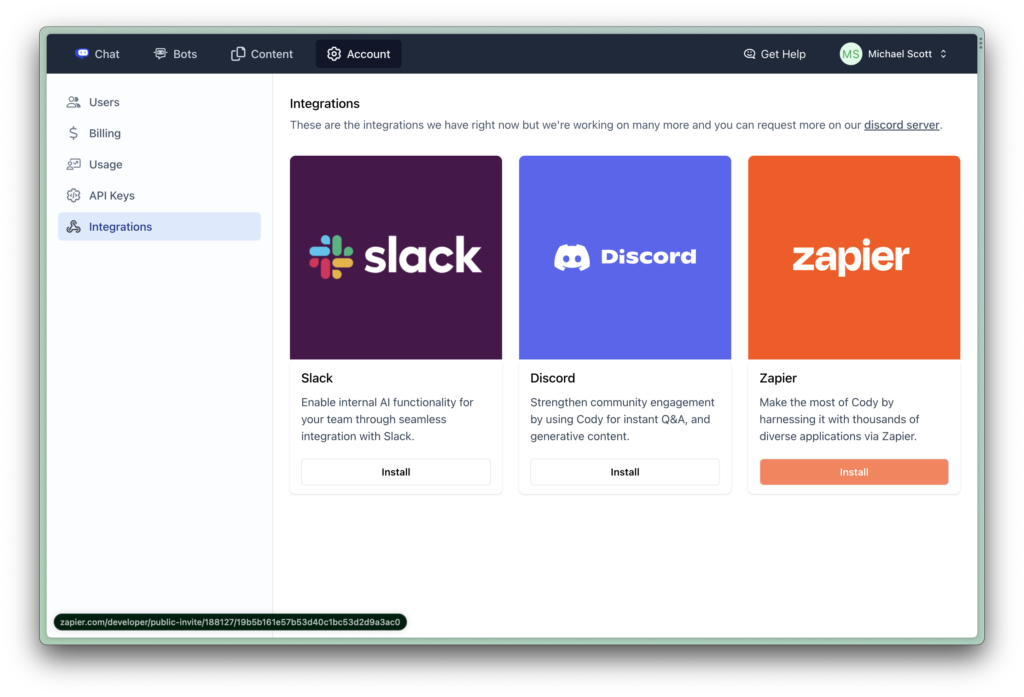

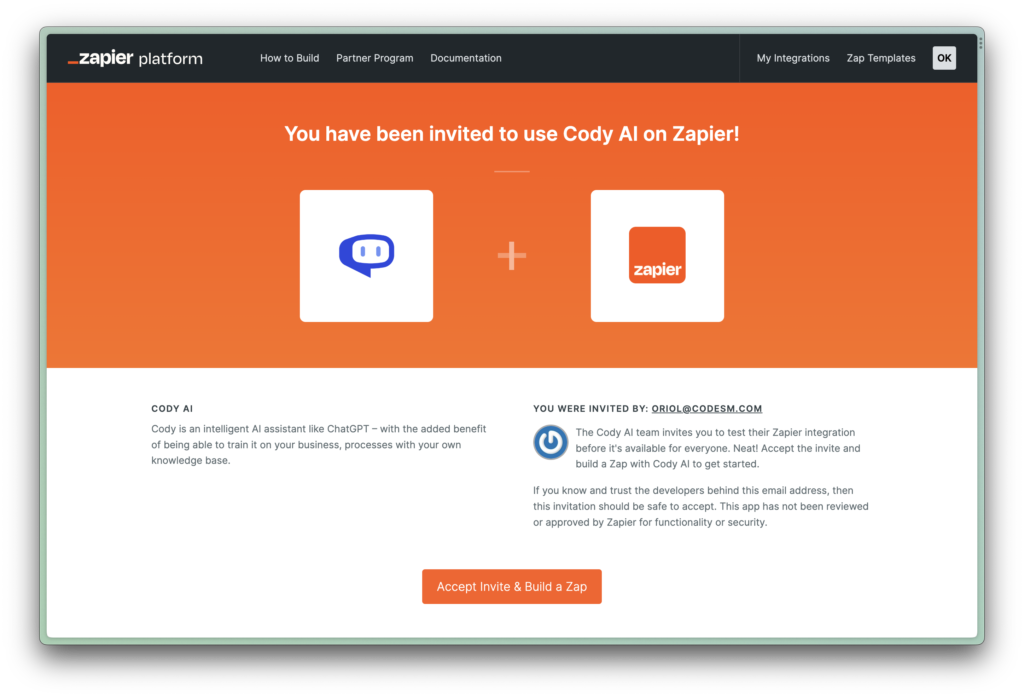

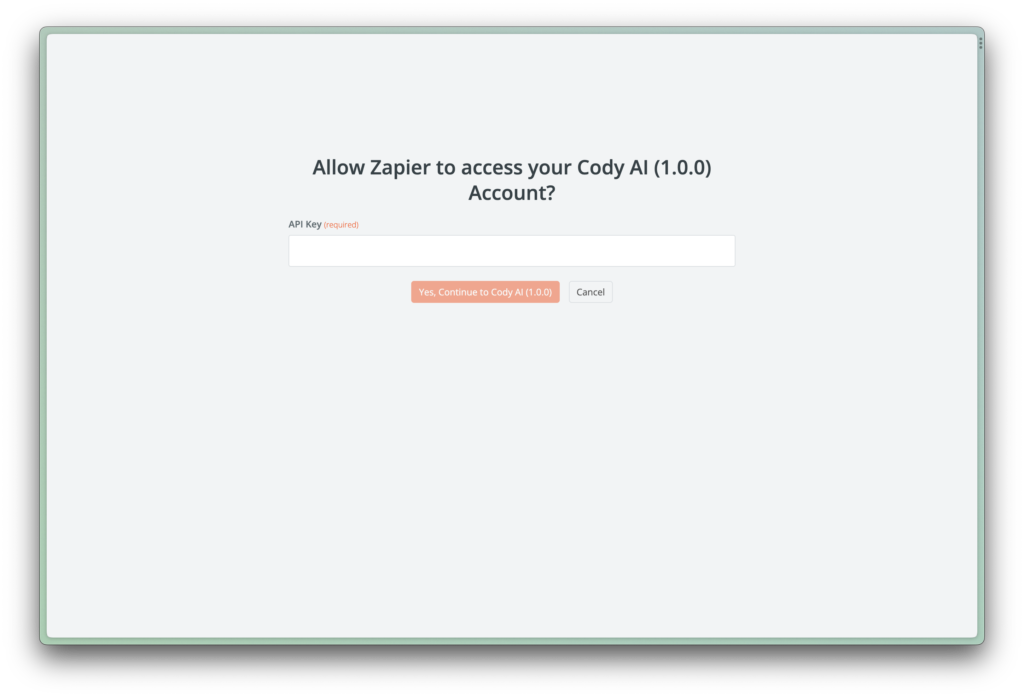

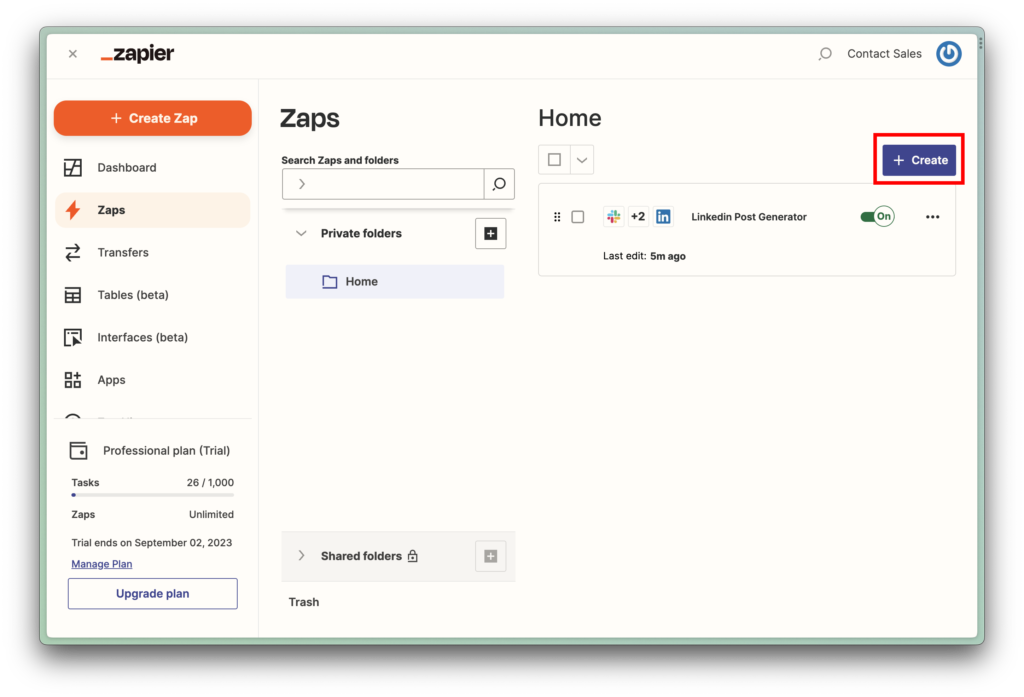

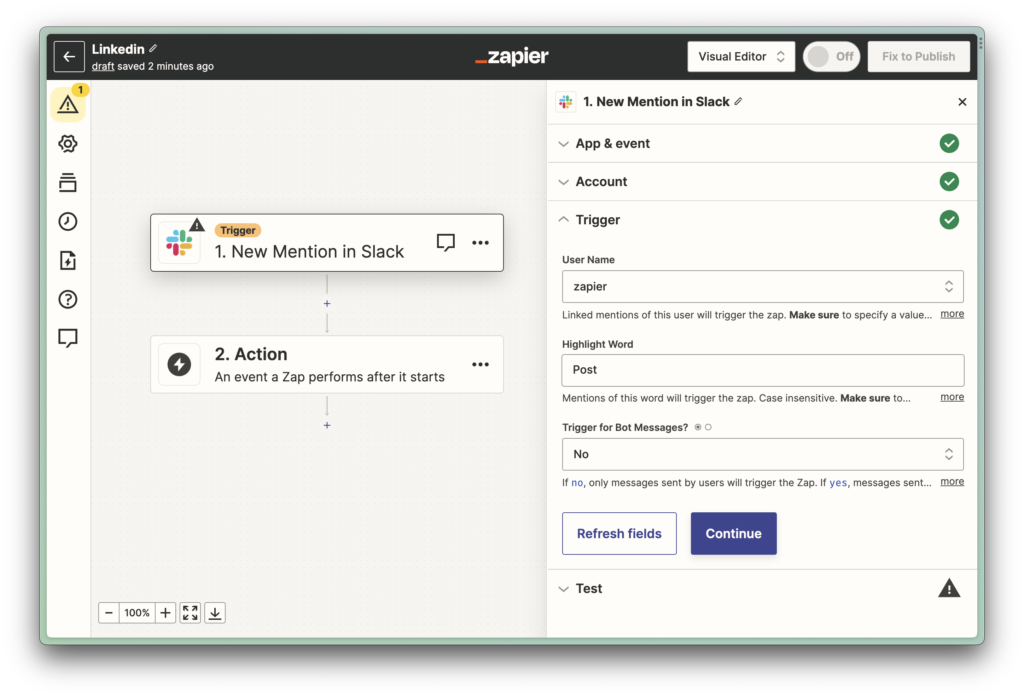

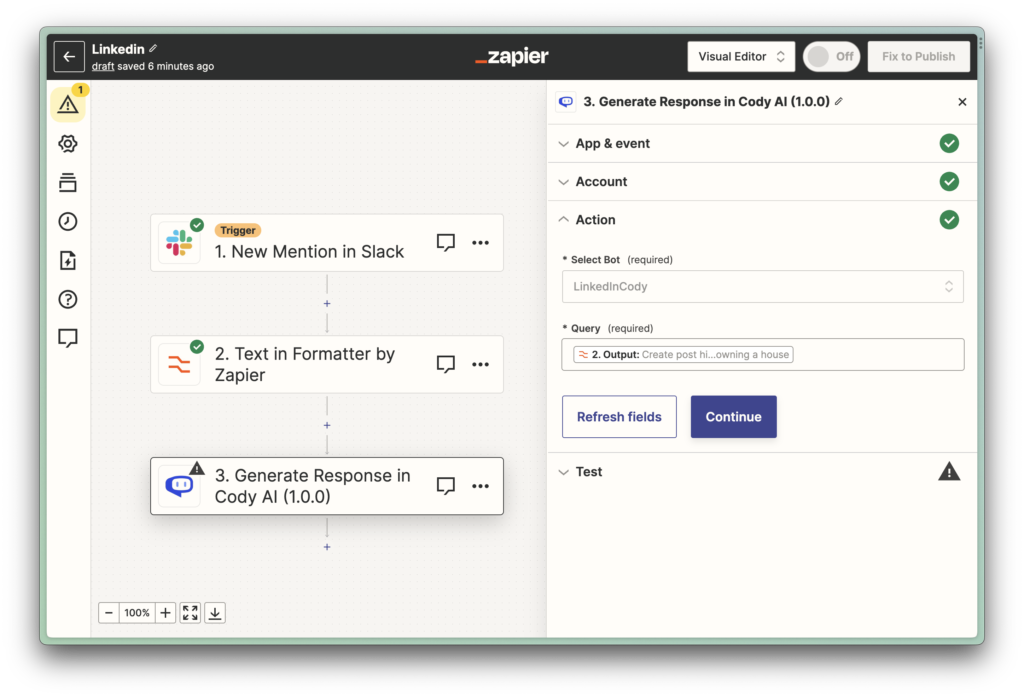

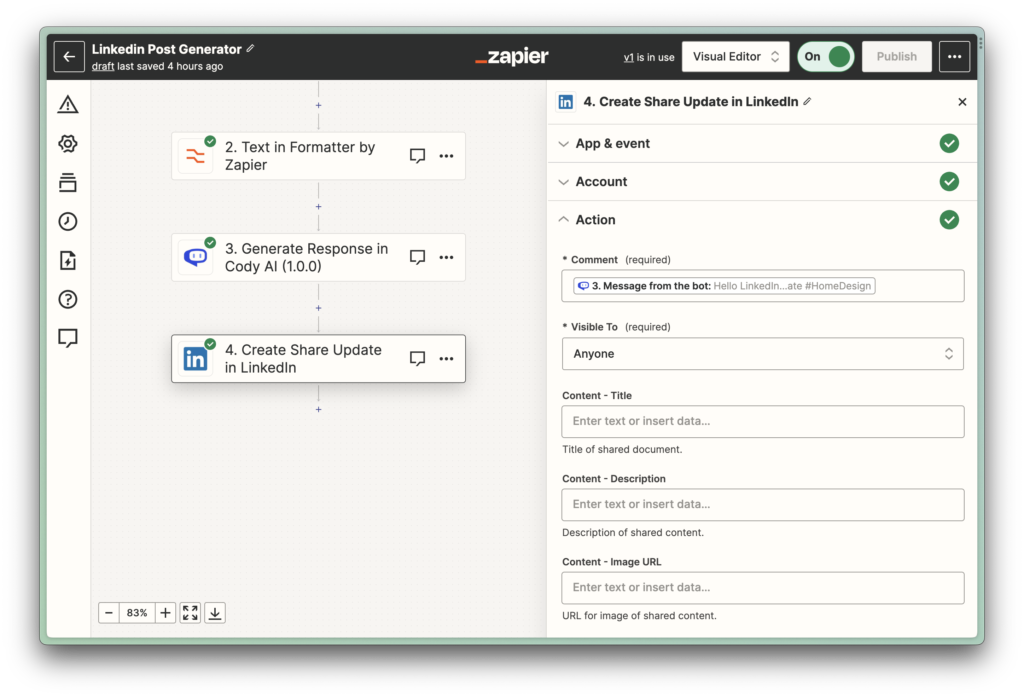

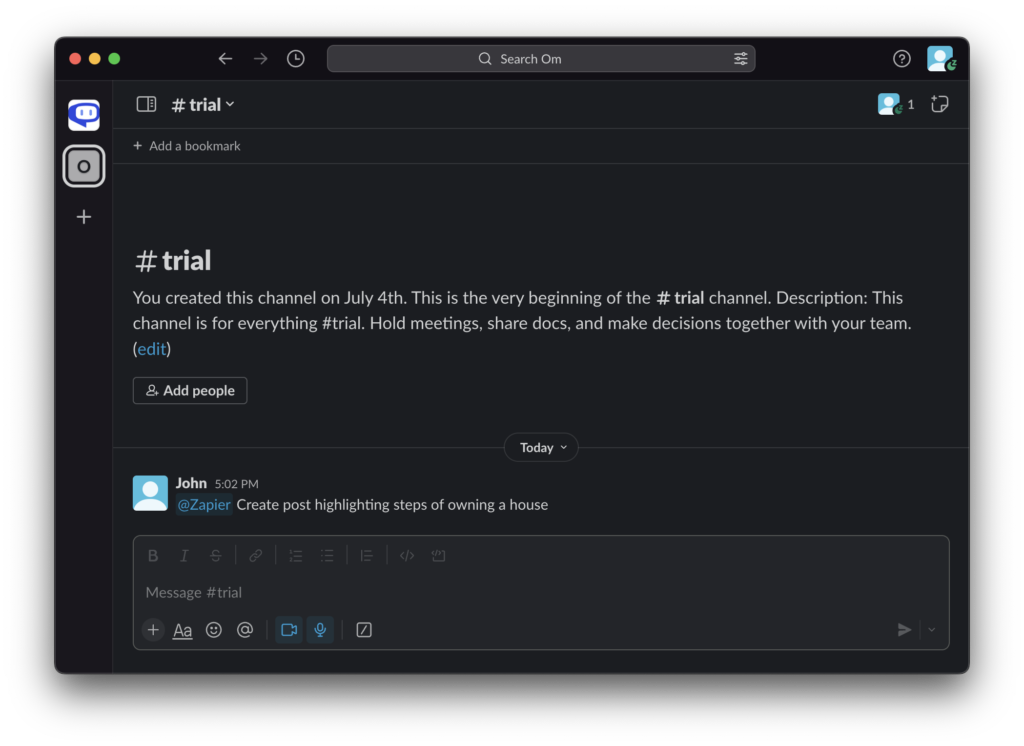

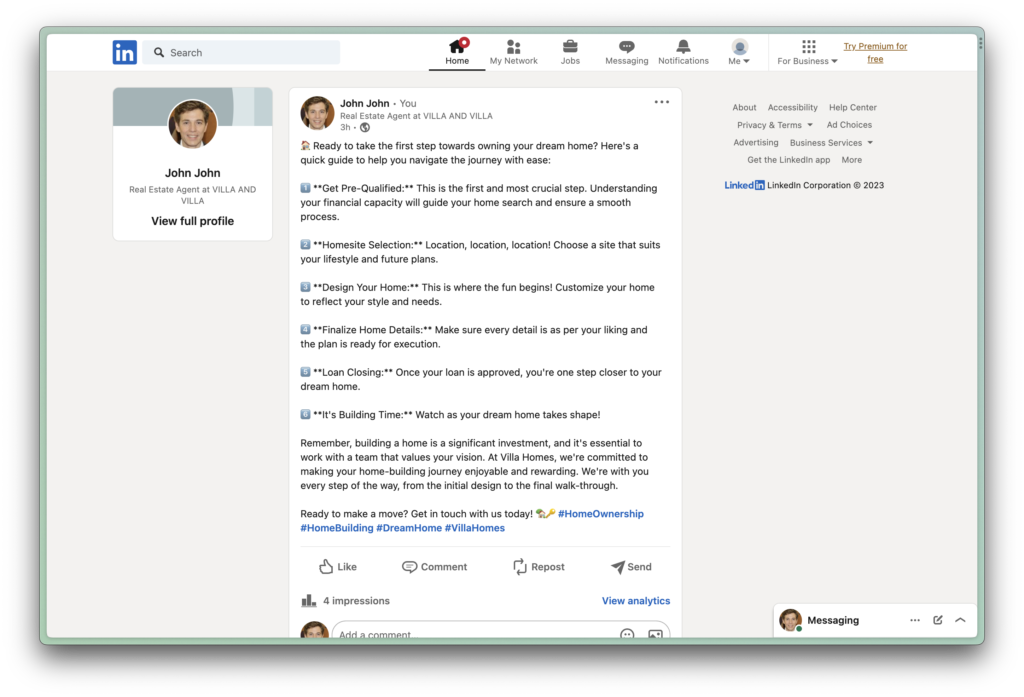

À l’ère de l’IA, il est crucial pour les entreprises d’avoir des employés bien formés, et l’intégration de l’IA dans la formation des employés peut représenter un investissement important. Si vous recherchez des solutions d’IA pour former vos employés, Cody est l’outil qu’il vous faut. Comme pour ChatGPT et Gemini, Cody peut être formé sur les données de votre entreprise, votre équipe, vos processus et vos clients, en utilisant votre base de connaissances unique. Cody est agnostique, ce qui vous permet de changer plus facilement de modèle en fonction de vos besoins.

Avec Cody, les entreprises peuvent exploiter la puissance de l’IA pour créer un assistant personnalisé et intelligent qui répond spécifiquement à leurs besoins, ce qui en fait un ajout prometteur au monde des solutions professionnelles basées sur l’IA.