Gemini Embedding 2 : le premier modèle d’intégration multimodale de Google

Gemini Embedding 2 : Fonctionnalités, références, prix et comment démarrer

La semaine dernière, Google a publié Gémeaux Embedding 2, le premier modèle d’intégration nativement multimodal construit sur l’architecture Gemini. Si vous travaillez avec des embeddings à quelque titre que ce soit, cela mérite votre attention. Il a le potentiel de perturber de manière significative les pipelines d’intégration multimodale sur lesquels la plupart des équipes s’appuient aujourd’hui.

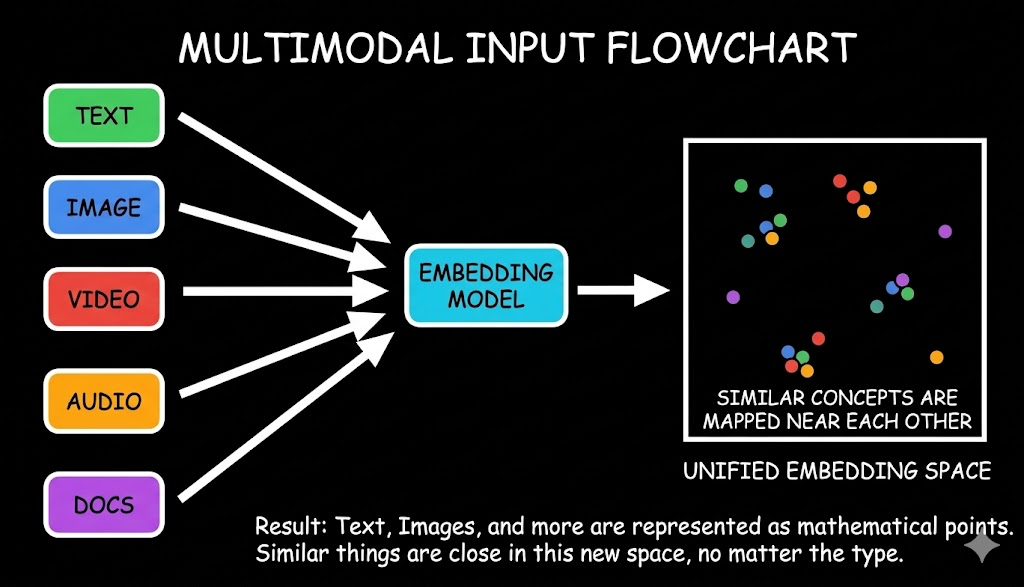

Jusqu’à présent, les modèles d’intégration phares d’OpenAI, Cohere et Voyage étaient principalement basés sur le texte. Quelques options multimodales existaient – CLIP pour l’alignement image-texte, Voyage Multimodal 3.5 pour les images et la vidéo – mais aucune ne couvrait l’ensemble des modalités dans un espace vectoriel unique et unifié. L’audio devait généralement être transcrit avant d’être intégré. La vidéo nécessitait l’extraction d’images combinée à l’intégration de transcriptions séparées. Les images vivaient dans leur propre espace vectoriel.

Gemini Embedding 2 change cette équation. Un modèle, un appel API, un espace vectoriel.

Voyons ce qu’il y a de nouveau.

Qu’est-ce que Gemini Embedding 2 ?

Gemini Embedding 2 (gemini-embedding-2-preview) est le premier modèle d’intégration entièrement multimodal de Google DeepMind. Il prend du texte, des images, des clips vidéo, des enregistrements audio et des documents PDF et les convertit tous en vecteurs qui vivent dans le même espace sémantique partagé.

Contrairement aux approches multimodales antérieures telles que CLIP, qui associent un codeur de vision à un codeur de texte et les alignent avec un apprentissage contrastif à la fin, Gemini Embedding 2 est construit sur le modèle de base Gemini lui-même. Cela signifie qu’il hérite d’une compréhension multimodale profonde dès le départ.

Image générée par Nano Banana

Exemple pratique : Imaginez que vous construisiez un système de gestion de l’apprentissage (LMS) avec des tutoriels vidéo, des conférences audio et des guides écrits. Grâce à Gemini Embedding 2, vous pouvez stocker les enchâssements de tous ces contenus dans un espace vectoriel unique et construire un chatbot basé sur RAG qui récupère les morceaux pertinents des vidéos, des audios et des documents. Auparavant, cela nécessitait un pipeline d’intégration à plusieurs niveaux – et même dans ce cas, il ne capturait que les transcriptions, sans tenir compte du contexte visuel d’une vidéo ou du ton de la voix d’un orateur.

Le modèle utilise l’apprentissage par représentation Matryoshka, ce qui signifie que vous n’êtes pas obligé d’utiliser les 3072 dimensions si vous n’en avez pas besoin. Vous pouvez réduire l’échelle à 1536 ou 768 et obtenir des résultats exploitables.

Modalités prises en charge et limites d’entrée

Le modèle accepte cinq types d’entrées, toutes mappées dans le même espace d’intégration :

| Modalité | Limite d’entrée | Formats |

|---|---|---|

| Texte | Jusqu’à 8 192 jetons | Texte brut |

| Images | Jusqu’à 6 images par demande | PNG, JPEG |

| Vidéo | Jusqu’à 120 secondes | MP4, MOV |

| Audio | Jusqu’à 80 secondes (natif, sans transcription) | MP3, WAV |

| PDFs | Documents PDF directement incorporés | Documents PDF |

Comparaison avec les modèles existants

Google a publié des comparaisons avec ses propres modèles, Amazon Nova 2 Multimodal Embeddings et Voyage Multimodal 3.5. Voici le tableau complet :

Texte-Texte

| Métrique | Gemini Embedding 2 | gemini-embedding-001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| MTEB Multilingue (tâche moyenne) | 69.9 | 68.4 | 63.8** | 58.5*** |

| Code MTEB (tâche moyenne) | 84.0 | 76.0 | * | * |

Gemini Embedding 2 est en tête pour les textes multilingues avec une marge confortable et gagne 8 points par rapport à son prédécesseur pour la recherche de codes. Ni Amazon Nova 2 ni Voyage ne rapportent de scores de code.

Texte-Image

| Métrique | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (rappel@1) | 89.6 | 74.0 | 76.0 | 79.4 |

| Docci (rappel@1) | 93.4 | – | 84.0 | 83.8 |

Une nette avance dans la recherche texte-image – plus de 9 points d’avance sur le concurrent le plus proche sur les deux critères de référence.

Image-Texte

| Métrique | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (rappel@1) | 97.4 | 88.1 | 88.9 | 88.6 |

| Docci (rappel@1) | 91.3 | – | 76.5 | 77.4 |

La recherche d’images dans le texte présente les écarts les plus importants, avec près de 15 points d’avance sur Amazon Nova 2 sur Docci.

Document texte

| Métrique | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| ViDoRe v2 (ndcg@10) | 64.9 | 28.9 | 60.6 | 65.5** |

Le seul critère où Voyage Multimodal 3.5 a une longueur d’avance (auto-évaluation). La recherche de documents est proche entre les modèles les plus performants.

Texte-Vidéo

| Métrique | Gemini Embedding 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| Vatex (ndcg@10) | 68.8 | 54.9 | 60.3 | 55.2 |

| MSR-VTT (ndcg@10) | 68.0 | 57.9 | 67.0 | 63.0** |

| Youcook2 (ndcg@10) | 52.5 | 34.9 | 34.7 | 31.4** |

C’est dans le domaine de la récupération de vidéos que Gemini Embedding 2 est le plus en avance – plus de 17 points au-dessus de Voyage sur Youcook2 et plus de 13 points sur Vatex.

Discours-Texte

| Métrique | Emboîtement Gemini 2 |

|---|---|

| MSEB (mrr@10) | 73.9 |

| MSEB ASR**** (mrr@10) | 70.4 |

La récupération de texte parlé n’est pas du tout contestée – ni Amazon ni Voyage ne la prennent en charge. C’est une catégorie que Gemini Embedding 2 possède à part entière.

– score non disponible ** auto-déclaré *** voyage-3.5 **** Le modèle ASR convertit les requêtes audio en texte.

Tarification

Le modèle est actuellement gratuit dans le cadre de la prévisualisation publique. Une fois qu’il est payant, voici comment il se décompose :

| Niveau gratuit | Palier payant (par 1M de jetons) | |

|---|---|---|

| Saisie de texte | Gratuit | $0.20 |

| Saisie d’images | Gratuit | 0,45 $ (0,00012 $ par image) |

| Entrée audio | Gratuit | 6,50 $ (0,00016 $ par seconde) |

| Entrée vidéo | Gratuit | 12,00 $ (0,00079 $ par image) |

| Utilisé pour améliorer les produits Google | Oui | Non |

Pour commencer

Le modèle est disponible dès maintenant en avant-première publique via l’API Gemini et Vertex AI sous l’identifiant de modèle gemini-embedding-2-preview. Il s’intègre à LangChain, LlamaIndex, Haystack, Weaviate, Qdrant, ChromaDB et Vector Search.

from google import genai

from google.genai import types

# For Vertex AI:

# PROJECT_ID='<add_here>'

# client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1')

client = genai.Client()

with open("example.png", "rb") as f:

image_bytes = f.read()

with open("sample.mp3", "rb") as f:

audio_bytes = f.read()

# Embed text, image, and audio

result = client.models.embed_content(

model="gemini-embedding-2-preview",

contents=[

"What is the meaning of life?",

types.Part.from_bytes(

data=image_bytes,

mime_type="image/png",

),

types.Part.from_bytes(

data=audio_bytes,

mime_type="audio/mpeg",

),

],

)

print(result.embeddings)

Essayez-le ici !

Nous avons créé une application de démonstration qui vous permet de tester les performances de recherche multimodale de gemini-embedding-2.

Vous pouvez obtenir la clé API en vous connectant à aistudio.google.com.

Limites à surveiller

- Le modèle est encore en avant-première publique (la mention “avant-première” signifie que les prix et le comportement peuvent être modifiés avant l’AG).

- L’entrée vidéo est limitée à 120 secondes et l’entrée audio à 80 secondes.

- Les performances dans des domaines de niche comme l’assurance qualité financière sont plus faibles ; évaluez-les par rapport à vos données spécifiques avant de vous engager.

- Pour les pipelines purement textuels sans plans multimodaux, le surcoût par rapport aux modèles textuels uniquement peut ne pas être justifié.

Le bilan

Gemini Embedding 2 n’est pas seulement une amélioration incrémentale, c’est un changement de catégorie. Pour les équipes qui construisent des systèmes RAG multimodaux, des recherches sémantiques sur différents types de médias ou des bases de connaissances unifiées, il résume en un seul appel d’API ce qui était auparavant un problème multi-modèle et multi-pipeline. Si vos données ne se limitent pas à du texte, c’est le modèle à évaluer en priorité.

Construire un RAG multimodal ne devrait pas signifier assembler des modèles d’intégration, des bases de données vectorielles et une logique d’extraction à partir de zéro. Si vous souhaitez une solution RAG-as-a-Service qui gère le pipeline d’intégration pour vous, inscrivez-vous à l’essai gratuit chez Cody et commencez à construire dès aujourd’hui.