OpenAI GPT-3.5 Turbo & GPT 4 Fine Tuning

A OpenAI inaugurou uma nova era para os programadores de IA, revelando um modelo GPT-3.5 Turbo melhorado. Não se trata de uma versão qualquer; os programadores têm agora a possibilidade de adaptar o modelo, optimizando-o para que se adeqúe melhor às suas aplicações específicas. Curiosamente, a OpenAI postula que, quando ajustado, o GPT-3.5 Turbo pode potencialmente eclipsar a proeza do GPT-4 fundamental em tarefas especializadas.

Esta personalização apresenta várias vantagens:

- Instruções coerentes: Os programadores podem moldar o modelo para aderir a directrizes específicas, assegurando que se mantém em sincronia com o tom linguístico definido pelo pedido inicial.

- Respostas consistentes: Quer se trate de código de preenchimento automático ou de chamadas de API com script, o modelo pode ser orientado para produzir resultados mais consistentes.

- Refinamento de tons: A voz de uma marca pode ser distintiva. O modelo pode ser ajustado para refletir esta voz, garantindo o alinhamento com a identidade da marca.

Uma das características mais importantes desta capacidade de afinação é a eficiência. Os primeiros utilizadores destacaram uma redução de 90% no tamanho do prompt após o ajuste fino, sem comprometer o desempenho do modelo. Isto não só acelera as chamadas API, como também se revela económico.

Se nos debruçarmos sobre a mecânica, a afinação é um processo multifacetado. Envolve a preparação de um conjunto de dados de treino, a modelação do modelo aperfeiçoado e a sua implementação. O ponto fulcral aqui é a preparação do conjunto de dados, que engloba tarefas como a criação de sugestões, a apresentação de uma infinidade de demonstrações bem estruturadas, o treino do modelo nestas demonstrações e, subsequentemente, o teste do seu valor.

No entanto, a OpenAI tem uma nota de precaução. Embora o fascínio da afinação seja inegável, não deve ser o primeiro passo para elevar o desempenho de um modelo. Trata-se de um trabalho complexo que exige muito tempo e experiência. Antes de embarcarem na viagem de afinação, os programadores devem primeiro familiarizar-se com técnicas como a engenharia de pedidos, o encadeamento de pedidos e a chamada de funções. Estas estratégias, juntamente com outras boas práticas, servem frequentemente como passos preliminares no aperfeiçoamento do modelo.

Antecipação da afinação da GPT-4

Aproveitando o impulso do anúncio do ajuste fino do GPT-3.5 Turbo, a OpenAI provocou a comunidade de desenvolvedores com outra revelação: a chegada iminente de recursos de ajuste fino para o tão esperado modelo GPT-4, com lançamento previsto para o outono. Este facto aumentou certamente os níveis de entusiasmo, com muitos ansiosos por aproveitar as capacidades melhoradas da GPT-4.

O ajuste fino torna-se mais fácil

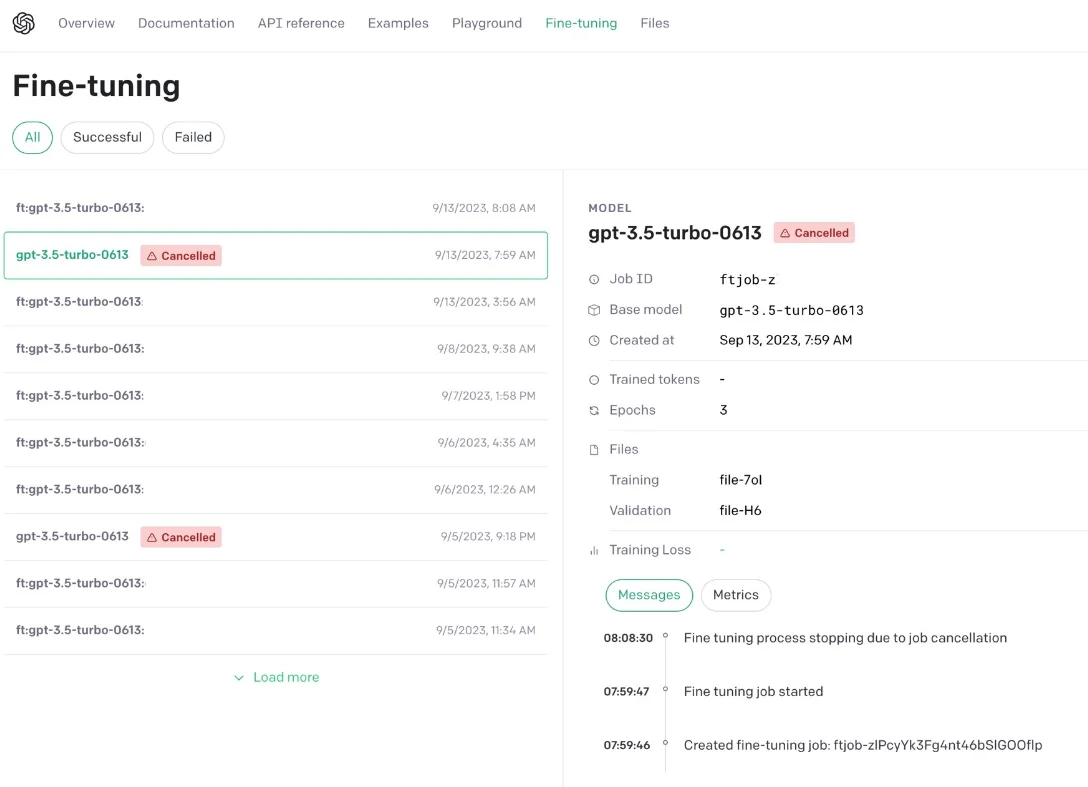

Na última atualização, a OpenAI lançou a sua interface de utilizador de afinação. Os programadores podem agora acompanhar visualmente as suas actividades de afinação. E há mais no horizonte; a capacidade de criar ajustes finos diretamente através desta IU será revelada nos próximos meses.

Além disso, a OpenAI tem como objetivo capacitar os seus utilizadores. Aumentaram o limite de formação simultânea de um modelo único para três, permitindo aos programadores afinar vários modelos em simultâneo, maximizando a eficiência.

Com estes avanços, a OpenAI continua a fortalecer a sua posição na vanguarda da inovação da IA, oferecendo consistentemente ferramentas que não só redefinem o presente como também abrem caminho para o futuro.