Gemini Embedding 2: o primeiro modelo de incorporação multimodal do Google

Gemini Embedding 2: recursos, benchmarks, preços e como começar

Na semana passada, o Google lançou Gémeos Embedding 2, o primeiro modelo de embedding nativamente multimodal criado na arquitetura Gemini. Se você trabalha com incorporações de alguma forma, isso merece sua atenção. Ele tem o potencial de interromper significativamente os pipelines de incorporação de vários modelos com os quais a maioria das equipes conta atualmente.

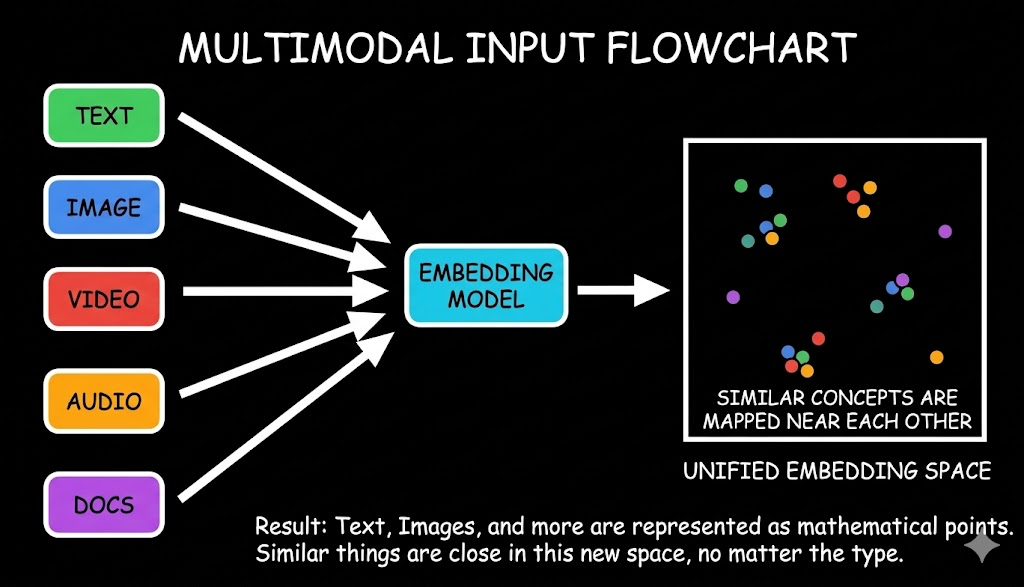

Até agora, os principais modelos de incorporação da OpenAI, Cohere e Voyage eram baseados principalmente em texto. Havia algumas opções multimodais – CLIP para alinhamento imagem-texto, Voyage Multimodal 3.5 para imagens e vídeo – mas nenhuma abrangia todo o espectro de modalidades em um único espaço vetorial unificado. Normalmente, o áudio tinha que ser transcrito antes da incorporação. O vídeo exigia a extração de quadros combinada com a incorporação de transcrições separadas. As imagens viviam inteiramente em seu próprio espaço vetorial.

O Gemini Embedding 2 muda essa equação. Um modelo, uma chamada de API, um espaço vetorial.

Vamos ver o que há de novo.

O que é o Gemini Embedding 2?

O Gemini Embedding 2 (gemini-embedding-2-preview) é o primeiro modelo de incorporação totalmente multimodal do Google DeepMind. Ele usa texto, imagens, videoclipes, gravações de áudio e documentos PDF e converte todos eles em vetores que vivem no mesmo espaço semântico compartilhado.

Diferentemente de abordagens multimodais anteriores, como o CLIP, que emparelha um codificador de visão com um codificador de texto e os alinha com o aprendizado contrastivo no final, o Gemini Embedding 2 foi desenvolvido com base no próprio modelo de fundação do Gemini. Isso significa que ele herda uma profunda compreensão multimodal desde o início.

Imagem gerada usando o Nano Banana

Exemplo prático: Imagine que você está criando um Sistema de Gerenciamento de Aprendizagem (LMS) com tutoriais em vídeo, palestras em áudio e guias escritos. Com o Gemini Embedding 2, você pode armazenar embeddings de todo esse conteúdo em um único espaço vetorial e criar um chatbot baseado em RAG que recupera partes relevantes de vídeos, áudios e documentos. Anteriormente, isso exigia um pipeline de incorporação em várias camadas e, mesmo assim, ele só capturava transcrições, deixando de lado o contexto visual de um vídeo ou o tom de voz de um locutor.

O modelo usa o Matryoshka Representation Learning, o que significa que você não precisa usar todas as 3072 dimensões se não precisar delas. Você pode reduzir para 1536 ou 768 e ainda assim obter resultados úteis.

O aprendizado de representação Matryoshka (MRL) é uma técnica para treinar modelos de incorporação de modo que as representações aprendidas sejam úteis não apenas em sua dimensionalidade total, mas também em várias dimensões menores, aninhadas umas dentro das outras como bonecas russas matryoshka. Durante o treinamento, a função de perda é calculada não apenas na incorporação completa, mas também em vários prefixos do vetor de incorporação. Isso incentiva o modelo a reunir as informações mais importantes nas primeiras dimensões, com cada dimensão subsequente adicionando detalhes mais refinados – uma estrutura de grosso a fino.

Modalidades suportadas e limites de entrada

O modelo aceita cinco tipos de entrada, todos mapeados no mesmo espaço de incorporação:

| Modalidade | Limite de entrada | Formatos |

|---|---|---|

| Texto | Até 8.192 tokens | Texto simples |

| Imagens | Até 6 imagens por solicitação | PNG, JPEG |

| Vídeo | Até 120 segundos | MP4, MOV |

| Áudio | Até 80 segundos (nativo, sem transcrição) | MP3, WAV |

| PDFs | Incorporados diretamente | Documentos PDF |

Como ele se compara aos modelos existentes

TLDR: O novo modelo Gemini Embedding 2 do Google supera seus concorrentes (seu próprio antecessor, o Amazon Nova 2 e o Voyage Multimodal 3.5) em quase todas as modalidades: texto, imagem, vídeo e fala. Ele lidera de forma mais convincente na recuperação de vídeo e na correspondência imagem-texto. O único parâmetro de comparação em que ele não vence é a recuperação de documentos, em que o Voyage está ligeiramente à frente. A recuperação de texto por fala é uma categoria que pertence exclusivamente ao Gemini, pois nenhum concorrente oferece suporte a ela.

O Google publicou comparações de benchmark com seus próprios modelos legados, Amazon Nova 2 Multimodal Embeddings e Voyage Multimodal 3.5. Aqui está o quadro completo:

Texto-Texto

| Métrica | Incorporação Gemini 2 | gemini-embedding-001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| MTEB Multilíngue (tarefa média) | 69.9 | 68.4 | 63.8** | 58.5*** |

| Código MTEB (tarefa média) | 84.0 | 76.0 | * | * |

O Gemini Embedding 2 é líder em texto multilíngue por uma margem confortável e salta 8 pontos em relação ao seu antecessor na recuperação de código. Nem o Amazon Nova 2 nem o Voyage apresentam pontuações de código.

Texto-Imagem

| Métrica | Incorporação Gemini 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (recall@1) | 89.6 | 74.0 | 76.0 | 79.4 |

| Docci (recall@1) | 93.4 | – | 84.0 | 83.8 |

Uma clara liderança na recuperação de texto para imagem – mais de 9 pontos à frente do concorrente mais próximo em ambos os benchmarks.

Imagem-Texto

| Métrica | Incorporação Gemini 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (recall@1) | 97.4 | 88.1 | 88.9 | 88.6 |

| Docci (recall@1) | 91.3 | – | 76.5 | 77.4 |

A recuperação de imagem para texto mostra as maiores lacunas – quase 15 pontos à frente do Amazon Nova 2 no Docci.

Documento de texto

| Métrica | Incorporação Gemini 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| ViDoRe v2 (ndcg@10) | 64.9 | 28.9 | 60.6 | 65.5** |

O único parâmetro de comparação em que o Voyage Multimodal 3.5 está à frente (auto-relatado). A recuperação de documentos está próxima entre os principais modelos.

Texto-Vídeo

| Métrica | Incorporação Gemini 2 | multimodalembedding@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| Vatex (ndcg@10) | 68.8 | 54.9 | 60.3 | 55.2 |

| MSR-VTT (ndcg@10) | 68.0 | 57.9 | 67.0 | 63.0** |

| Você é o cozinheiro2 (ndcg@10) | 52.5 | 34.9 | 34.7 | 31.4** |

A recuperação de vídeo é onde o Gemini Embedding 2 está mais à frente – mais de 17 pontos acima do Voyage no Youcook2 e mais de 13 pontos no Vatex.

Discurso-Texto

| Métrica | Incorporação Gemini 2 |

|---|---|

| MSEB (mrr@10) | 73.9 |

| MSEB ASR**** (mrr@10) | 70.4 |

A recuperação de texto de fala é totalmente incontestável – nem a Amazon nem o Voyage oferecem suporte a ela. Essa é uma categoria que a Gemini Embedding 2 domina completamente.

– Pontuação não disponível ** Autorrelatada *** voyage-3.5 **** O modelo ASR converte consultas de áudio em texto

Preços

No momento, o modelo é gratuito durante a visualização pública. Quando você estiver no nível pago, veja o detalhamento:

| Nível gratuito | Nível pago (por 1 milhão de tokens) | |

|---|---|---|

| Entrada de texto | Gratuito | $0.20 |

| Entrada de imagem | Gratuito | US$ 0,45 (US$ 0,00012 por imagem) |

| Entrada de áudio | Gratuito | US$ 6,50 (US$ 0,00016 por segundo) |

| Entrada de vídeo | Gratuito | US$ 12,00 (US$ 0,00079 por quadro) |

| Usado para melhorar os produtos do Google | Sim | Não |

Primeiros passos

O modelo está disponível agora em visualização pública por meio da API Gemini e do Vertex AI com o ID do modelo gemini-embedding-2-preview. Ele se integra com LangChain, LlamaIndex, Haystack, Weaviate, Qdrant, ChromaDB e Vector Search.

from google import genai

from google.genai import types

# For Vertex AI:

# PROJECT_ID='<add_here>'

# client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1')

client = genai.Client()

with open("example.png", "rb") as f:

image_bytes = f.read()

with open("sample.mp3", "rb") as f:

audio_bytes = f.read()

# Embed text, image, and audio

result = client.models.embed_content(

model="gemini-embedding-2-preview",

contents=[

"What is the meaning of life?",

types.Part.from_bytes(

data=image_bytes,

mime_type="image/png",

),

types.Part.from_bytes(

data=audio_bytes,

mime_type="audio/mpeg",

),

],

)

print(result.embeddings)

Experimente aqui!

Criamos um aplicativo de demonstração no qual você pode testar o desempenho de recuperação multimodal do gemini-embedding-2.

Você pode obter a chave de API fazendo login em aistudio.google.com.

Limitações a serem observadas

- O modelo ainda está em pré-visualização pública (a tag “preview” significa que o preço e o comportamento podem mudar antes do GA).

- A entrada de vídeo é limitada a 120 segundos e a de áudio a 80 segundos.

- O desempenho em domínios de nicho, como o controle de qualidade financeiro, é mais fraco; avalie com base em seus dados específicos antes de se comprometer.

- Para pipelines de texto puro sem planos multimodais, o prêmio de custo em relação aos modelos somente de texto pode não ser justificado.

O resultado final

O Gemini Embedding 2 não é apenas uma melhoria incremental, é uma mudança de categoria. Para as equipes que criam sistemas RAG multimodais, pesquisa semântica em tipos de mídia ou bases de conhecimento unificadas, ele reduz o que costumava ser um problema de vários modelos e vários pipelines a uma única chamada de API. Se seus dados abrangem mais do que apenas texto, este é o modelo que você deve avaliar primeiro.

Para criar um RAG multimodal, você não deve precisar costurar modelos de incorporação, bancos de dados vetoriais e lógica de recuperação do zero. Se você quiser uma solução gerenciada de RAG como serviço que lide com o pipeline de incorporação para você, inscreva-se para a avaliação gratuita na Cody e comece a criar hoje mesmo.