OpenAI GPT-3.5 Turbo i precyzyjne dostrajanie GPT 4

OpenAI zapoczątkowało nową erę dla programistów AI, prezentując ulepszony model GPT-3.5 Turbo. To nie jest zwykła wersja; deweloperzy mają teraz swobodę dostosowywania modelu, optymalizując go tak, aby lepiej współgrał z ich unikalnymi aplikacjami. Co ciekawe, OpenAI twierdzi, że po dokładnym dostrojeniu, GPT-3.5 Turbo może potencjalnie przyćmić wydajność podstawowego GPT-4 w wyspecjalizowanych zadaniach.

Takie dostosowanie zapewnia kilka korzyści:

- Spójne instrukcje: Programiści mogą dostosować model do określonych wytycznych, zapewniając, że pozostaje on zsynchronizowany z tonem językowym określonym przez początkowy monit.

- Spójne odpowiedzi: Niezależnie od tego, czy chodzi o automatyczne uzupełnianie kodu, czy skryptowanie wywołań API, model może być prowadzony w celu uzyskania bardziej spójnych wyników.

- Wyrafinowanie tonalne: Głos marki może być charakterystyczny. Model można dostosować tak, aby odzwierciedlał ten głos, zapewniając zgodność z tożsamością marki.

Jedną z wyróżniających się cech tej możliwości dostrajania jest wydajność. Pierwsi użytkownicy zwrócili uwagę na 90% redukcję rozmiaru podpowiedzi po dostrojeniu bez uszczerbku dla wydajności modelu. To nie tylko przyspiesza wywołania API, ale także okazuje się opłacalne.

Zagłębiając się w mechanikę, dostrajanie jest procesem wieloaspektowym. Obejmuje to przygotowanie zestawu danych szkoleniowych, wyrzeźbienie precyzyjnie dostrojonego modelu i jego wdrożenie. Podstawą jest tutaj przygotowanie zbioru danych, obejmujące zadania takie jak tworzenie podpowiedzi, prezentowanie mnóstwa dobrze skonstruowanych demonstracji, szkolenie modelu na tych demonstracjach, a następnie testowanie jego sprawności.

OpenAI zachowuje jednak ostrożność. Chociaż urok dostrajania jest niezaprzeczalny, nie powinien to być pierwszy krok w podnoszeniu wydajności modelu. Jest to skomplikowane przedsięwzięcie wymagające znacznej ilości czasu i wiedzy. Przed wyruszeniem w podróż dostrajania, programiści powinni najpierw zapoznać się z technikami takimi jak inżynieria promptów, łańcuchowanie promptów i wywoływanie funkcji. Strategie te, w połączeniu z innymi najlepszymi praktykami, często służą jako wstępne kroki w ulepszaniu modelu.

Oczekiwania na dopracowanie GPT-4 rosną

Opierając się na dynamice ogłoszenia dostrajania GPT-3.5 Turbo, OpenAI drażni społeczność deweloperów kolejną rewelacją: rychłym nadejściem możliwości dostrajania dla długo oczekiwanego modelu GPT-4, którego premiera zaplanowana jest na jesień tego roku. To z pewnością podniosło poziom ekscytacji, a wielu z nich chce wykorzystać zwiększone możliwości GPT-4.

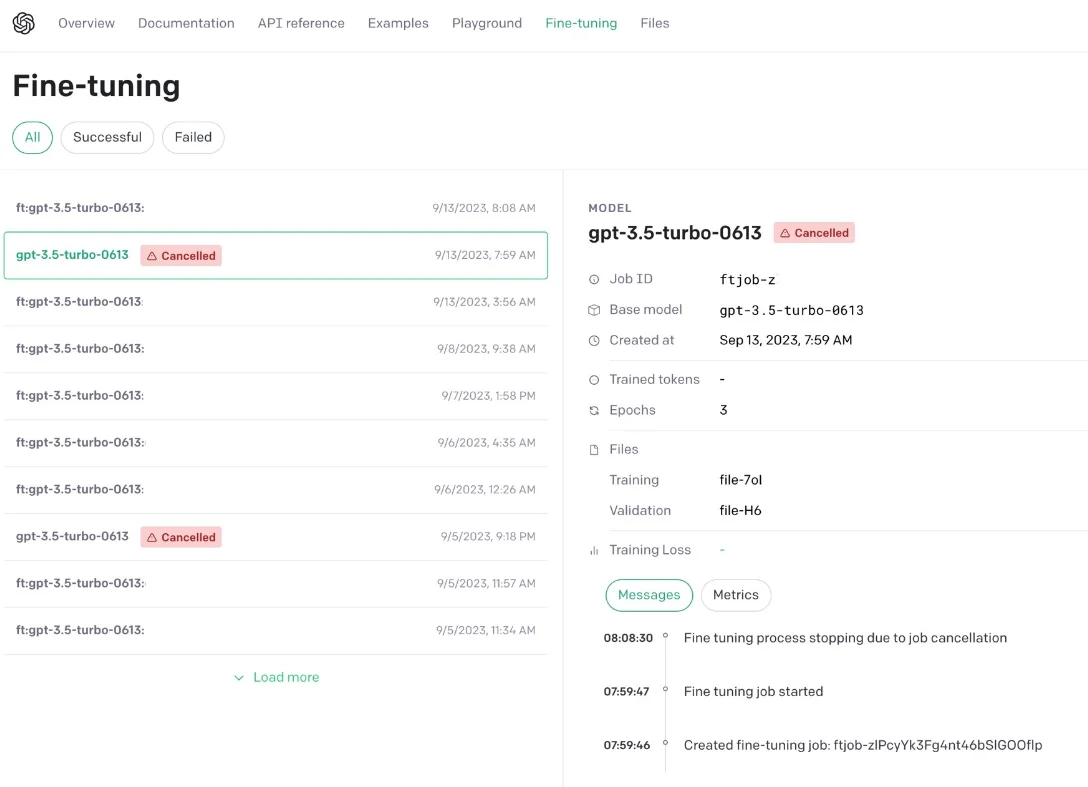

Łatwe dostrajanie staje się łatwiejsze

W najnowszej aktualizacji OpenAI uruchomiło swój dopracowany interfejs użytkownika. Programiści mogą teraz wizualnie śledzić swoje działania związane z dostrajaniem. A na horyzoncie jest jeszcze więcej; możliwość tworzenia precyzyjnych ustawień bezpośrednio za pośrednictwem tego interfejsu użytkownika zostanie rozwinięta w nadchodzących miesiącach.

Co więcej, w OpenAI chodzi o wzmocnienie pozycji użytkowników. Zwiększono limit jednoczesnego treningu z jednego modelu do trzech, umożliwiając programistom jednoczesne dostrajanie wielu modeli, maksymalizując wydajność.

Dzięki tym postępom OpenAI nadal umacnia swoją pozycję w czołówce innowacji AI, konsekwentnie oferując narzędzia, które nie tylko redefiniują teraźniejszość, ale także torują drogę na przyszłość.