Incrustación Gemini 2: el primer modelo de incrustación multimodal de Google

Gemini Embedding 2: Características, Benchmarks, Precios y Cómo Empezar

La semana pasada, Google publicó Géminis Incrustación 2, el primer modelo de incrustación multimodal nativo construido sobre la arquitectura Gemini. Si trabajas con incrustaciones de algún modo, esto merece tu atención. Tiene el potencial de alterar significativamente los procesos de incrustación multimodal en los que confían la mayoría de los equipos hoy en día.

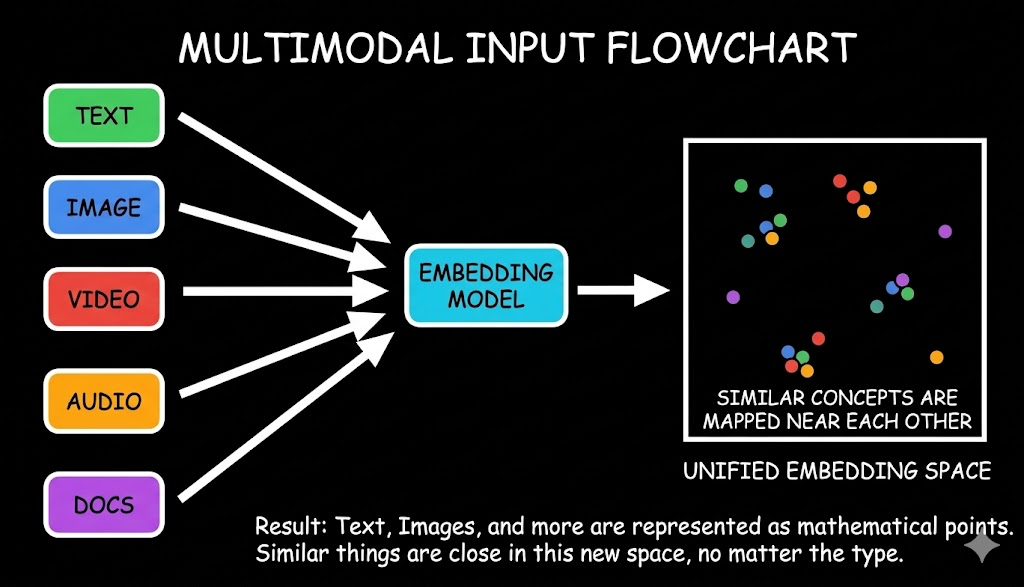

Hasta ahora, los modelos emblemáticos de incrustación de OpenAI, Cohere y Voyage se basaban principalmente en el texto. Existían algunas opciones multimodales – CLIP para la alineación imagen-texto, Voyage Multimodal 3.5 para imágenes y vídeo – pero ninguna cubría todo el espectro de modalidades en un único espacio vectorial unificado. Normalmente, había que transcribir el audio antes de incrustarlo. El vídeo requería la extracción de fotogramas combinada con la incrustación de transcripciones por separado. Las imágenes vivían en su propio espacio vectorial.

Gemini Incrustación 2 cambia esa ecuación. Un modelo, una llamada a la API, un espacio vectorial.

Profundicemos en las novedades.

¿Qué es Gemini Incrustación 2?

Gemini Embedding 2 (gemini-embedding-2-preview) es el primer modelo de incrustación completamente multimodal de Google DeepMind. Toma texto, imágenes, videoclips, grabaciones de audio y documentos PDF y los convierte todos en vectores que viven en el mismo espacio semántico compartido.

A diferencia de enfoques multimodales anteriores, como CLIP, que emparejan un codificador de visión con un codificador de texto y los alinean con aprendizaje contrastivo al final, Gemini Embedding 2 se construye sobre el propio modelo base Gemini. Esto significa que hereda una profunda comprensión intermodal desde la base.

Imagen generada con Nano Banana

Ejemplo práctico: Imagina que estás construyendo un Sistema de Gestión del Aprendizaje (SGA) con videotutoriales, conferencias de audio y guías escritas. Con Gemini Embedding 2, puedes almacenar las incrustaciones de todo este contenido en un único espacio vectorial y construir un chatbot basado en RAG que recupere trozos relevantes de vídeos, audio y documentos por igual. Anteriormente, esto requería un proceso de incrustación de varias capas, e incluso entonces, sólo capturaba transcripciones, perdiéndose el contexto visual de un vídeo o el tono de voz de un orador.

El modelo utiliza el Aprendizaje de Representación Matrioska, lo que significa que no tienes que utilizar las 3072 dimensiones si no las necesitas. Puedes reducir la escala a 1536 o 768 y seguir obteniendo resultados utilizables.

El Aprendizaje de la Representación Matrioska (MRL) es una técnica para entrenar modelos de incrustación de modo que las representaciones aprendidas sean útiles no sólo en su dimensionalidad completa, sino también en varias dimensiones más pequeñas, anidadas unas dentro de otras como muñecas rusas matrioskas. Durante el entrenamiento, la función de pérdida se calcula no sólo sobre la incrustación completa, sino también sobre múltiples prefijos del vector de incrustación. Esto anima al modelo a empaquetar la información más importante en las dimensiones más tempranas, y cada dimensión posterior añade detalles de grano más fino: una estructura de grueso a fino.

Modalidades y límites de entrada admitidos

El modelo acepta cinco tipos de entrada, todos ellos mapeados en el mismo espacio de incrustación:

| Modalidad | Límite de entrada | Formatos |

|---|---|---|

| Texto | Hasta 8.192 fichas | Texto sin formato |

| Imágenes | Hasta 6 imágenes por solicitud | PNG, JPEG |

| Vídeo | Hasta 120 segundos | MP4, MOV |

| Audio | Hasta 80 segundos (nativo, sin transcripción) | MP3, WAV |

| PDFs | Directamente incrustados | documentos PDF |

Cómo se compara con los modelos existentes

TLDR: El nuevo modelo Gemini Embedding 2 de Google supera a sus competidores (su propio predecesor, Amazon Nova 2 y Voyage Multimodal 3.5) en casi todas las modalidades: texto, imagen, vídeo y voz. Su liderazgo es más convincente en la recuperación de vídeo y en la correspondencia imagen-texto. La única prueba en la que no gana es en la recuperación de documentos, en la que Voyage le aventaja ligeramente. La recuperación de texto hablado es una categoría que Gemini posee en solitario, ya que ningún competidor la soporta.

Google publicó comparaciones comparativas con sus propios modelos heredados, Amazon Nova 2 Multimodal Embeddings y Voyage Multimodal 3.5. Aquí está el cuadro completo:

Texto-Texto

| Métrica | Incrustación Gemini 2 | incrustación-gemini-001 | Amazon Nova 2 | Viaje Multimodal 3.5 |

|---|---|---|---|---|

| MTEB Multilingüe (Tarea media) | 69.9 | 68.4 | 63.8** | 58.5*** |

| Código MTEB (Tarea media) | 84.0 | 76.0 | * | * |

Gemini Incrustación 2 lidera en texto multilingüe por un cómodo margen y salta 8 puntos sobre su propio predecesor en recuperación de código. Ni Amazon Nova 2 ni Voyage informan de la puntuación de los códigos.

Texto-Imagen

| Métrica | Incrustación Géminis 2 | incrustación multimodal@001 | Amazon Nova 2 | Viaje Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (recuerdo@1) | 89.6 | 74.0 | 76.0 | 79.4 |

| Docci (retirada@1) | 93.4 | – | 84.0 | 83.8 |

Una clara ventaja en la recuperación de texto a imagen: más de 9 puntos por delante del competidor más cercano en ambas pruebas.

Imagen-Texto

| Métrica | Incrustación Géminis 2 | incrustación multimodal@001 | Amazon Nova 2 | Viaje Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (recuerdo@1) | 97.4 | 88.1 | 88.9 | 88.6 |

| Docci (retirada@1) | 91.3 | – | 76.5 | 77.4 |

La recuperación de imagen a texto muestra las mayores diferencias: casi 15 puntos por delante de Amazon Nova 2 en Docci.

Documento de texto

| Métrica | Incrustación Géminis 2 | incrustación multimodal@001 | Amazon Nova 2 | Viaje Multimodal 3.5 |

|---|---|---|---|---|

| ViDoRe v2 (ndcg@10) | 64.9 | 28.9 | 60.6 | 65.5** |

El único punto de referencia en el que Voyage Multimodal 3.5 está por delante (autodeclarado). La recuperación de documentos está muy igualada entre los mejores modelos.

Texto-Vídeo

| Métrica | Incrustación Géminis 2 | incrustación multimodal@001 | Amazon Nova 2 | Viaje Multimodal 3.5 |

|---|---|---|---|---|

| Vatex (ndcg@10) | 68.8 | 54.9 | 60.3 | 55.2 |

| MSR-VTT (ndcg@10) | 68.0 | 57.9 | 67.0 | 63.0** |

| Youcook2 (ndcg@10) | 52.5 | 34.9 | 34.7 | 31.4** |

La recuperación de vídeo es donde Gemini Incrustación 2 saca más ventaja: más de 17 puntos por encima de Voyage en Youcook2 y más de 13 puntos en Vatex.

Discurso-Texto

| Métrica | Incrustación Géminis 2 |

|---|---|

| MSEB (mrr@10) | 73.9 |

| MSEB ASR**** (mrr@10) | 70.4 |

La recuperación de texto hablado es totalmente indiscutible: ni Amazon ni Voyage la admiten. Se trata de una categoría que Gemini Embedding 2 domina por completo.

– puntuación no disponible ** autodeclarada *** voyage-3.5 **** El modelo ASR convierte las consultas de audio en texto

Precios

Actualmente, el modelo es gratuito durante la vista previa pública. Una vez en el nivel de pago, éste es el desglose:

| Nivel gratuito | Nivel de pago (por 1M de fichas) | |

|---|---|---|

| Introducción de texto | Gratuito | $0.20 |

| Introducción de imágenes | Gratis | 0,45 $ (0,00012 $ por imagen) |

| Entrada de audio | Gratuito | 6,50 $ (0,00016 $ por segundo) |

| Entrada de vídeo | Gratuito | 12,00 $ (0,00079 $ por fotograma) |

| Se utiliza para mejorar los productos de Google | Sí | No |

Cómo empezar

El modelo ya está disponible en vista previa pública a través de la API de Géminis y Vertex AI con el ID de modelo gemini-embedding-2-preview. Se integra con LangChain, LlamaIndex, Haystack, Weaviate, Qdrant, ChromaDB y Vector Search.

from google import genai

from google.genai import types

# For Vertex AI:

# PROJECT_ID='<add_here>'

# client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1')

client = genai.Client()

with open("example.png", "rb") as f:

image_bytes = f.read()

with open("sample.mp3", "rb") as f:

audio_bytes = f.read()

# Embed text, image, and audio

result = client.models.embed_content(

model="gemini-embedding-2-preview",

contents=[

"What is the meaning of life?",

types.Part.from_bytes(

data=image_bytes,

mime_type="image/png",

),

types.Part.from_bytes(

data=audio_bytes,

mime_type="audio/mpeg",

),

],

)

print(result.embeddings)

¡Pruébalo aquí!

Hemos creado una aplicación de demostración en la que puedes probar el rendimiento de la recuperación multimodal de gemini-embedding-2.

Puedes obtener la Clave API accediendo a aistudio.google.com.

Limitaciones a tener en cuenta

- El modelo aún está en fase de preestreno público (la etiqueta “preestreno” significa que el precio y el comportamiento pueden cambiar antes de la AG).

- La entrada de vídeo tiene un límite de 120 segundos y la de audio de 80 segundos.

- El rendimiento en ámbitos especializados, como la garantía de calidad financiera, es más débil; evalúalo con tus datos específicos antes de comprometerte.

- Para las canalizaciones de texto puro sin planes multimodales, puede que no esté justificado el sobrecoste respecto a los modelos de sólo texto.

Lo esencial

Gemini Embedding 2 no es sólo una mejora incremental, es un cambio de categoría. Para los equipos que construyen sistemas RAG multimodales, búsquedas semánticas en distintos tipos de medios o bases de conocimiento unificadas, colapsa lo que solía ser un problema de varios modelos y tuberías en una sola llamada a la API. Si tus datos abarcan algo más que texto, éste es el modelo que debes evaluar primero.

Construir RAG multimodal no debería significar coser desde cero modelos de incrustación, bases de datos vectoriales y lógica de recuperación. Si quieres una solución gestionada de RAG como servicio que se encargue del proceso de incrustación por ti, inscríbete en la prueba gratuita de Cody y empieza a construir hoy mismo.