Gemini Embedding 2: Das erste multimodale Einbettungsmodell von Google

Gemini Embedding 2: Funktionen, Benchmarks, Preise und wie man anfängt

Letzte Woche veröffentlichte Google Zwillinge Embedding 2, das erste nativ multimodale Einbettungsmodell, das auf der Gemini-Architektur basiert. Wenn Sie in irgendeiner Weise mit Einbettungen arbeiten, verdient dies Ihre Aufmerksamkeit. Es hat das Potenzial, die Multi-Modell-Einbettungspipelines, auf die sich die meisten Teams heute verlassen, erheblich zu stören.

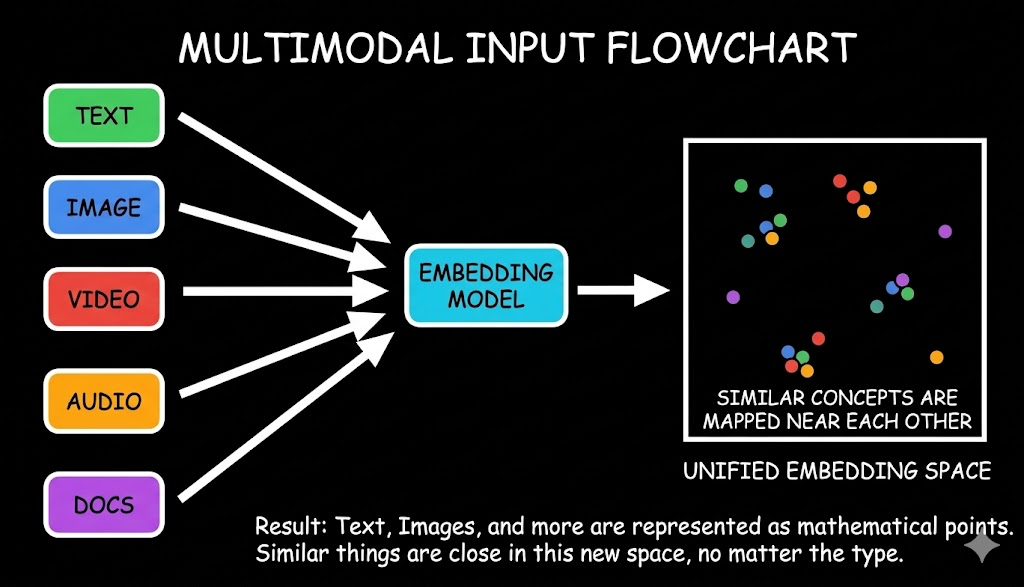

Bis jetzt waren die führenden Einbettungsmodelle von OpenAI, Cohere und Voyage hauptsächlich textbasiert. Es gab zwar ein paar multimodale Optionen – CLIP für den Abgleich von Bild und Text, Voyage Multimodal 3.5 für Bilder und Videos – aber keine deckte das gesamte Spektrum der Modalitäten in einem einzigen, einheitlichen Vektorraum ab. Audio musste in der Regel vor der Einbettung transkribiert werden. Video erforderte eine Frame-Extraktion in Kombination mit separaten Transkript-Einbettungen. Bilder lebten in einem ganz eigenen Vektorraum.

Gemini Embedding 2 ändert diese Gleichung. Ein Modell, ein API-Aufruf, ein Vektorraum.

Schauen wir uns an, was es Neues gibt.

Was ist Gemini Embedding 2?

Gemini Embedding 2 (gemini-embedding-2-preview) ist das erste vollständig multimodale Einbettungsmodell von Google DeepMind. Es nimmt Texte, Bilder, Videoclips, Audioaufnahmen und PDF-Dokumente und wandelt sie alle in Vektoren um, die im selben gemeinsamen semantischen Raum leben.

Im Gegensatz zu früheren multimodalen Ansätzen wie CLIP, die einen Bildverarbeitungs-Encoder mit einem Text-Encoder koppeln und sie am Ende mit kontrastivem Lernen abgleichen, baut Gemini Embedding 2 auf dem Gemini-Grundmodell selbst auf. Das bedeutet, dass es von Grund auf ein tiefes cross-modales Verständnis besitzt.

Mit Nano Banana erzeugtes Bild

Praktisches Beispiel: Stellen Sie sich vor, Sie bauen ein Learning Management System (LMS) mit Videotutorials, Audiovorträgen und schriftlichen Anleitungen auf. Mit Gemini Embedding 2 können Sie Einbettungen für all diese Inhalte in einem einzigen Vektorraum speichern und einen RAG-basierten Chatbot erstellen, der relevante Teile von Videos, Audios und Dokumenten gleichermaßen abruft. Zuvor war dafür eine mehrstufige Einbettungspipeline erforderlich – und selbst dann wurden nur Transkripte erfasst, ohne den visuellen Kontext eines Videos oder den Tonfall eines Sprechers.

Das Modell verwendet Matrjoschka Representation Learning, d.h. Sie müssen nicht alle 3072 Dimensionen verwenden, wenn Sie sie nicht brauchen. Sie können auf 1536 oder 768 verkleinern und erhalten trotzdem brauchbare Ergebnisse.

Matryoshka Representation Learning (MRL) ist eine Technik zum Trainieren von Einbettungsmodellen, so dass die erlernten Darstellungen nicht nur in ihrer vollen Dimensionalität, sondern auch in verschiedenen kleineren Dimensionen nützlich sind – ineinander verschachtelt wie russische Matryoshka-Puppen. Während des Trainings wird die Verlustfunktion nicht nur für die vollständige Einbettung berechnet, sondern auch für mehrere Präfixe des Einbettungsvektors. Dadurch wird das Modell ermutigt, die wichtigsten Informationen in die ersten Dimensionen zu packen, wobei jede nachfolgende Dimension feinere Details hinzufügt – eine Grob-zu-Fein-Struktur.

Unterstützte Modalitäten & Eingabebeschränkungen

Das Modell akzeptiert fünf Arten von Eingaben, die alle auf denselben Einbettungsraum abgebildet werden:

| Modalität | Eingabe Grenze | Formate |

|---|---|---|

| Text | Bis zu 8.192 Token | Einfacher Text |

| Bilder | Bis zu 6 Bilder pro Anfrage | PNG, JPEG |

| Video | Bis zu 120 Sekunden | MP4, MOV |

| Audio | Bis zu 80 Sekunden (nativ, keine Transkription) | MP3, WAV |

| PDFs | Direkt eingebettete | PDF-Dokumente |

Im Vergleich zu bestehenden Modellen

TLDR: Das neue Gemini Embedding 2 Modell von Google übertrifft seine Konkurrenten (seinen eigenen Vorgänger, Amazon Nova 2 und Voyage Multimodal 3.5) in fast jeder Modalität: Text, Bild, Video und Sprache. Am überzeugendsten ist der Vorsprung beim Abrufen von Videos und beim Bild-Text-Abgleich. Der einzige Benchmark, bei dem es nicht gewinnt, ist die Dokumentensuche, bei der Voyage leicht vorne liegt. Die Abfrage von Sprachtexten ist eine Kategorie, die Gemini allein gehört, da kein Konkurrent sie unterstützt.

Google hat Benchmark-Vergleiche mit seinen eigenen Legacy-Modellen, Amazon Nova 2 Multimodal Embeddings und Voyage Multimodal 3.5 veröffentlicht. Hier ist das vollständige Bild:

Text-Text

| Metrisch | Gemini Einbettung 2 | gemini-einbettung-001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| MTEB Mehrsprachig (Mittlere Aufgabe) | 69.9 | 68.4 | 63.8** | 58.5*** |

| MTEB Code (Mittlere Aufgabe) | 84.0 | 76.0 | * | * |

Gemini Embedding 2 liegt bei mehrsprachigem Text mit einem komfortablen Vorsprung vorn und übertrifft seinen Vorgänger bei der Code-Suche um 8 Punkte. Weder Amazon Nova 2 noch Voyage melden Code-Ergebnisse.

Text-Bild

| Metrisch | Zwillingseinbettung 2 | multimodale Einbettung@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (Abruf@1) | 89.6 | 74.0 | 76.0 | 79.4 |

| Docci (Rückruf@1) | 93.4 | – | 84.0 | 83.8 |

Ein klarer Vorsprung bei der Text-zu-Bild-Suche – über 9 Punkte Vorsprung vor dem nächsten Mitbewerber bei beiden Benchmarks.

Bild-Text

| Metrisch | Zwillingseinbettung 2 | multimodale Einbettung@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| TextCaps (Rückruf@1) | 97.4 | 88.1 | 88.9 | 88.6 |

| Docci (Rückruf@1) | 91.3 | – | 76.5 | 77.4 |

Bei der Bild-zu-Text-Suche ist der Abstand am größten – fast 15 Punkte vor Amazon Nova 2 auf Docci.

Textdokumente

| Metrisch | Zwillingseinbettung 2 | multimodale Einbettung@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| ViDoRe v2 (ndcg@10) | 64.9 | 28.9 | 60.6 | 65.5** |

Der einzige Benchmark, bei dem Voyage Multimodal 3.5 die Nase vorn hat (Selbstauskunft). Bei der Dokumentensuche liegen die Top-Modelle dicht beieinander.

Text-Video

| Metrisch | Zwillingseinbettung 2 | multimodale Einbettung@001 | Amazon Nova 2 | Voyage Multimodal 3.5 |

|---|---|---|---|---|

| Vatex (ndcg@10) | 68.8 | 54.9 | 60.3 | 55.2 |

| MSR-VTT (ndcg@10) | 68.0 | 57.9 | 67.0 | 63.0** |

| Youcook2 (ndcg@10) | 52.5 | 34.9 | 34.7 | 31.4** |

Beim Abrufen von Videos liegt Gemini Embedding 2 am weitesten vorne – über 17 Punkte vor Voyage auf Youcook2 und über 13 Punkte auf Vatex.

Sprache – Text

| Metrisch | Zwillingseinbettung 2 |

|---|---|

| MSEB (mrr@10) | 73.9 |

| MSEB ASR**** (mrr@10) | 70.4 |

Die Abfrage von Sprachtexten ist völlig unumstritten – weder Amazon noch Voyage unterstützen sie. Dies ist eine Kategorie, die Gemini Embedding 2 vollständig beherrscht.

– Wertung nicht verfügbar ** Selbstauskunft *** voyage-3.5 **** ASR-Modell wandelt Audioanfragen in Text um

Preisgestaltung

Das Modell ist derzeit während der öffentlichen Vorschau kostenlos. Sobald Sie die kostenpflichtige Stufe erreicht haben, sehen Sie hier die Aufschlüsselung:

| Kostenloses Tier | Bezahlte Stufe (pro 1M Token) | |

|---|---|---|

| Texteingabe | Kostenfrei | $0.20 |

| Bild-Eingabe | Kostenfrei | $0,45 ($0,00012 pro Bild) |

| Audio-Eingang | Kostenfrei | $6,50 ($0,00016 pro Sekunde) |

| Video-Eingang | Kostenfrei | $12.00 ($0.00079 pro Bild) |

| Wird zur Verbesserung der Google-Produkte verwendet | Ja | Nein |

Erste Schritte

Das Modell ist jetzt in der öffentlichen Vorschau über die Gemini API und Vertex AI unter der Modell-ID gemini-embedding-2-preview. Es lässt sich mit LangChain, LlamaIndex, Haystack, Weaviate, Qdrant, ChromaDB und Vector Search integrieren.

from google import genai

from google.genai import types

# For Vertex AI:

# PROJECT_ID='<add_here>'

# client = genai.Client(vertexai=True, project=PROJECT_ID, location='us-central1')

client = genai.Client()

with open("example.png", "rb") as f:

image_bytes = f.read()

with open("sample.mp3", "rb") as f:

audio_bytes = f.read()

# Embed text, image, and audio

result = client.models.embed_content(

model="gemini-embedding-2-preview",

contents=[

"What is the meaning of life?",

types.Part.from_bytes(

data=image_bytes,

mime_type="image/png",

),

types.Part.from_bytes(

data=audio_bytes,

mime_type="audio/mpeg",

),

],

)

print(result.embeddings)

Probieren Sie es hier aus!

Wir haben eine Demo-App erstellt, mit der Sie die multimodale Abrufleistung von gemini-embedding-2 testen können.

Sie können den API-Schlüssel erhalten, indem Sie sich bei aistudio.google.com anmelden.

Zu beachtende Beschränkungen

- Das Modell befindet sich noch in der öffentlichen Vorschau (das Etikett “Vorschau” bedeutet, dass sich die Preise und das Verhalten vor der GA ändern können).

- Der Videoeingang ist auf 120 Sekunden und der Audioeingang auf 80 Sekunden begrenzt.

- Die Leistung in Nischenbereichen wie der Finanz-QS ist schwächer; bewerten Sie sie anhand Ihrer spezifischen Daten, bevor Sie sich festlegen.

- Bei reinen Text-Pipelines ohne multimodale Pläne ist der Kostenaufschlag gegenüber reinen Textmodellen möglicherweise nicht gerechtfertigt.

Die Quintessenz

Gemini Embedding 2 ist nicht nur eine schrittweise Verbesserung, sondern ein Wechsel der Kategorie. Für Teams, die multimodale RAG-Systeme, eine medienübergreifende semantische Suche oder vereinheitlichte Wissensdatenbanken aufbauen, wird das, was früher ein Problem mit mehreren Modellen und Pipelines war, zu einem einzigen API-Aufruf zusammengefasst. Wenn Ihre Daten mehr als nur Text umfassen, ist dies das Modell, das Sie zuerst testen sollten.

Multimodale RAG zu erstellen sollte nicht bedeuten, dass Sie Einbettungsmodelle, Vektordatenbanken und Abfragelogik von Grund auf neu zusammensetzen müssen. Wenn Sie eine verwaltete RAG-as-a-Service-Lösung wünschen, die die Einbettungspipeline für Sie übernimmt, melden Sie sich für die kostenlose Testversion bei Cody an und beginnen Sie noch heute mit der Erstellung.